DeepSeek-V4-Flash ist nun offiziell, öffentlich und als Open-Weight-Modell verfügbar.

Das ist besonders für eine ganz bestimmte Gruppe von Käufern entscheidend: Teams, die eine leistungsstarke KI benötigen, ohne sensible Tabellendaten an eine externe API zu senden.

Wenn Sie private KI für Finanzberichte, operative Workbooks, interne Exporte oder wiederkehrende Tabellenanalysen evaluieren, stellt sich nicht mehr nur die Frage, ob ein solches Modell auf der eigenen Infrastruktur laufen kann. Die eigentliche Frage ist, ob Sie daraus einen sicheren internen Dienst machen können, den die Mitarbeiter tatsächlich nutzen können.

Dieser Artikel soll genau dabei helfen.

Konkret beschreiben wir ein praktisches Setup für private KI zur internen Tabellenanalyse:

- DeepSeek-V4-Flash auf dem eigenen GPU-Server betreiben

- Das Modell als private Inference-API bereitstellen

- Validieren, dass der Endpunkt mit geschäftstypischen Prompts funktioniert

- Eine Workflow-Ebene wie RowSpeak anbinden, damit nicht-technische Nutzer Tabellendaten analysieren können, ohne sich mit rohen Modellaufrufen befassen zu müssen

Dies ist kein Artikel über das bloße „Chatten mit einem Modell“. Es geht darum, einen privaten KI-Server aufzubauen, der echte interne Tabellen-Workflows unterstützt.

Warum Teams einen privaten KI-Server für die Tabellenanalyse wollen

Wenn über Self-Hosting gesprochen wird, klingt das oft ideologisch. In der Realität sind die Beweggründe meist operativ und kommerziell.

Ein Finanzteam möchte vermeiden, dass Tabellen für das Board-Reporting über eine öffentliche API laufen, insbesondere wenn diese Dateien Workflows für das Management-Reporting unterstützen. Ein Operations-Team möchte nicht, dass interne Tracker, Umsatzexporte und komplexe abteilungsübergreifende Workbooks die eigene Umgebung verlassen, nur um eine Analyse durchzuführen. Und ein IT- oder Sicherheitsteam wünscht sich meist etwas noch Einfacheres: einen Modell-Endpunkt, den sie wie den Rest ihrer internen Systeme kontrollieren, überwachen, auditieren und einschränken können.

Genau hier wird DeepSeek-V4-Flash attraktiv.

DeepSeek hat sich schnell zu einem festen Bestandteil der Diskussion über private KI entwickelt, da Teams es nun als realistische Basis für interne KI-Bereitstellungen sehen.

Es ist leistungsstark genug, um den Einsatz zu rechtfertigen, und offen genug, um ein privates KI-Rollout realistisch umsetzbar zu machen.

Wenn Ihr Anwendungsfall ein lockerer Consumer-Chat ist, bleibt eine gehostete API wahrscheinlich die einfachere Wahl.

Sieht Ihr tatsächlicher Workload jedoch eher so aus:

- Finanz-Workbooks

- Wöchentliche Verkaufsberichte

- Exportierte BI-Tabellen

- CSV-Dumps aus internen Systemen

- Unübersichtliche operative Tabellen, die dennoch wichtige Entscheidungen steuern

...dann wird der Pfad über einen privaten Server deutlich überzeugender.

Was Sie tatsächlich aufbauen

Die gute Nachricht ist, dass die Architektur an sich simpel ist.

Sie benötigen keine riesige KI-Plattform, um Mehrwert zu generieren. Sie brauchen vier Dinge:

- Einen GPU-Server unter Ihrer Kontrolle

- Eine Modell-Runtime

- Einen privaten API-Endpunkt

- Eine Workflow-Ebene über diesem Endpunkt für die Endnutzer

In diesem Setup ist:

- DeepSeek-V4-Flash das Modell

- vLLM oder Ollama der Serving-Layer

- RowSpeak die Workflow-Ebene, die den Modellzugriff in Aufgaben zur Tabellenanalyse verwandelt

Diese Trennung ist wichtig, damit jede Ebene fokussiert bleibt.

Der Modell-Server kümmert sich um die Inference. Die Workflow-Ebene übernimmt die komplexe Realität der geschäftlichen Nutzung: Datei-Uploads, Tabellen-Kontext und Fragen in natürlicher Sprache, Zusammenfassungen und diagrammfertige Ausgaben.

Welcher Bereitstellungsweg ist am sinnvollsten?

Es gibt zwei realistische Wege, und die richtige Wahl hängt davon ab, welche Art von internem Dienst Sie betreiben möchten.

Option 1: vLLM

Wenn Sie einen ernsthaften internen KI-Endpunkt für die wiederholte geschäftliche Nutzung aufbauen, ist dies die primäre Empfehlung.

Der Grund ist einfach: vLLM ist ein produktionsorientierter Serving-Stack, und seine OpenAI-kompatible API macht die Integration sauberer. Wenn Ihr Ziel darin besteht, DeepSeek-V4-Flash hinter einen internen Workflow zur Tabellenanalyse zu schalten, sind API-Kompatibilität und Kontrolle über das Deployment entscheidend.

Option 2: Ollama

Ollama ist die komfortablere Option, wenn das Modell-Packaging und der Runtime-Support mit Ihren Anforderungen übereinstimmen.

Es ist einfacher in Gang zu bringen und kann für leichtere interne Szenarien oder schnelle Proof-of-Concepts eine vernünftige Wahl sein.

Zusammenfassend lässt sich die Entscheidung so formulieren:

Nutzen Sie vLLM, wenn Sie einen produktionsreifen privaten KI-Server anstreben, und nutzen Sie Ollama, wenn Schnelligkeit und Einfachheit wichtiger sind als die totale Kontrolle über die Infrastruktur.

Bevor Sie starten: Prüfen Sie den Server, nicht nur die Idee

Die genaue Hardware, die Sie benötigen, hängt vom gewählten DeepSeek-V4-Flash-Artefakt, der gewünschten Präzision, der Context Length und der erwarteten Gleichzeitigkeit der Anfragen ab.

Deshalb ist der pauschale Rat „Sie brauchen X GPUs“ oft irreführend.

Der bessere Ansatz ist, vom offiziellen Modell-Artefakt auszugehen und die Maschine entsprechend dem zu dimensionieren, was Sie tatsächlich bereitstellen möchten.

Ihr Server sollte mindestens über Folgendes verfügen:

- Ein Linux-System unter Ihrer Kontrolle

- NVIDIA-GPUs

- Eine saubere Treiber-Installation

- Eine funktionierende CUDA-Umgebung

- Installiertes Python

- Genug VRAM für das gewählte Modell-Artefakt

Bevor Sie fortfahren, führen Sie einen kurzen Check durch:

nvidia-smi

python3 --version

Es klingt banal, ist aber wichtig. Eine überraschend hohe Zahl von Problemen beim Deployment sind keine Modellprobleme, sondern Treiber-Konflikte, Umgebungsprobleme oder einfache Fehler bei der Vorbereitung der Maschine.

Bereitstellung mit vLLM

Wenn Sie den saubersten Weg für ein „echtes Deployment“ suchen, beginnen Sie hier.

Schritt 1: vLLM in einer sauberen Umgebung installieren

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

Nützliche Dokumentation:

Schritt 2: Das offizielle DeepSeek-Artefakt verwenden

Dies ist einer der Punkte, an denen eine kleine Abkürzung später viel Ärger bereiten kann.

Vermeiden Sie zufällige Mirror-Server. Starten Sie auf der offiziellen DeepSeek-Release-Seite und folgen Sie der dort verlinkten offiziellen Hugging Face Collection.

Das garantiert eine saubere Herkunft und senkt die Wahrscheinlichkeit, eine falsche Version bereitzustellen.

Die offizielle Release-Seite von DeepSeek, die V4-Flash als Teil des DeepSeek V4 Preview-Launchs ankündigt.

Schritt 3: Den API-Server starten

Ein typischer vLLM-Start sieht so aus:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

Je nach Modell-Artefakt und Maschine müssen Sie eventuell noch folgende Parameter anpassen:

- Tensor Parallelism

- dtype

- Max Model Length

- GPU Memory Utilization

Die Grundidee bleibt jedoch gleich: Starten Sie das Modell, geben Sie den Endpunkt frei und stellen Sie sicher, dass der Serving-Layer stabil läuft, bevor Sie die Anwendungsebene berühren.

Schritt 4: Den Endpunkt als API testen, nicht als Demo

Bevor Sie RowSpeak oder andere Tools anbinden, verifizieren Sie, dass der Modell-Server eigenständig korrekt antwortet.

Beispiel:

curl http://YOUR_SERVER_IP:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "Fasse die Vorteile des Self-Hostings eines LLMs für die Tabellenanalyse zusammen."}

]

}'

Wenn der Server eine gültige Antwort liefert, funktioniert der Kern des Serving-Pfads.

Widerstehen Sie an dieser Stelle dem Drang, den Test zu verkomplizieren. Es geht noch nicht um Benchmarking, sondern darum, ob der Endpunkt erreichbar ist, das Modell korrekt lädt und die API sich so verhält, wie es Ihre App erwartet.

Bereitstellung mit Ollama

Ollama ist der leichtgewichtigere Pfad. Wenn das Packaging passt, kann dies der schnellste Weg zu einem nutzbaren Deployment sein.

Wichtig ist jedoch, es nicht als Universallösung zu betrachten. Es ist die richtige Wahl, wenn der exakte DeepSeek-Build, den Sie benötigen, in einer Form verfügbar ist, die Ollama sauber bedienen kann.

Offizielle Dokumentation:

Zuerst installieren:

curl -fsSL https://ollama.com/install.sh | sh

Laden oder registrieren Sie dann das Modell in dem Format, das Ihr Ollama-Setup unterstützt, und testen Sie es direkt, bevor Sie mit der Integration beginnen.

Ein minimaler lokaler Test:

ollama run IHR_DEEPSEEK_MODELL

Falls Sie es stattdessen über die Ollama-API bereitstellen, testen Sie diese API zuerst direkt.

Mit Business-Prompts testen, nicht mit Spielereien

Dieser Teil wird oft unterschätzt.

Viele private KI-Deployments werden als „funktionsfähig“ deklariert, weil jemand das Modell gebeten hat, Hallo zu sagen, einen Absatz zusammenzufassen oder einen Witz zu erzählen. Das sagt fast nichts darüber aus, ob das System für die interne Arbeit, auf die es ankommt, nützlich ist.

Wenn Ihr Ziel die Tabellenanalyse ist, besteht der klügere Test darin, die Art von Prompts zu verwenden, die für Ihre Finanz-, Operations- oder KI-Reporting-Teams wirklich relevant sind.

Beispiel:

Ich habe eine wöchentliche Verkaufstabelle mit Spalten für Region, Mitarbeiter, Umsatz, Einheiten und Marge.

Finde die Regionen mit der schwächsten Performance, identifiziere die Mitarbeiter mit sinkender Marge und empfiehl drei Diagramme für ein Executive Summary.

Ein solcher Test ist viel aussagekräftiger. Er zeigt Ihnen, ob das Modell lediglich „lebt“ oder ob es die interne Tabellenanalyse auf eine Weise unterstützen kann, die dem Unternehmen tatsächlich nützt.

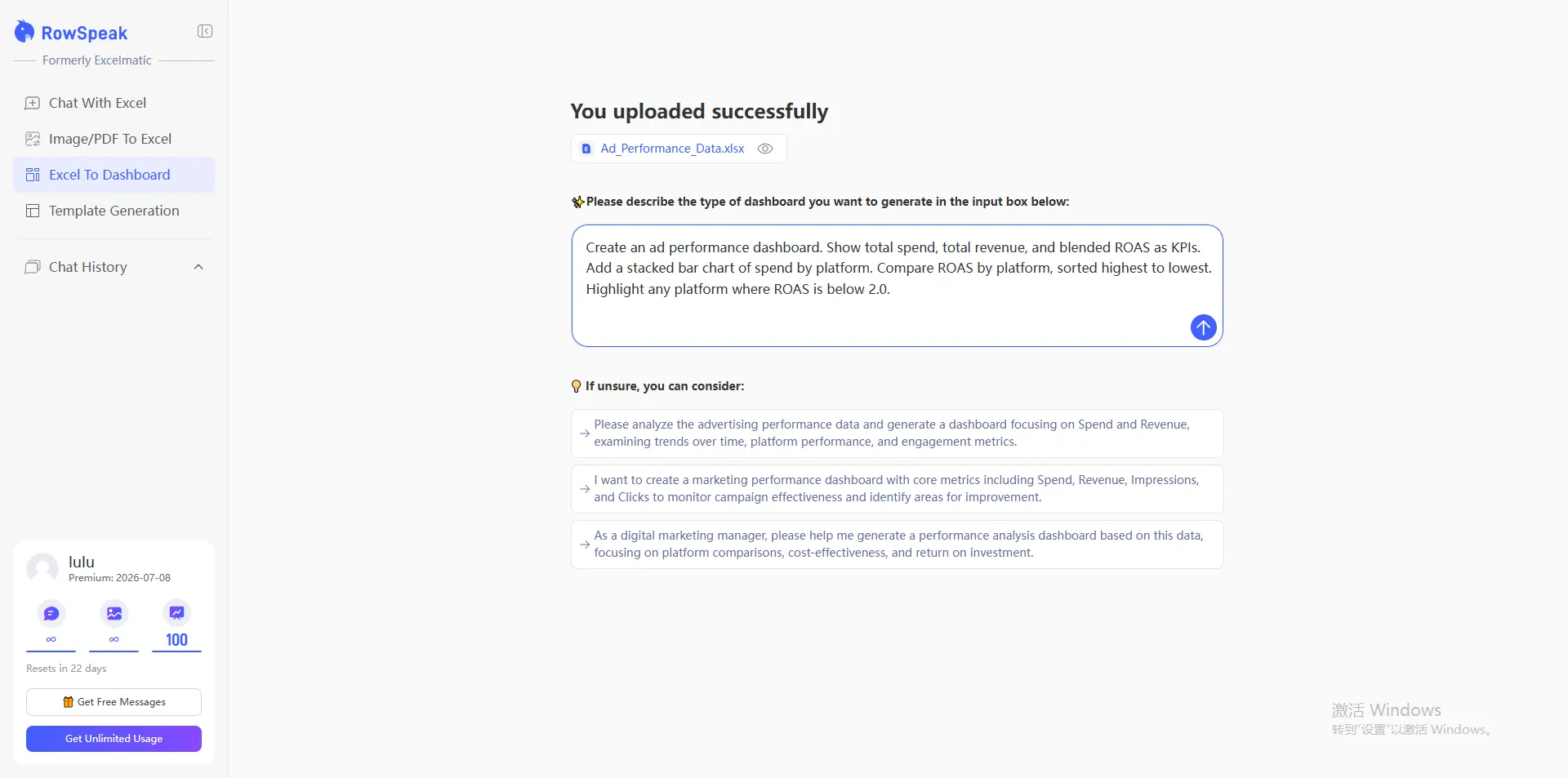

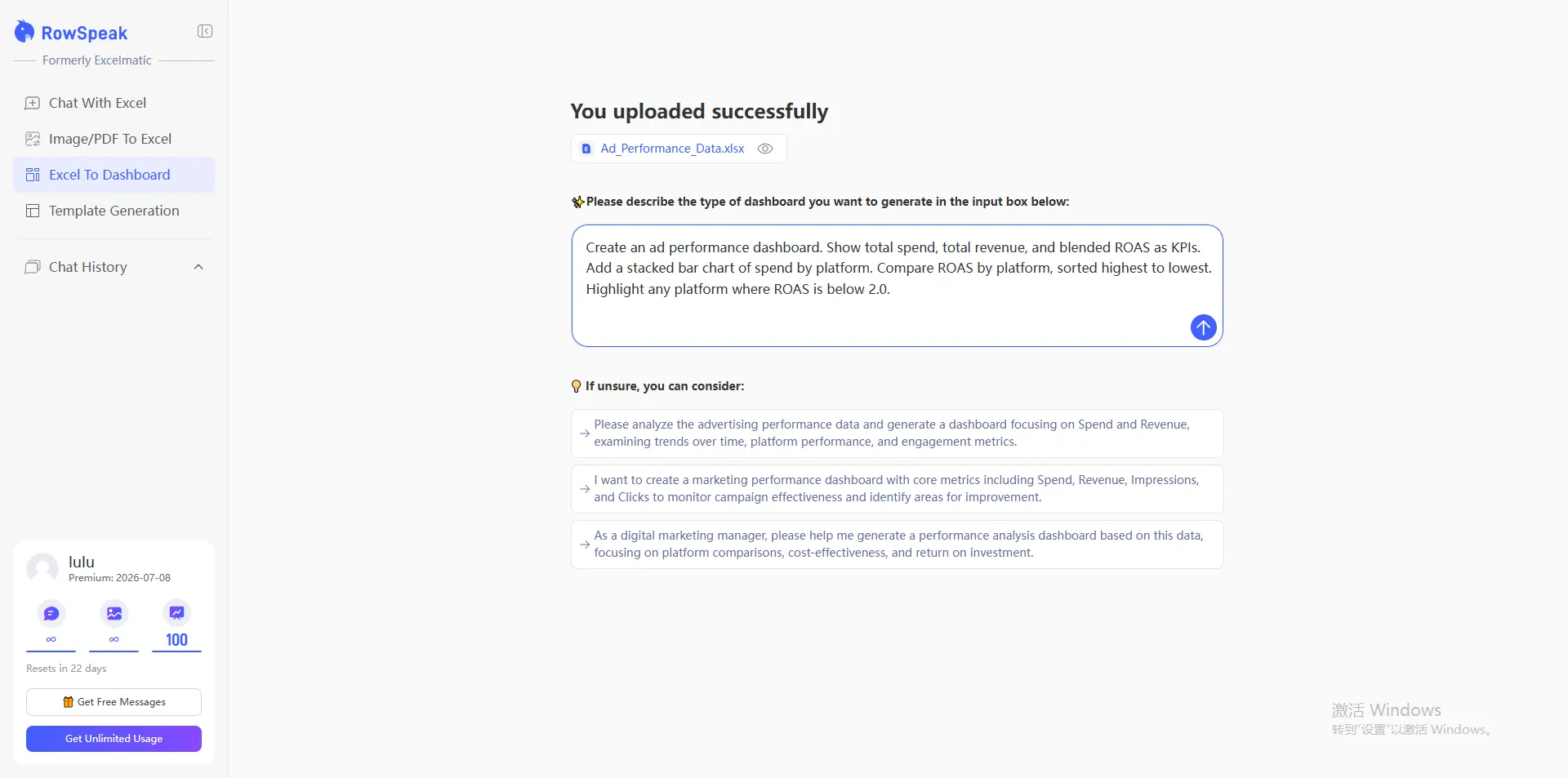

Wo RowSpeak ins Spiel kommt

Sobald der private Modell-Endpunkt funktioniert, wird RowSpeak zur Ebene, die das gesamte System für die Teams nutzbar macht.

Anstatt die Nutzer zu zwingen, in rohen Inference-Anfragen zu denken, bietet RowSpeak ihnen einen Workflow rund um Dateien und Aufgaben zur Tabellenanalyse.

Das bedeutet, sie können:

- Tabellen hochladen

- Analysefragen in natürlicher Sprache stellen

- Zusammenfassungen generieren

- Diagrammorientierte Ausgaben erstellen

- Unstrukturierte Geschäftsdaten natürlicher bearbeiten

Dies ist der wichtigste Punkt des gesamten Artikels:

Der Mehrwert ist nicht „Chatten mit einer CSV“.

Der Mehrwert besteht darin, unübersichtliche interne Tabellendaten zu nehmen, sie über einen privaten KI-Server unter Ihrer Kontrolle zu leiten und die Ergebnisse in Ausgaben zu verwandeln, die Menschen tatsächlich für KI-generiertes Reporting, Entscheidungsunterstützung und interne Workflows nutzen können.

![]()

Abschließende Validierung: Worauf es wirklich ankommt

Bevor Sie das Deployment als abgeschlossen betrachten, prüfen Sie die Dinge, die bei einem echten internen Rollout zählen:

- Bleibt der Endpunkt bei wiederholten Anfragen stabil?

- Ist die Latenz für die interne Nutzung akzeptabel?

- Ist der Modellname in der App korrekt konfiguriert?

- Sind die Netzwerkregeln und Zugriffskontrollen korrekt?

- Sind die Analyse- und Diagrammausgaben bei echten Tabellenaufgaben tatsächlich nützlich?

Den letzten Punkt überspringen viele zu oft.

Ein privates KI-Deployment ist nicht schon deshalb erfolgreich, weil der Server läuft. Es ist erfolgreich, wenn interne Nutzer sich bei ihrer täglichen Arbeit mit Tabellen darauf verlassen können, ohne sensible Daten aus der eigenen Umgebung nach außen zu senden.

![]()

Das wichtigste Fazit in Kürze

DeepSeek-V4-Flash ist nun offiziell, öffentlich und Open-Weight. Wenn Sie private KI für die interne Tabellenanalyse nutzen möchten, ist der sauberste Weg, es auf einem eigenen GPU-Server mit vLLM (oder Ollama, falls passender) bereitzustellen, die API mit Business-Prompts zu verifizieren und dann eine Workflow-Ebene wie RowSpeak darüberzulegen.

Setzen Sie dann in Ihren Umgebungsvariablen orchestrator_model=deepseek-v4-flash, und Sie können RowSpeak für interne Datenanalysen und die Erstellung von Diagrammen nutzen, ohne die Arbeit über eine öffentliche Modell-API zu leiten.

FAQ

Ist DeepSeek-V4-Flash gut für private KI-Deployments geeignet?

Ja – wenn Ihr Ziel darin besteht, ein leistungsfähiges Modell in Ihrer eigenen Umgebung für interne Anwendungsfälle wie Tabellenanalyse, Reporting oder operative Workflows zu betreiben. Der Hauptgrund für Teams, DeepSeek-V4-Flash zu wählen, ist die Verfügbarkeit einer starken Modelloption, ohne sensible interne Daten über eine öffentliche API senden zu müssen.

Sollte ich vLLM oder Ollama für ein internes Deployment verwenden?

Wenn Sie einen produktionsnahen internen KI-Server anstreben, starten Sie mit vLLM. Für einen schnellen Proof-of-Concept oder einen einfacheren lokalen Pfad kann Ollama gut geeignet sein. In der Praxis nutzen viele Teams Ollama zum Experimentieren und vLLM für den operativen Betrieb.

Was sollte ich testen, bevor ich das Deployment als erfolgreich bezeichne?

Geben Sie sich nicht mit „der Server hat geantwortet“ zufrieden. Testen Sie die Stabilität unter Last, die Latenz, die Korrektheit der Zugriffskontrollen und ob die Ergebnisse bei realen Tabellenanalysen aus den Bereichen Finanzen oder Operations tatsächlich nützlich sind.

Geht es hier wirklich um Tabellenanalyse oder nur um allgemeinen Chat?

Für die meisten Geschäftskunden liegt der Wert nicht im allgemeinen Chat. Der Wert liegt darin, einen privaten KI-Server zu nutzen, um internen Teams bei der Arbeit mit Tabellen, CSV-Exporten, Berichten und anderen strukturierten Geschäftsdaten zu helfen, ohne diese Arbeit außerhalb des Unternehmensumfelds preiszugeben.

Welche Rolle spielt RowSpeak in dieser Architektur?

RowSpeak ist die Workflow-Ebene über dem privaten Modell-Endpunkt. Anstatt Nutzer direkt mit einer Modell-API interagieren zu lassen, bietet es ein auf Tabellen spezialisiertes Interface für Uploads, Fragen, Zusammenfassungen und diagrammfertige Ausgaben.

Benötigen Sie ein privates Deployment für Ihr Team?

Wenn Sie KI für interne Tabellenanalysen nutzen möchten, ohne sensible Daten an eine öffentliche API zu senden, kann RowSpeak Ihnen helfen, ein selbst gehostetes Modell in einen nutzbaren internen Workflow zu verwandeln.

Ein typisches Enterprise-Setup kann Folgendes umfassen:

- Private oder On-Prem-Bereitstellungsoptionen

- Anbindung an Ihren eigenen Modell-Endpunkt

- Auf Tabellen fokussierte Analyse-Workflows

- Unterstützung für Finanz-, Operations- und Reporting-Teams

- Kontrollen, die auf interne Datensicherheitsanforderungen abgestimmt sind

Wenn Sie ein privates KI-Rollout evaluieren und einen funktionierenden Pfad suchen – nicht nur eine Modelldemo – kontaktieren Sie RowSpeak, um Ihren Anwendungsfall zu besprechen.