El debate sobre los LLM locales y las API de IA públicas suele ser demasiado simplista.

Un bando sostiene que todas las empresas deberían ejecutar modelos localmente. El otro afirma que las API de IA empresariales son lo suficientemente seguras y mucho más fáciles de operar.

Para los datos sensibles de Excel, la respuesta más acertada es más práctica: adaptar la arquitectura a la sensibilidad de la hoja de cálculo, a la madurez de sus procesos de seguridad y al flujo de trabajo que los usuarios realmente necesitan.

Una API pública, un servicio de IA empresarial, un modelo local, un despliegue en una VPC privada y un flujo de trabajo con anonimización híbrida pueden ser opciones correctas según la situación.

Por qué los datos de Excel requieren un cuidado especial

Es fácil subestimar las hojas de cálculo.

A menudo contienen datos que nunca llegaron a un sistema de BI gobernado:

- ingresos a nivel de cliente

- salarios y comisiones

- previsiones

- presupuestos

- cifras para informes de la junta directiva

- condiciones de proveedores

- exportaciones de soporte

- registros fiscales

- excepciones operativas

- información de identificación personal (PII)

Cuando un empleado sube ese archivo a un chatbot, la empresa puede perder el control sobre el destino de los datos, cuánto tiempo se conservan, quién puede acceder a ellos y si la acción cumple con las políticas internas.

El riesgo no es solo técnico, sino procedimental. La mayoría de las cargas de hojas de cálculo ocurren fuera de la ruta normal de gobernanza de datos.

Las cinco opciones principales

1. Chatbot público

Es el camino más sencillo. Un usuario abre un chatbot, sube un archivo y solicita un análisis.

Puede ser aceptable para datos públicos o sintéticos, pero es arriesgado para archivos confidenciales, a menos que la organización haya aprobado explícitamente esa herramienta y ese caso de uso.

El principal beneficio es la velocidad; el riesgo principal es la exposición descontrolada de datos.

2. API pública

Una API pública ofrece a los desarrolladores más control que un chatbot de consumo. Pueden crear una aplicación interna, limitar lo que se envía y gestionar los prompts con mayor cuidado.

Sin embargo, los datos siguen saliendo del entorno de la empresa. Los términos del proveedor sobre el uso de datos, retención, registro y cumplimiento son fundamentales.

Para muchas empresas, esto puede funcionar tras una revisión del proveedor y con el contrato adecuado. No debe considerarse automáticamente seguro.

3. Servicio de IA empresarial

Las plataformas de IA empresarial suelen ofrecer compromisos de privacidad más sólidos, controles de administración, cifrado, compromiso de no entrenamiento con los datos, opciones de retención y documentación de cumplimiento.

Ejemplos de esto son las ofertas empresariales de OpenAI, Microsoft Azure OpenAI, AWS Bedrock, Google Vertex AI, Anthropic y otros.

Suele ser el mejor camino intermedio para empresas que buscan una alta calidad de modelos sin tener que operar su propia infraestructura de GPU.

La desventaja es que el procesamiento sigue ocurriendo fuera de los servidores propios de la empresa, aunque sea bajo controles empresariales estrictos.

4. LLM local

Un LLM local se ejecuta en una computadora portátil, estación de trabajo, servidor o un equipo con GPU interno.

La ventaja principal es el control. Los datos permanecen dentro de la máquina o la red. Esto es útil para prototipos, experimentos con datos sensibles o casos de uso sin conexión a internet.

Las desventajas son reales:

- la calidad del modelo puede ser inferior a la de las API de vanguardia

- la configuración puede ser inestable

- las GPU pueden ser costosas

- el monitoreo es limitado a menos que se desarrolle internamente

- el control de acceso y los registros de auditoría son responsabilidad del usuario

- "local" no significa automáticamente "en cumplimiento" (compliant)

5. Despliegue en VPC privada o local (on-prem)

Esta es la versión empresarial de la IA local.

El modelo se ejecuta en un entorno controlado, generalmente con políticas de identidad, red, registro, almacenamiento y seguridad a su alrededor. El equipo puede exponer una API interna y conectarla a aplicaciones aprobadas.

Es la ruta más sólida para flujos de trabajo con hojas de cálculo altamente sensibles, pero requiere madurez operativa.

Un marco de decisión práctico

Utilice la sensibilidad de los datos como primer filtro.

| Tipo de hoja de cálculo | Ruta de IA razonable |

|---|---|

| Datos públicos o ejemplos | Chatbot público o API |

| Datos internos de bajo riesgo | Servicio de IA empresarial aprobado |

| Datos empresariales confidenciales | API empresarial con controles contractuales, VPC privada o app interna aprobada |

| Datos regulados o altamente sensibles | VPC privada, on-prem, entorno aislado (air-gapped) o flujo con anonimización |

| Sensibilidad desconocida | No subir hasta que se clasifiquen |

Luego, hágase una pregunta operativa: ¿quién mantendrá el sistema?

Si la empresa no tiene capacidad para operar GPUs, parchear servidores de modelos, monitorear registros y evaluar resultados, un despliegue totalmente local puede crear un nuevo riesgo. En ese caso, un servicio de IA empresarial con controles estrictos puede ser más seguro que un modelo local sin gestionar.

Local no significa automáticamente seguro

Un modelo local aún puede filtrar o gestionar mal los datos si el sistema que lo rodea es débil.

Los errores comunes incluyen:

- almacenar archivos subidos en una carpeta sin cifrar

- registrar prompts que contienen valores sensibles

- dar acceso a todos los usuarios a todos los archivos

- permitir que el código generado acceda a la red

- no parchear la máquina host

- copiar resultados en herramientas no gestionadas

- usar modelos o paquetes de fuentes no confiables

La privacidad es una propiedad de la arquitectura, no solo de la ubicación del modelo.

Una API pública no significa automáticamente inseguro

Lo contrario también es cierto.

Las API de IA empresariales pueden proporcionar controles sólidos. Algunos proveedores declaran que los datos de clientes empresariales o de API no se utilizan para entrenar modelos de forma predeterminada. Los proveedores de la nube pueden ofrecer redes privadas, IAM, cifrado, registros de auditoría y controles de retención de datos.

La pregunta correcta debe ser específica:

- ¿Qué plan de producto?

- ¿Qué contrato?

- ¿Qué configuración de retención?

- ¿Qué región?

- ¿Qué registros?

- ¿Qué usuarios?

- ¿Qué datos de la hoja de cálculo?

Una API pública con controles empresariales puede ser aceptable para muchos flujos de trabajo. Una carga aleatoria en un chatbot común podría no serlo.

Cómo es un flujo de trabajo ideal para Excel sensible

Para el análisis de hojas de cálculo sensibles, un buen flujo de trabajo debería:

- clasificar los datos antes del análisis

- mantener los archivos en un almacenamiento aprobado

- aplicar permisos de usuario

- usar herramientas deterministas para los cálculos

- enviar solo el contexto necesario al modelo

- evitar fugas de datos hacia el exterior desde las herramientas

- citar filas, hojas, fórmulas o consultas de origen

- registrar prompts, herramientas, acceso a datos y resultados

- permitir que los administradores controlen la retención

- admitir endpoints de modelos privados o aprobados por la empresa

Esto ofrece a los equipos un equilibrio práctico: la utilidad de la IA sin el comportamiento descontrolado de copiar y pegar.

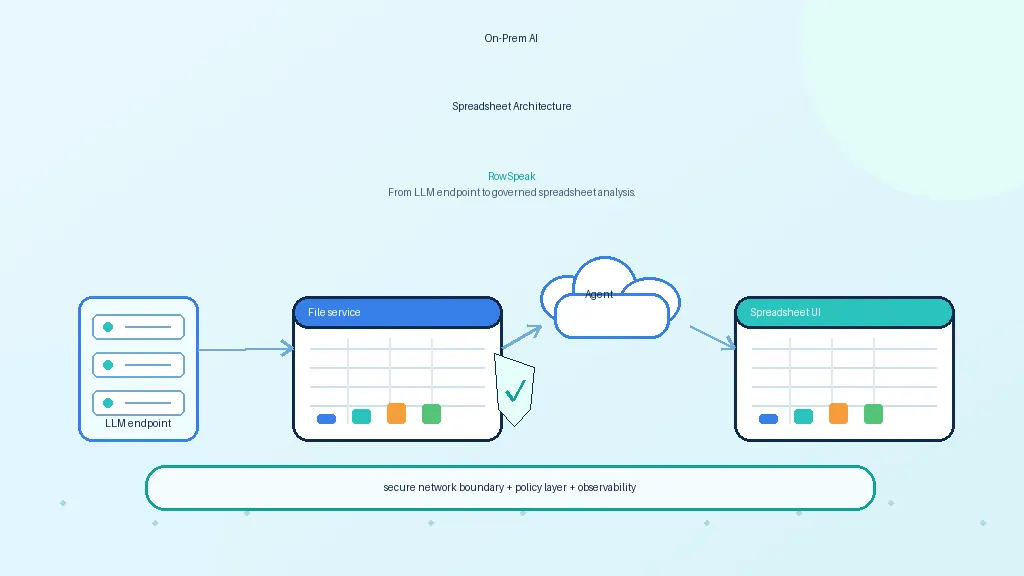

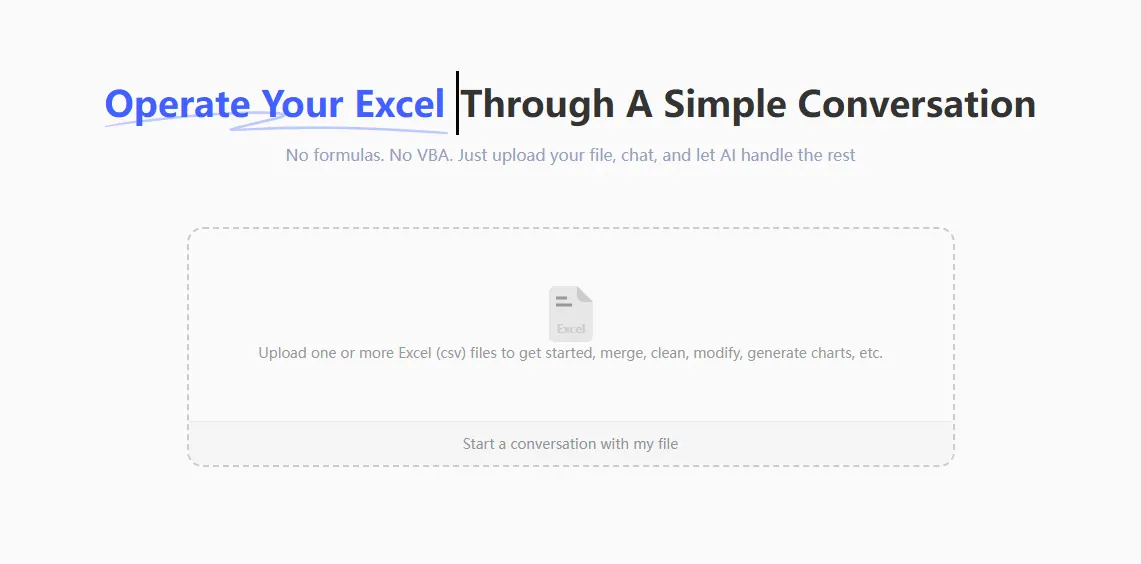

Dónde encaja RowSpeak

RowSpeak es una capa de flujo de trabajo para el análisis de hojas de cálculo. Eso significa que puede funcionar sobre diferentes opciones de modelos.

Para un equipo con menor riesgo, el endpoint del modelo puede ser una API empresarial aprobada. Para un despliegue sensible, puede ser un LLM privado ejecutándose en la infraestructura del cliente. En ambos casos, la experiencia del usuario se mantiene enfocada en la tarea: cargar datos, hacer preguntas, generar gráficos, revisar evidencias y convertir archivos de Excel en tableros con un flujo de trabajo de Excel a tablero.

El modelo es reemplazable. El flujo de trabajo gobernado es la parte duradera. Por eso, esta decisión suele ir de la mano con una planificación de inteligencia de negocios con IA más amplia, y no solo con la selección del modelo.

Lista de verificación final

Antes de elegir un LLM local o una API pública para el análisis de Excel, responda estas preguntas:

- ¿Cuál es el campo más sensible en el libro de trabajo?

- ¿Está la herramienta aprobada para esa clase de datos?

- ¿El proveedor entrena sus modelos con los prompts, archivos o resultados?

- ¿Dónde se procesan y retienen los datos?

- ¿Puede utilizar muestras anonimizadas en su lugar?

- ¿Necesitan los usuarios permisos a nivel de fila o de archivo?

- ¿Se realizan los cálculos de forma determinista?

- ¿Son auditables las respuestas?

- ¿Quién mantiene el modelo y la infraestructura?

- ¿Qué sucede cuando el modelo se equivoca?

La mejor arquitectura rara vez es la más ideológica. Es la que brinda a los usuarios ayuda analítica real mientras se ajusta al nivel de riesgo de la hoja de cálculo. Si la duda principal es la adecuación del proveedor, también puede ser útil comparar opciones familiares como Copilot en Excel frente a herramientas de flujo de trabajo privado.

Fuentes y lecturas adicionales

- Privacidad empresarial de OpenAI: https://openai.com/enterprise-privacy/

- Preguntas frecuentes de AWS Bedrock: https://aws.amazon.com/bedrock/faqs/

- Gobernanza de datos en Google Vertex AI / retención de datos cero: https://docs.cloud.google.com/vertex-ai/generative-ai/docs/vertex-ai-zero-data-retention

- Servidor vLLM compatible con OpenAI: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Biblioteca Ollama: https://ollama.com/library