DeepSeek-V4-Flash ya es oficial, público y de pesos abiertos (open-weight).

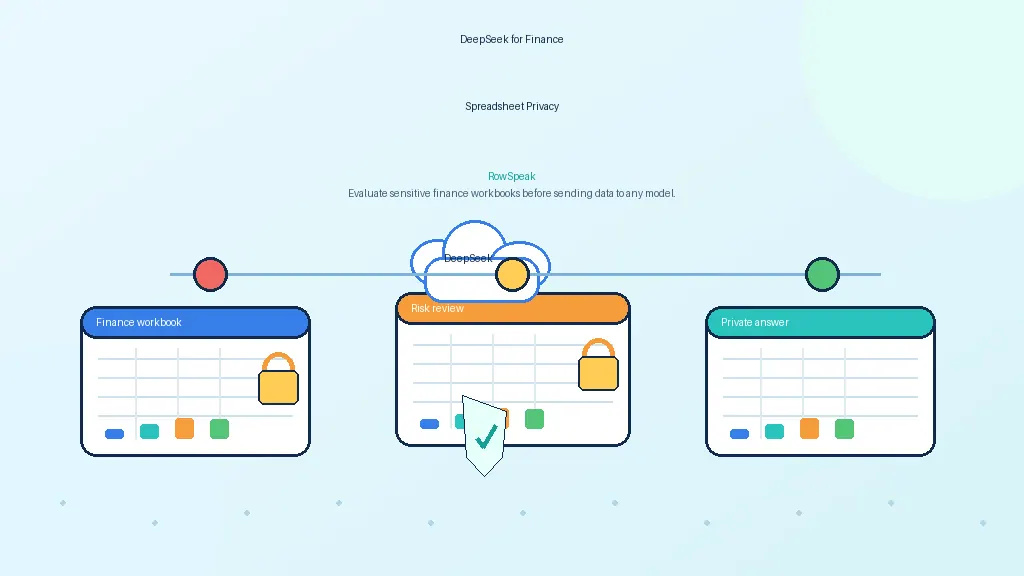

Esto es fundamental para un perfil de comprador muy específico: equipos que necesitan capacidades avanzadas de IA sin enviar datos confidenciales de hojas de cálculo a una API externa.

Si estás evaluando IA privada para informes financieros, libros de trabajo operativos, exportaciones internas o análisis recurrentes de hojas de cálculo, la duda ya no es solo si un modelo como este puede ejecutarse en tu propia infraestructura. La verdadera pregunta es si puedes convertirlo en un servicio interno seguro que la gente realmente use.

Este artículo está diseñado para ayudarte con eso.

Específicamente, detalla una configuración práctica de IA privada para el análisis interno de hojas de cálculo:

- Ejecutar DeepSeek-V4-Flash en tu propio servidor GPU.

- Exponerlo como una API de inferencia privada.

- Validar que el endpoint funcione con prompts de estilo empresarial.

- Conectarlo a una capa de flujo de trabajo como RowSpeak para que los usuarios no técnicos puedan analizar datos de hojas de cálculo sin lidiar con llamadas directas al modelo.

Este no es un artículo sobre "chatear con un modelo". Se trata de construir un servidor de IA privado capaz de soportar flujos de trabajo reales con hojas de cálculo internas.

Por qué los equipos buscan un servidor de IA privado para el análisis de hojas de cálculo

Cuando se habla de auto-hospedaje (self-hosting), a menudo parece una cuestión ideológica. En realidad, la motivación suele ser operativa y comercial.

Un equipo de finanzas no quiere que sus hojas de cálculo de informes para la junta pasen por una API pública si puede evitarlo, especialmente cuando esos archivos sustentan flujos de trabajo de informes de gestión. Un equipo de operaciones no quiere que sus rastreadores internos, exportaciones de ingresos y libros de trabajo interfuncionales salgan de su entorno solo para realizar un análisis. Y un equipo de TI o seguridad suele querer algo aún más simple: un endpoint de modelo que puedan controlar, monitorear, auditar y restringir como el resto de sus sistemas internos.

Ahí es donde DeepSeek-V4-Flash resulta atractivo.

DeepSeek se ha convertido rápidamente en parte de la conversación sobre IA privada porque los equipos lo ven ahora como una base realista para despliegues internos.

Es lo suficientemente potente como para que valga la pena desplegarlo, y lo suficientemente abierto como para que un despliegue de IA privada sea viable.

Si tu caso de uso es un chat casual para consumidores, una API alojada sigue siendo la opción más sencilla.

Pero si tu carga de trabajo real se parece más a esto:

- Libros de trabajo financieros

- Informes de ventas semanales

- Tablas de BI exportadas

- Volcados de CSV de sistemas internos

- Hojas de cálculo operativas complejas que aún impulsan decisiones importantes

entonces la ruta del servidor privado empieza a ser mucho más convincente.

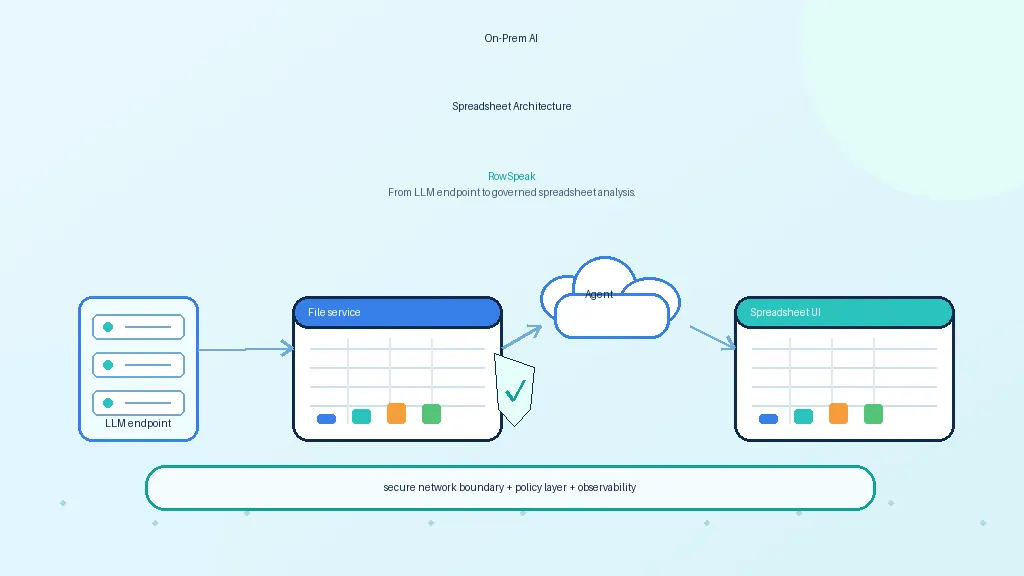

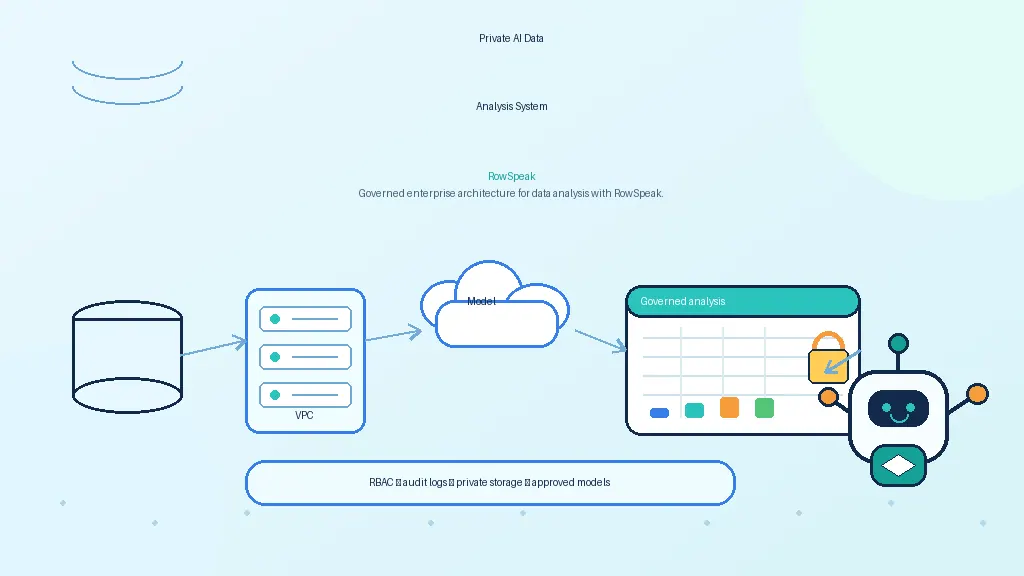

Qué estás construyendo realmente

La buena noticia es que la arquitectura en sí es sencilla.

No necesitas una plataforma de IA gigante para obtener valor. Necesitas cuatro cosas:

- Un servidor GPU bajo tu control

- Un entorno de ejecución (runtime) para el modelo

- Un endpoint de API privado

- Una capa de flujo de trabajo sobre ese endpoint para los usuarios finales

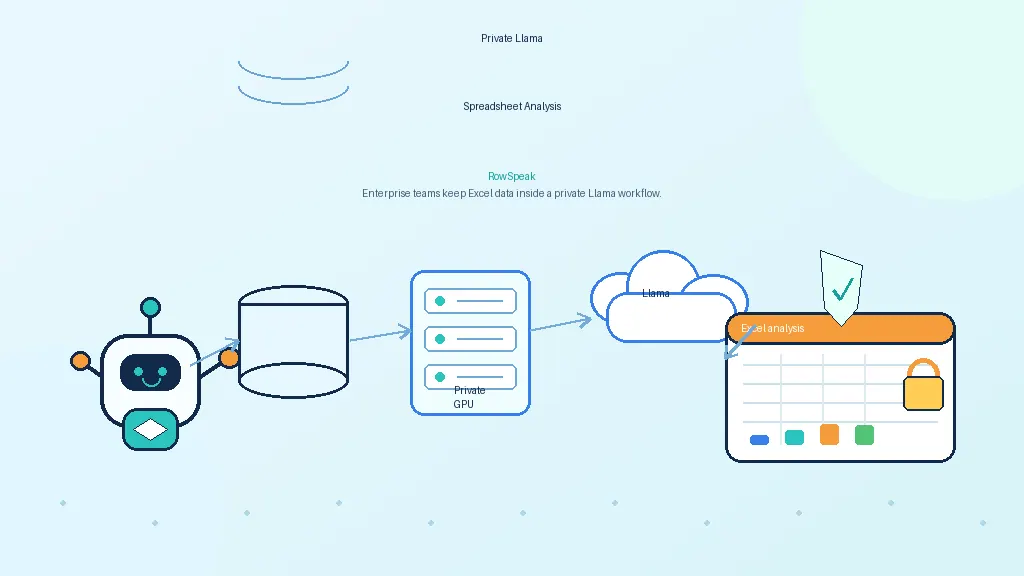

En esta configuración:

- DeepSeek-V4-Flash es el modelo.

- vLLM u Ollama es la capa de servicio.

- RowSpeak es la capa de flujo de trabajo que convierte el acceso al modelo en tareas de análisis de hojas de cálculo.

Esa separación es importante porque permite que cada capa se mantenga enfocada.

El servidor del modelo gestiona la inferencia. La capa de flujo de trabajo gestiona la compleja realidad del uso empresarial: carga de archivos, contexto de la hoja de cálculo y preguntas en lenguaje natural, resúmenes y resultados listos para gráficos.

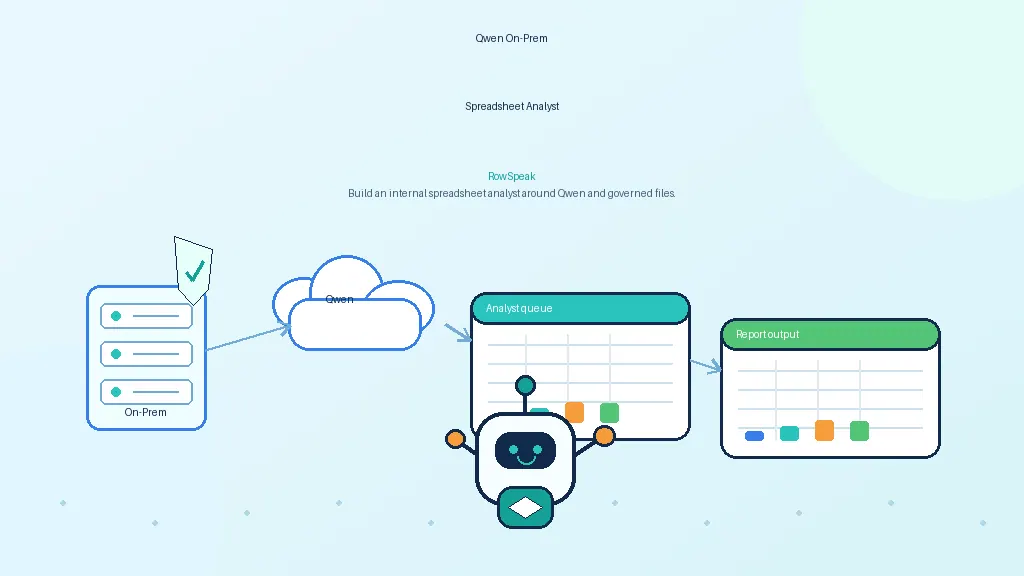

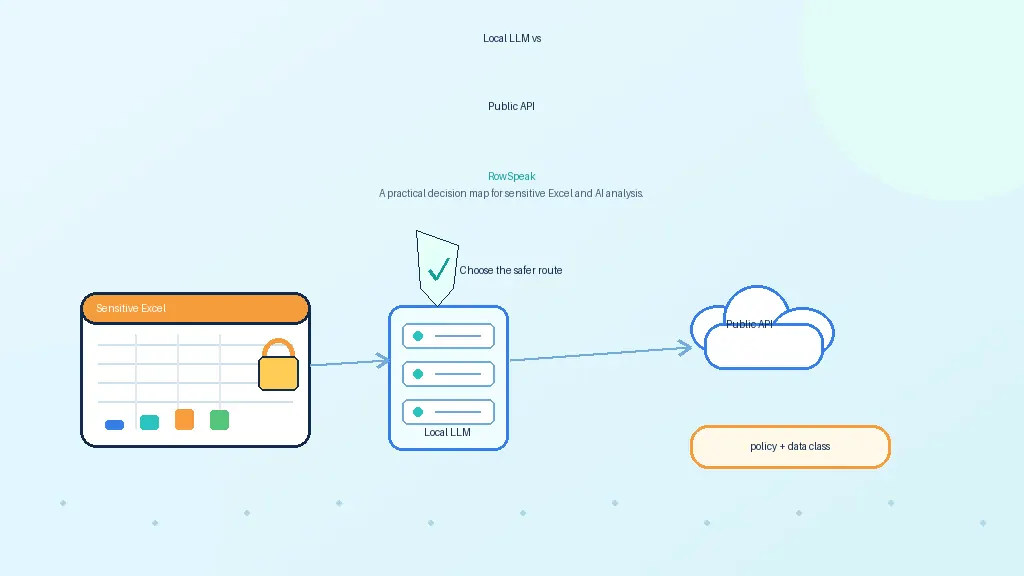

¿Qué ruta de despliegue tiene más sentido?

Existen dos rutas realistas, y la elección correcta depende del tipo de servicio interno que intentes operar.

Opción 1: vLLM

Si estás construyendo un endpoint de IA interno serio para uso empresarial recurrente, esta es la ruta que recomendaría primero.

La razón es directa: vLLM es una pila de servicio orientada a producción, y su API compatible con OpenAI facilita la integración. Si tu objetivo es poner DeepSeek-V4-Flash detrás de un flujo de trabajo interno de análisis de hojas de cálculo, la compatibilidad de la API y el control del despliegue son fundamentales.

Opción 2: Ollama

Ollama es la opción más cómoda cuando el empaquetado del modelo y el soporte del runtime coinciden con lo que quieres desplegar.

Es más fácil de poner en marcha, y para escenarios internos más ligeros o pruebas de concepto rápidas, puede ser una elección sensata.

Pero si tuviera que resumir la decisión en una frase, sería esta:

Usa vLLM cuando quieras un servidor de IA privado de estilo producción, y usa Ollama cuando la velocidad y la simplicidad importen más que el control de la infraestructura.

Antes de empezar: revisa el servidor, no solo la idea

El hardware exacto que necesitas depende del artefacto específico de DeepSeek-V4-Flash que elijas, la precisión deseada, la longitud del contexto y la concurrencia que esperes.

Por eso, los consejos genéricos de "necesitas X GPUs" suelen ser engañosos.

El mejor enfoque es partir del artefacto oficial del modelo y dimensionar la máquina en función de lo que planeas servir realmente.

Como mínimo, tu servidor debería tener:

- Linux bajo tu control

- GPUs NVIDIA

- Instalación correcta de controladores

- Un entorno CUDA funcional

- Python instalado

- Suficiente VRAM para el artefacto del modelo que elijas

Antes de hacer cualquier otra cosa, realiza una comprobación básica:

nvidia-smi

python3 --version

Parece básico, pero vale la pena hacerlo. Una cantidad sorprendente de problemas de despliegue no son problemas del modelo en absoluto, sino problemas de controladores, del entorno o simples errores de preparación de la máquina.

Despliegue con vLLM

Si quieres la ruta más limpia para un "despliegue real", comienza aquí.

Paso 1: Instalar vLLM en un entorno limpio

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

Documentación útil:

Paso 2: Usar el artefacto oficial de DeepSeek

Este es uno de esos puntos donde un pequeño atajo puede causar muchos problemas después.

Evita empezar desde mirrors aleatorios si puedes. Comienza desde la página oficial de lanzamientos de DeepSeek y luego sigue la colección oficial de Hugging Face vinculada allí.

Eso te da una trazabilidad más limpia y reduce las probabilidades de desplegar algo incorrecto.

Página oficial de DeepSeek anunciando V4-Flash como parte del lanzamiento de DeepSeek V4 Preview.

Paso 3: Iniciar el servidor de la API

Un inicio típico de vLLM se ve así:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

Dependiendo del artefacto del modelo y de la máquina, es posible que también necesites ajustar:

- Paralelismo de tensores (tensor parallelism)

- dtype

- Longitud máxima del modelo

- Utilización de la memoria GPU

Pero la idea básica es la misma. Lanza el modelo, expón el endpoint y asegúrate de que la capa de servicio sea estable antes de tocar la parte de la aplicación.

Paso 4: Probar el endpoint como una API, no como una demo

Antes de conectar RowSpeak o cualquier otra herramienta, verifica que el servidor del modelo responda correctamente por sí solo.

Por ejemplo:

curl http://TU_IP_DEL_SERVIDOR:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "Resume los beneficios de auto-hospedar un LLM para el análisis de hojas de cálculo."}

]

}'

Si el servidor devuelve una respuesta válida, la ruta principal de servicio está funcionando.

En este punto, resiste la tentación de complicar la prueba. No estás haciendo un benchmark de todo el sistema todavía. Estás comprobando que el endpoint esté activo, que el modelo se cargue correctamente y que la API se comporte como tu aplicación espera.

Despliegue con Ollama

Ollama es la ruta más ligera y, cuando el empaquetado encaja, puede ser la forma más rápida de poner en marcha un despliegue utilizable.

Lo importante es no tratarlo como una respuesta universal. Es la opción adecuada cuando la versión exacta de DeepSeek que deseas está disponible en un formato que Ollama pueda servir limpiamente.

Documentación oficial:

Instálalo primero:

curl -fsSL https://ollama.com/install.sh | sh

Luego, descarga o registra el modelo en el formato que soporte tu configuración de Ollama y pruébalo directamente antes de intentar integrarlo en cualquier otro lugar.

Una prueba local mínima se ve así:

ollama run TU_MODELO_DEEPSEEK

Si lo estás exponiendo a través de la API de Ollama, prueba esa API directamente primero.

Prueba con un prompt de negocio, no con uno de juguete

Esta parte es fácil de subestimar.

Muchos despliegues de IA privada se declaran "funcionales" porque alguien le pidió al endpoint que saludara, resumiera un párrafo o escribiera un chiste. Eso no te dice casi nada sobre si el sistema es útil para el trabajo interno que realmente te importa.

Si tu objetivo es el análisis de hojas de cálculo, la prueba más inteligente es usar el tipo de prompt que realmente interesaría a tus equipos de finanzas, operaciones o informes de IA.

Por ejemplo:

Tengo una hoja de cálculo de ventas semanales con columnas para región, representante, ingresos, unidades y margen.

Encuentra las regiones con peor desempeño, identifica a los representantes con margen decreciente y recomienda tres gráficos para un resumen ejecutivo.

Ese tipo de prueba es mucho más reveladora. Te indica si el modelo simplemente está "vivo" o si puede soportar el análisis interno de hojas de cálculo de una manera que sea realmente útil para el negocio.

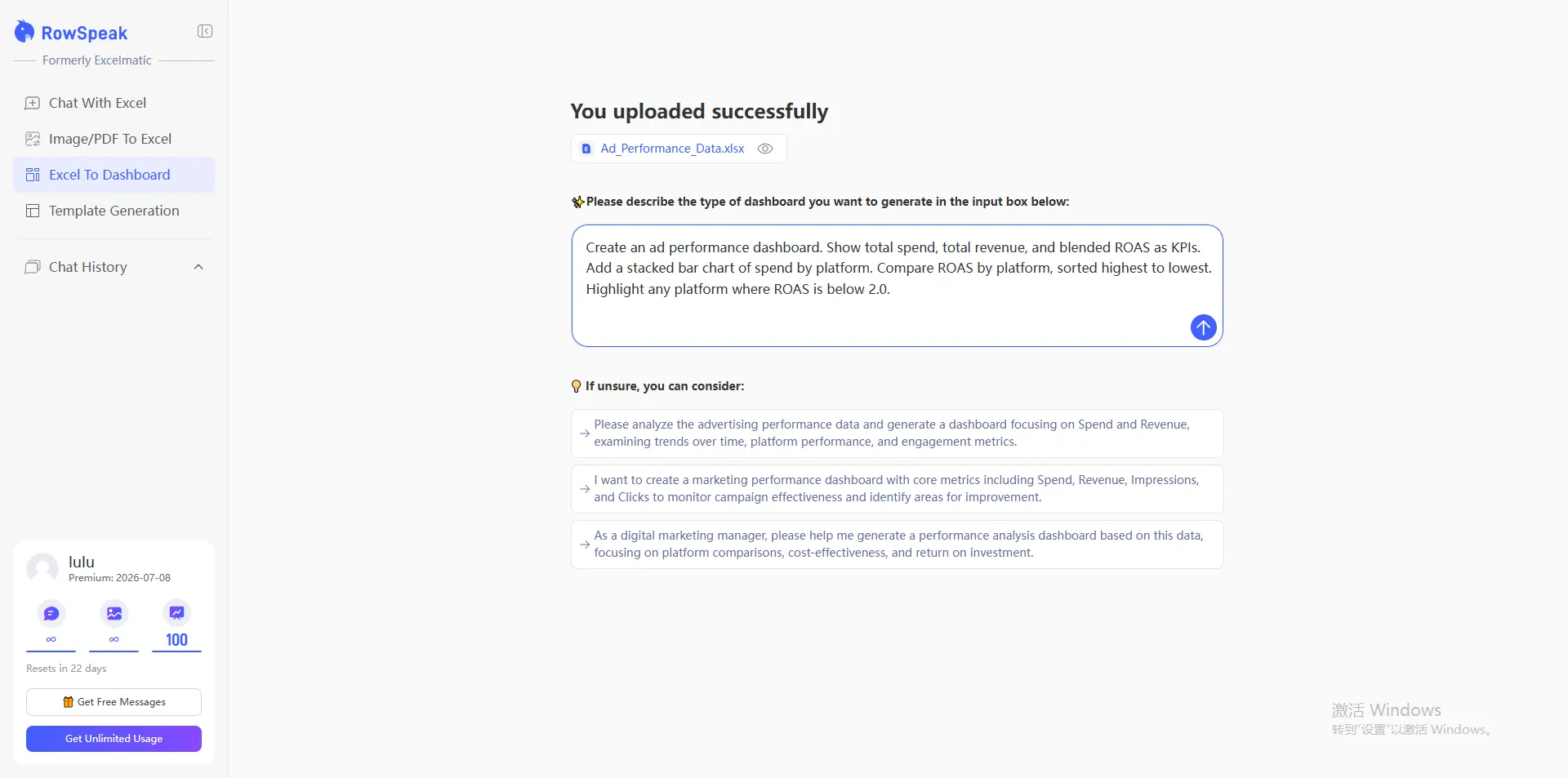

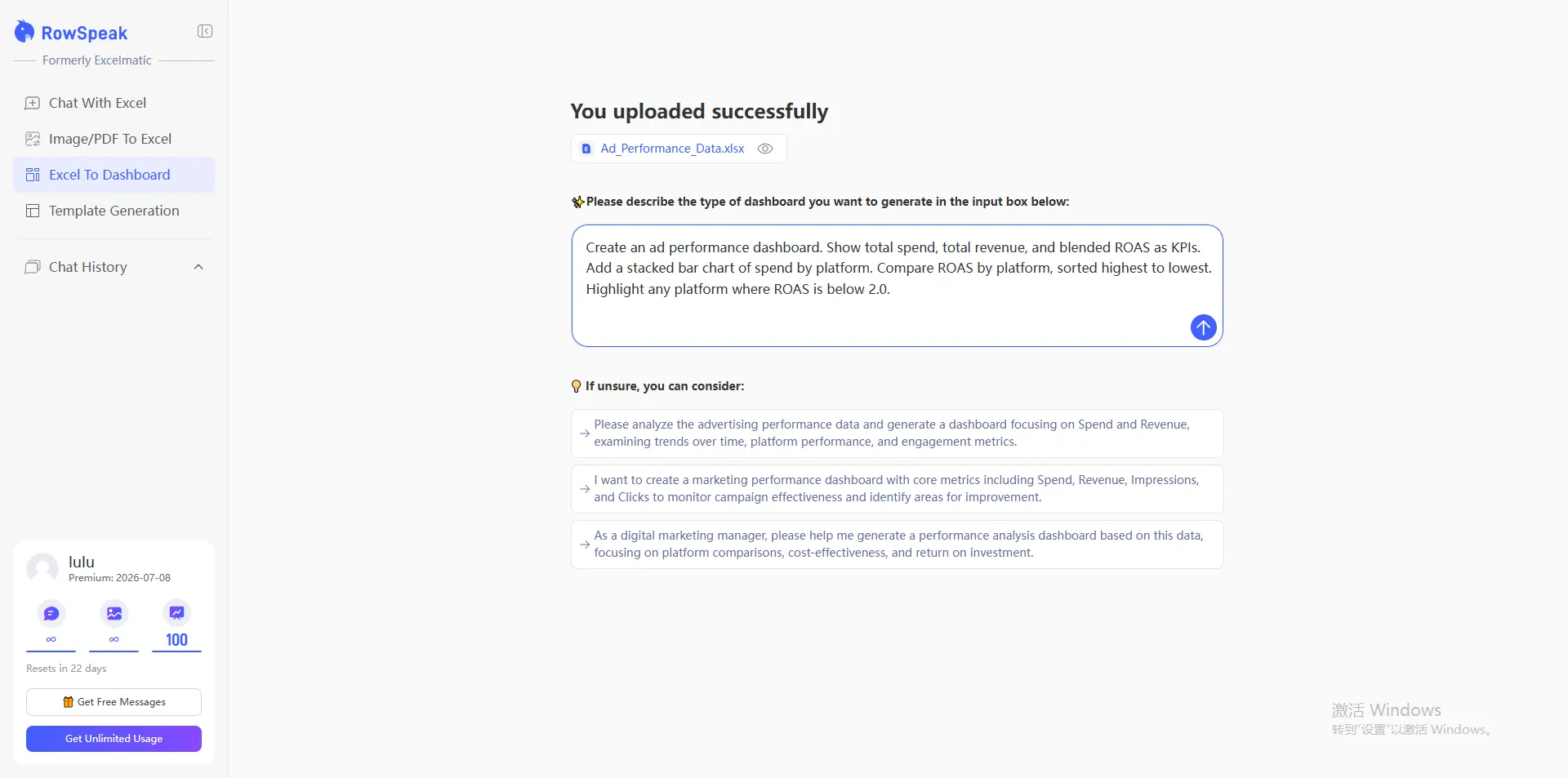

Dónde encaja RowSpeak

Una vez que el endpoint del modelo privado funciona, RowSpeak se convierte en la capa que hace que todo el sistema sea utilizable para los equipos reales.

En lugar de obligar a los usuarios a pensar en solicitudes de inferencia en bruto, RowSpeak les ofrece un flujo de trabajo centrado en archivos y tareas de análisis de hojas de cálculo.

Esto significa que pueden:

- Cargar hojas de cálculo

- Hacer preguntas de análisis en lenguaje natural

- Generar resúmenes

- Crear resultados orientados a gráficos

- Trabajar con datos empresariales complejos de forma más natural

Este es el enfoque más importante de todo el artículo:

El valor no es "chatear con un CSV".

El valor reside en tomar datos internos complejos de hojas de cálculo, canalizarlos a través de un servidor de IA privado que tú controlas y convertir los resultados en salidas que la gente pueda usar realmente para informes generados por IA, apoyo en la toma de decisiones y flujos de trabajo internos.

![]()

Validación final: lo que realmente importa

Antes de dar por finalizado el despliegue, comprueba los aspectos que importan en un despliegue interno real:

- ¿El endpoint se mantiene estable bajo solicitudes repetidas?

- ¿La latencia es aceptable para el uso interno real?

- ¿El nombre del modelo está configurado correctamente en la aplicación?

- ¿Son correctas las reglas de red y los controles de acceso?

- ¿Son realmente útiles los análisis y los gráficos resultantes en tareas reales de hojas de cálculo?

Ese último punto es el que se suele omitir con demasiada frecuencia.

Un despliegue de IA privada no tiene éxito solo porque el servidor esté funcionando. Tiene éxito cuando los usuarios internos pueden confiar en él para el trabajo real con hojas de cálculo sin enviar datos confidenciales fuera de su entorno.

![]()

La conclusión más directa

DeepSeek-V4-Flash ya es oficial, público y de pesos abiertos. Si quieres ejecutar una IA privada para el análisis interno de hojas de cálculo, el camino más limpio es desplegarlo en tu propio servidor GPU con vLLM primero (o Ollama si encaja mejor), verificar la API con prompts de estilo empresarial y luego conectar una capa de flujo de trabajo como RowSpeak encima.

Luego, en tus variables de entorno, configura orchestrator_model=deepseek-v4-flash, y podrás usar RowSpeak para el análisis de datos internos y la generación de gráficos sin canalizar el trabajo a través de una API de modelo pública.

FAQ

¿Es DeepSeek-V4-Flash una buena opción para despliegues de IA privada?

Sí, si tu objetivo es ejecutar un modelo capaz dentro de tu propio entorno para casos de uso internos como análisis de hojas de cálculo, soporte de informes o flujos de trabajo operativos. La razón principal por la que los equipos eligen DeepSeek-V4-Flash es que les ofrece una opción de modelo potente sin exponer datos internos confidenciales a una API pública.

¿Debería usar vLLM u Ollama para un despliegue interno?

Si buscas un servidor de IA interno de nivel producción, comienza con vLLM. Si necesitas una prueba de concepto rápida o una ruta de despliegue local más sencilla, Ollama puede ser una buena opción. En la práctica, muchos equipos usan Ollama para explorar y vLLM para operacionalizar.

¿Qué debo probar antes de considerar exitoso el despliegue?

No te detengas en "el servidor respondió". Prueba si el endpoint es estable, si la latencia es aceptable, si los controles de acceso son correctos y si los resultados son realmente útiles en tareas reales de análisis de hojas de cálculo de los equipos de finanzas, operaciones o informes.

¿Se trata realmente de análisis de hojas de cálculo o solo de chat general?

Para la mayoría de los compradores empresariales, el valor no es el chat genérico. El valor es usar un servidor de IA privado para ayudar a los equipos internos a trabajar con hojas de cálculo, exportaciones CSV, informes y otros datos empresariales estructurados sin exponer ese trabajo fuera del entorno de la empresa.

¿Dónde encaja RowSpeak en esta arquitectura?

RowSpeak es la capa de flujo de trabajo sobre el endpoint del modelo privado. En lugar de pedir a los usuarios que interactúen con una API de modelo en bruto, les proporciona una interfaz centrada en hojas de cálculo para cargas, preguntas, resúmenes y resultados listos para gráficos.

¿Necesitas un despliegue privado para tu equipo?

Si quieres usar IA para el análisis interno de hojas de cálculo sin enviar datos confidenciales a una API pública, RowSpeak puede ayudarte a convertir un modelo auto-hospedado en un flujo de trabajo interno utilizable.

Una configuración empresarial típica puede incluir:

- Opciones de despliegue privado u on-prem

- Conexión a tu propio endpoint de modelo

- Flujos de trabajo de análisis centrados en hojas de cálculo

- Soporte para equipos de finanzas, operaciones e informes

- Controles alineados con los requisitos internos de seguridad de datos

Si estás evaluando un despliegue de IA privada y quieres una ruta funcional —no solo una demo de un modelo— contacta con RowSpeak para analizar tu caso de uso.