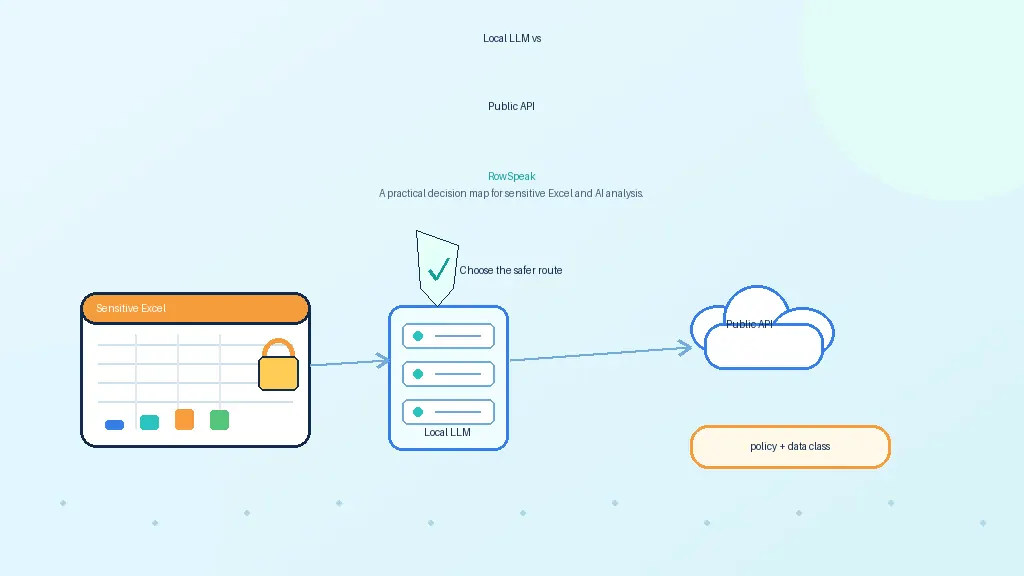

Viele Teams stellen sich derzeit eine einfache Frage: Können wir Llama zur Analyse von Tabellenkalkulationen nutzen, ohne vertrauliche Dateien an einen öffentlichen KI-Dienst zu senden?

Die kurze Antwort lautet: Ja, aber mit einem wichtigen Vorbehalt. Llama kann als Reasoning-Layer (Logikebene) innerhalb eines privaten Systems zur Tabellenanalyse fungieren. Es sollte jedoch nicht als das gesamte System betrachtet werden.

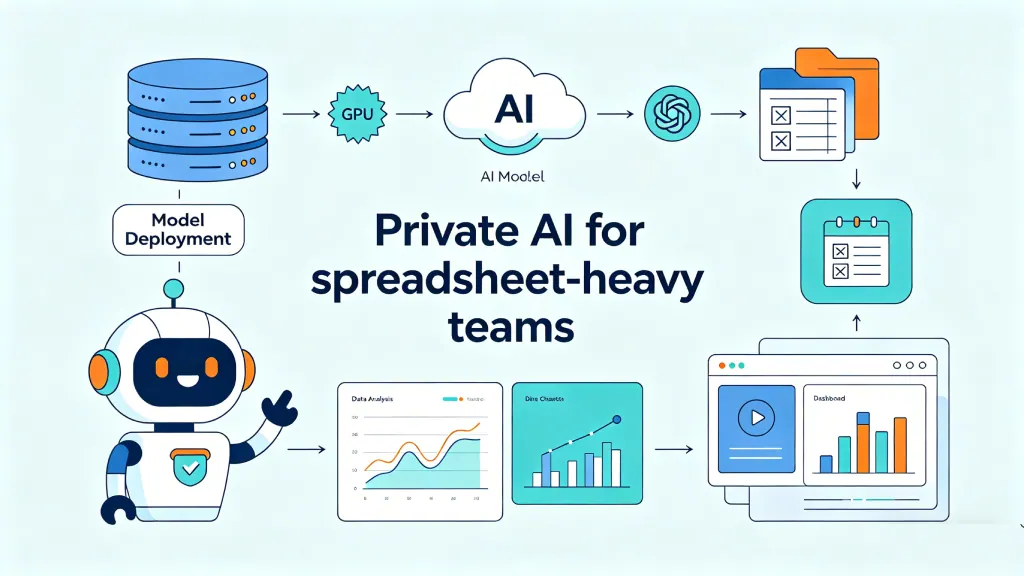

Ein Modell kann Trends erklären, Formeln generieren, SQL schreiben, Diagramme vorschlagen und komplexe geschäftliche Fragen in einen Plan umwandeln. Die Arbeit mit Tabellenkalkulationen im Unternehmen erfordert jedoch auch das Parsen von Arbeitsmappen, deterministische Berechnungen, Berechtigungsprüfungen, Audit-Logs und einen Workflow, den Finanz- oder Operation-Teams tatsächlich nutzen können.

Diese Unterscheidung ist entscheidend. Die meisten gescheiterten KI-Piloten im Spreadsheet-Bereich scheitern, weil das Team vom Modell verlangt, gleichzeitig Datenbank, Taschenrechner, Sicherheitsebene und Analyst zu sein.

Warum Unternehmen an Llama für die Tabellenanalyse interessiert sind

Llama ist attraktiv, weil es in Umgebungen ausgeführt werden kann, die ein Unternehmen selbst kontrolliert. Meta pflegt offizielle Llama-Repositories auf GitHub, und Llama-Modelle werden von fast allen selbst gehosteten Inference-Stacks unterstützt.

Für Unternehmen mit sensiblen Daten eröffnet dies einen sicheren Weg:

- Ausführung des Modells in einer privaten VPC oder On-Premise-Umgebung

- Bereitstellung über eine interne API

- Speicherung der Arbeitsmappen in genehmigten Speichersystemen

- Vermeidung von Ad-hoc-Copy-Paste in öffentliche Chatbots

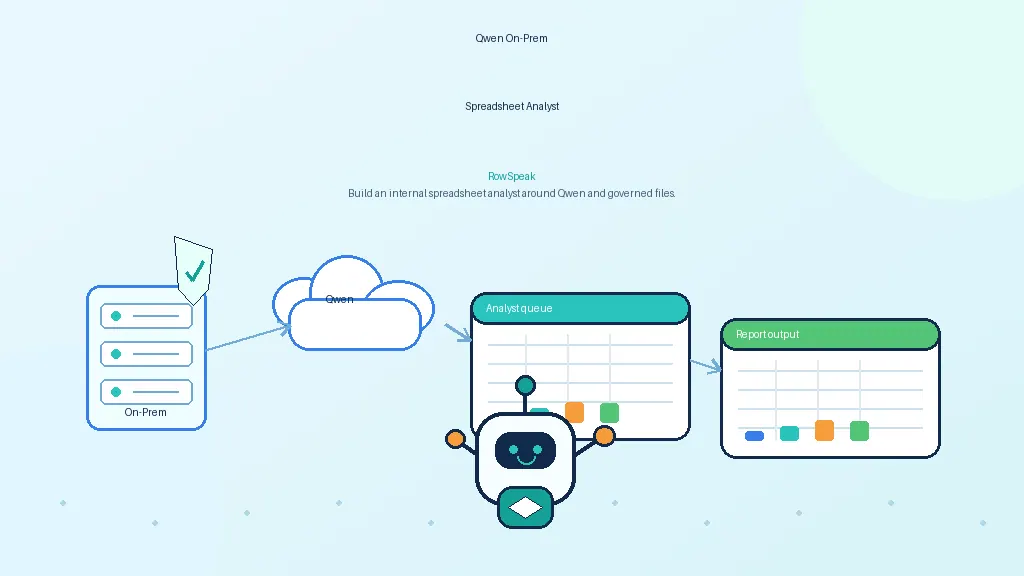

- Aufbau eines internen KI-Analysten, der die Unternehmensregeln befolgt

Die Anwendungsfälle sind meist praxisnah und nicht experimentell.

Ein Finanzteam möchte wissen, warum sich die Bruttomarge nach Regionen verändert hat. Ein Sales-Operations-Team möchte Änderungen in der Pipeline aus einem wöchentlichen Export zusammenfassen. Ein Reporting-Team benötigt einen Entwurf für die Kommentierung einer Arbeitsmappe vor einer Management-Sitzung. Dies sind genau die Workflows, bei denen KI Zeit sparen kann, aber auch die Art von Workflows, bei denen Datensicherheit oberste Priorität hat.

Was Llama gut beherrscht

Bei der Analyse von Tabellenkalkulationen ist Llama besonders nützlich, wenn die Aufgabe Sprache, logisches Denken oder die Planung von Workflows umfasst.

Es hilft bei:

- der Interpretation von Benutzerfragen in natürlicher Sprache

- der Identifizierung wahrscheinlicher Spalten und Kennzahlen

- der Generierung von Excel-Formeln oder SQL

- der Erklärung von Abweichungen oder Trends

- Vorschlägen für Diagramme in einem Bericht

- der Zusammenfassung von Berechnungsergebnissen

- dem Entwurf von Management-Kommentaren

- der Umwandlung vager Fragen in einen strukturierten Analyseplan

Ein Benutzer könnte beispielsweise fragen:

Welche Produktkategorie hat den Margenrückgang im letzten Quartal verursacht, und welches Diagramm sollte ich im Executive Report verwenden?

Ein gutes KI-System nutzt Llama, um die Anfrage zu interpretieren, zu entscheiden, welche Felder relevant sind, ein Berechnungstool aufzurufen und das Ergebnis in verständlicher Sprache zu erklären.

Der entscheidende Punkt ist hier: „ein Berechnungstool aufrufen“.

Was Llama nicht alleine tun sollte

Ein System für Tabellenkalkulationen sollte Llama nicht bitten, Summen zu berechnen, indem es Tausende von Zeilen innerhalb eines Prompts liest. Das ist langsam, teuer und unzuverlässig.

LLMs können Zahlen halluzinieren. Sie können ausgeblendete Zeilen übersehen. Sie können ähnlich benannte Spalten verwechseln. Und sie können plausible Erklärungen auf Basis unvollständiger Kontexte liefern.

Das macht Llama nicht ungeeignet. Es bedeutet lediglich, dass die Architektur ehrlich damit umgehen muss, was das Modell gut kann und was nicht.

Nutzen Sie Llama für das Verständnis der Benutzerabsicht (Intent), für logische Schlussfolgerungen, Code- oder Query-Generierung und Erklärungen. Nutzen Sie deterministische Systeme für Arithmetik und Datenoperationen.

Diese deterministischen Systeme können sein:

- SQL

- DuckDB

- pandas oder Polars

- eine Excel-kompatible Formula-Engine

- ein BI-Semantic-Layer

- eine kontrollierte Warehouse-Abfrage

Das Modell plant und erklärt. Der Compute-Layer rechnet.

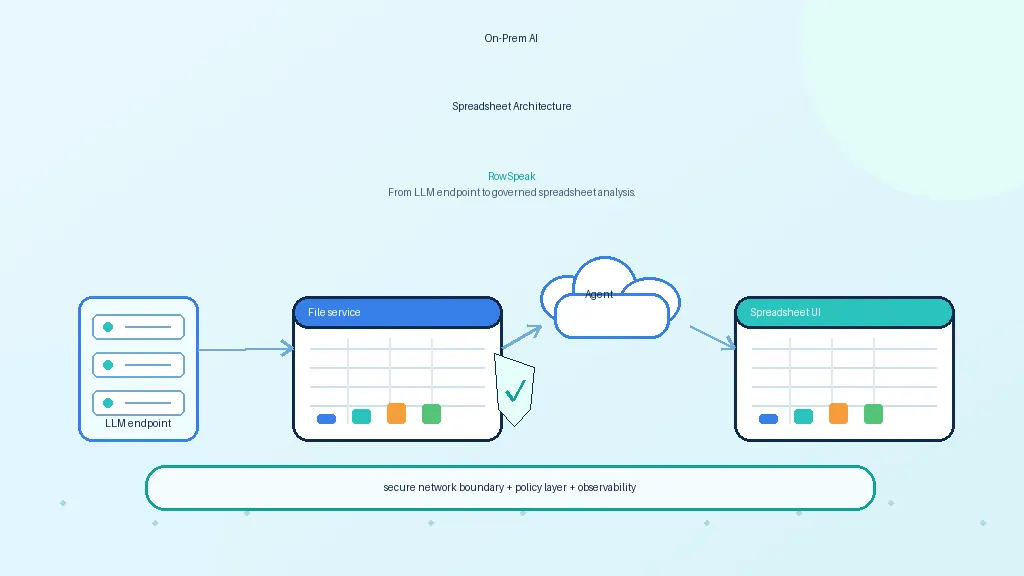

Eine praktische private Architektur

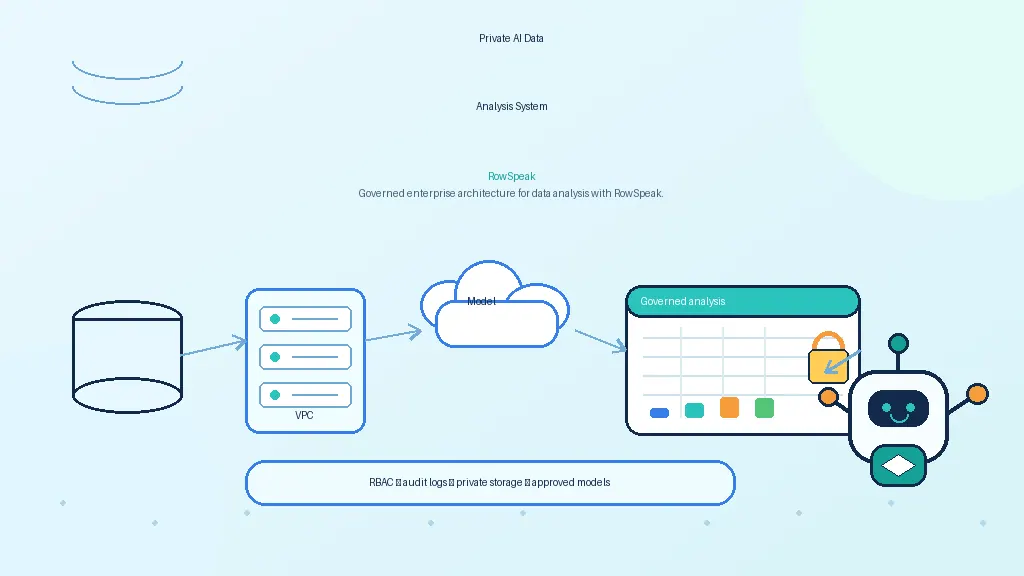

Ein privates Llama-System für Tabellenkalkulationen benötigt normalerweise diese Ebenen:

Private Datenaufnahme (Ingestion)

Arbeitsmappen, CSVs und Exporte werden innerhalb der Unternehmensumgebung hochgeladen.Verständnis der Arbeitsmappe

Das System extrahiert Blätter, Spalten, Formeln, benannte Bereiche, Datentypen und Tabellenstrukturen.Berechnungsebene (Computation Layer)

Berechnungen erfolgen über SQL, Python, Spreadsheet-Formeln oder eine andere deterministische Engine.Modell-Endpunkt

Llama läuft auf einem privaten Inference-Server.Workflow-Ebene

Benutzer stellen Fragen, prüfen Ergebnisse, erstellen Diagramme und generieren Berichte, ohne die Modell-API direkt aufzurufen.Governance-Ebene

Das System erzwingt Berechtigungen, protokolliert den Datenzugriff, kontrolliert die Aufbewahrungsfristen und dokumentiert, welche Antwort aus welchen Daten generiert wurde.

Deshalb reicht das Modell allein nicht aus. Llama mag leistungsstark sein, aber Geschäftsanwender wollen keinen rohen /v1/chat/completions-Endpunkt. Sie wollen eine Analysten-Erfahrung.

vLLM, Ollama oder llama.cpp?

Die Wahl der Runtime hängt von der Projektphase ab.

Ollama ist ideal für lokale Tests und schnelle Prototypen. Es ist einfach zu bedienen und eignet sich gut zur Validierung von Prompts und Workflow-Ideen.

vLLM ist die bessere Wahl, wenn das Team GPU-Serving in der Produktion, Batching und eine OpenAI-kompatible API benötigt. Das vLLM-Projekt bietet einen OpenAI-kompatiblen Server, was die Anbindung der Modell-Infrastruktur an die Anwendungsebene erleichtert.

llama.cpp ist nützlich für quantisierte lokale Inference, Experimente auf CPUs oder Apple Silicon sowie für Umgebungen mit begrenzten Ressourcen.

Für die Tabellenanalyse im Unternehmen ist der Weg oft klar: Prototyping mit Ollama, Validierung des Workflows und anschließender Wechsel zu vLLM oder einem anderen produktiven Serving-Stack für den internen Einsatz.

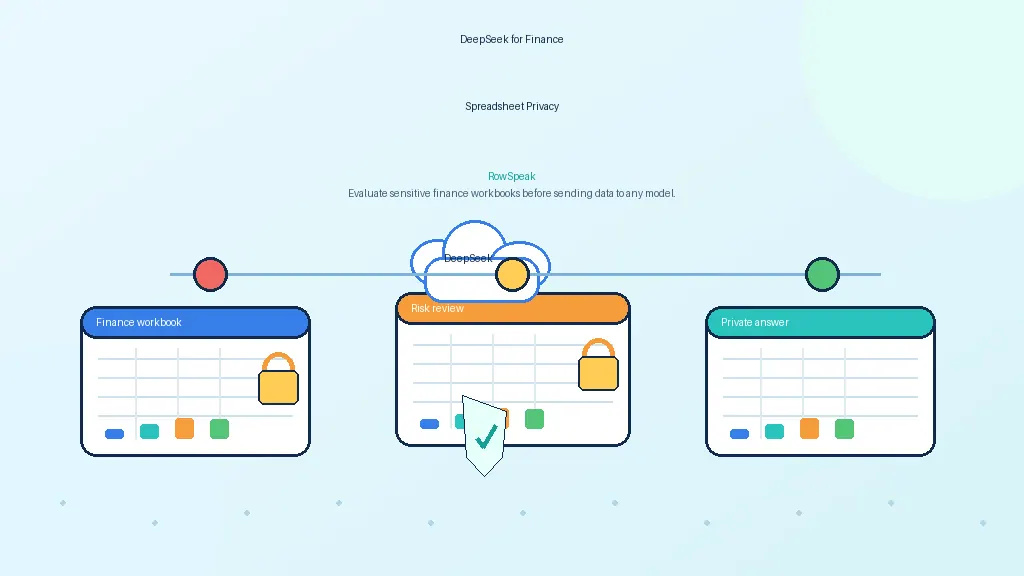

Das Genauigkeitsproblem ist lösbar – durch Design

Genauigkeit bei Spreadsheet-KI entsteht nicht dadurch, dass man das Modell bittet, vorsichtiger zu sein. Sie entsteht durch die Verankerung (Grounding) des Modells in Tools und Belegen.

Ein privater Spreadsheet-Analyst sollte:

- das Schema prüfen, bevor er antwortet

- Klärungsfragen stellen, wenn Spaltennamen mehrdeutig sind

- Berechnungen außerhalb des Modells ausführen

- Referenzen auf Zeilen, Blätter oder Abfragen zurückgeben

- Zwischentabellen anzeigen, wenn dies sinnvoll ist

- Fakten von Interpretationen trennen

- ein Log der generierten Formeln, SQL-Befehle oder Codes führen

Dadurch wird die Antwort überprüfbar. Ein Finanzanalyst kann sehen, woher eine Zahl stammt. Ein IT-Team kann sehen, auf welche Daten zugegriffen wurde. Ein Manager kann dem Prozess mehr vertrauen als einer „Black-Box“-Zusammenfassung.

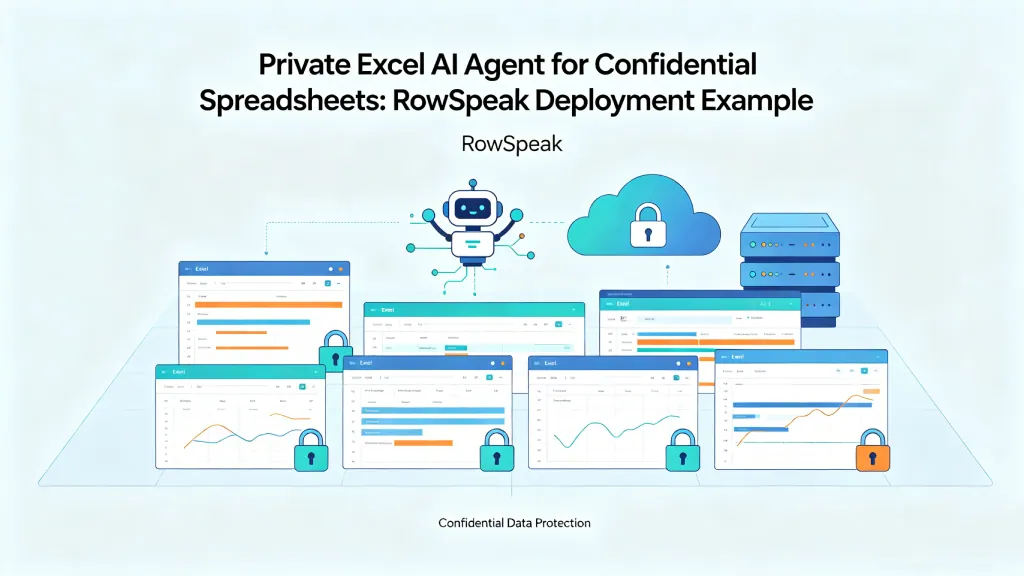

Wo RowSpeak ins Spiel kommt

RowSpeak soll Llama nicht ersetzen. Es setzt als Spreadsheet-Assistant-Workflow-Ebene auf Modellen wie Llama auf.

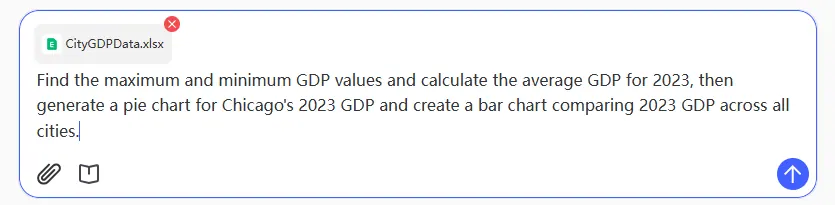

In einem privaten Deployment liefert das Modell die Logik. RowSpeak liefert die Erfahrung rund um diese Logik: Tabellen hochladen, Fragen in natürlicher Sprache stellen, KI-gestützte Datenanalysen durchführen, Diagramme erstellen und berichtsfähige Erklärungen generieren.

In dieser Ebene liegt der eigentliche Geschäftswert. Sie übernimmt die komplexen Aufgaben, die ein reiner Modell-Endpunkt nicht löst: Struktur der Arbeitsmappe, Benutzer-Workflow, fundierte Berechnungen und geschäftsorientierte Ausgaben.

Für Unternehmen, die Llama evaluieren, lautet die strategische Frage nicht nur: „Können wir das Modell betreiben?“, sondern: „Können wir das Modell in einen kontrollierten Spreadsheet-Analysten verwandeln, den unsere Teams tatsächlich nutzen werden?“

Checkliste vor dem Llama-Piloten für private Tabellenanalyse

Bevor Sie starten, sollten Sie diese Fragen klären:

- Welche Arten von Tabellen werden die Benutzer analysieren?

- Gibt es versteckte Blätter, Formeln, Pivot-Tabellen oder mehrere verknüpfte Dateien?

- Welche Daten sind vertraulich oder reguliert?

- Wo werden die Dateien gespeichert?

- Welche Runtime wird das Modell bereitstellen?

- Welche Engine wird die Berechnungen durchführen?

- Wie werden Ausgaben Quellzeilen, Zellen oder Abfragen zitieren?

- Wie wird der Zugriff protokolliert?

- Wer darf hochgeladene Dateien und generierte Berichte sehen?

- Was ist der Fallback, wenn das Modell unsicher ist?

Wenn diese Fragen geklärt sind, kann Llama zu einer starken Basis für private Tabellenanalysen und wiederkehrende Aufgaben wie das automatisierte Spreadsheet-Reporting werden. Werden sie ignoriert, bleibt das Projekt lediglich eine weitere Chatbot-Demo.

Quellen und weiterführende Informationen

- Meta Llama GitHub: https://github.com/meta-llama

- vLLM OpenAI-kompatibler Server: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama Modell-Bibliothek: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp