Qwen entwickelt sich zu einer echten Alternative für Teams, die auf private KI-gestützte Datenanalyse setzen.

Der Grund dafür ist nicht nur, dass Qwen-Modelle außerhalb eines gehosteten Chatbots bereitgestellt werden können. Die Analyse von Tabellenkalkulationen hängt oft von Programmierung, Formeln, SQL und strukturiertem logischem Denken ab – Bereiche, in denen das Qwen-Ökosystem besonders stark ist.

Hier gilt jedoch dieselbe Regel wie für jedes Modell: Qwen ist für sich genommen kein Tabellenkalkulationsprodukt, sondern ein Reasoning-Layer. Um es für Finanz-, Operations-, Vertriebs- oder Reporting-Teams nutzbar zu machen, ist ein entsprechender Workflow erforderlich.

Dieser Artikel erläutert, wie ein solcher Workflow aussehen sollte.

Warum Qwen für die Arbeit mit Tabellenkalkulationen interessant ist

Viele Fragen zu Tabellenkalkulationen sind im Kern Data-Engineering-Fragen.

Ein Benutzer fragt beispielsweise:

Welche Kunden hatten in den letzten zwei Quartalen ein Umsatzwachstum, aber eine sinkende Marge?

Das klingt nach natürlicher Sprache. Im Hintergrund muss das System jedoch Datumsspalten identifizieren, nach Kunden gruppieren, Umsatz und Marge berechnen, Zeiträume vergleichen, Ergebnisse filtern und ein Diagramm erstellen.

Genau hier wird Qwen interessant. Das offizielle Qwen-Ökosystem umfasst allgemeine Modelle, codierungsorientierte Modelle sowie Agenten- und Tool-Use-Funktionen. Qwen ist zudem über offizielle Projektseiten, GitHub, Hugging Face und ModelScope-Deployment-Pfade verfügbar.

Für die Analyse von Tabellenkalkulationen sind folgende Fähigkeiten entscheidend:

- Generierung von pandas-Code oder SQL

- Erklären von Formeln

- Planung mehrstufiger Transformationen

- Arbeit in englischen und chinesischen Geschäftskontexten

- Interpretation von Spaltennamen und unstrukturierten Schemata

- Nutzung von Tools anstatt reiner Textausgabe

Dies macht Qwen zu einem guten Kandidaten für einen privaten KI-Analysten. Dennoch wird der Rest des Systems benötigt.

Das richtige mentale Modell: Qwen plus Tools

Erwarten Sie von Qwen nicht, dass es eine Gesamtsumme direkt aus roh eingefügten Zeilen berechnet. Lassen Sie Qwen stattdessen die Berechnung planen und diesen Plan dann über ein vertrauenswürdiges Tool ausführen.

Ein optimierter Workflow sieht so aus:

- Der Benutzer lädt eine Arbeitsmappe in die private Umgebung hoch.

- Das System extrahiert Blätter, Spalten, Formeln und Datentypen.

- Qwen erhält eine kompakte Beschreibung der Arbeitsmappe.

- Qwen entscheidet, welche Operation erforderlich ist.

- Ein Compute-Tool führt SQL, Python, DuckDB, pandas oder Tabellenformeln aus.

- Qwen erläutert das Ergebnis und nennt die Quellen.

Dies ist der entscheidende Unterschied zwischen einer Demo und einem zuverlässigen Analyse-Workflow.

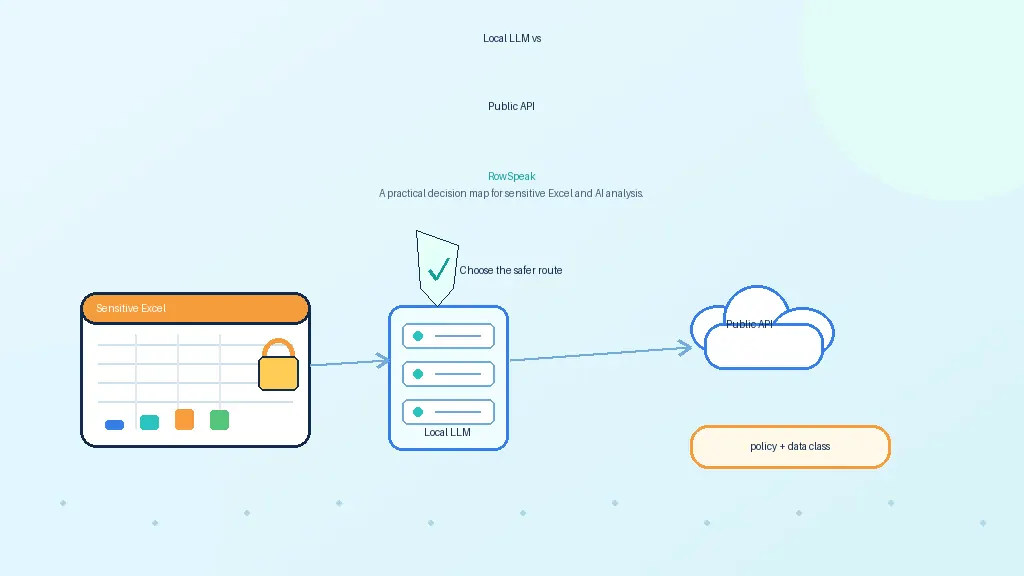

Deployment-Optionen für Qwen

Qwen kann auf verschiedene Weise genutzt werden, je nach Phase und Anforderungen.

Für erste Tests nutzen Teams oft lokale Serving-Tools, da diese das Ausprobieren von Prompts und Workflows erleichtern. Für den Produktivbetrieb ist in der Regel ein kontrollierter Serving-Layer mit Monitoring, Concurrency und internem API-Zugriff erforderlich.

Gängige Optionen sind:

- vLLM für das GPU-Serving in der Produktion und OpenAI-kompatible APIs

- Ollama für lokale Tests und leichtgewichtige interne Prototypen

- Transformers für maßgeschneiderte Pipelines und Forschungs-Workflows

- llama.cpp oder GGUF-Builds, wenn quantisierte lokale Inferenz verfügbar und angemessen ist

Entscheidend ist nicht die Marke der Runtime, sondern dass der Modell-Endpunkt wie interne Infrastruktur behandelt wird: authentifiziert, überwacht, versioniert und isoliert von Daten, auf die er keinen Zugriff haben sollte.

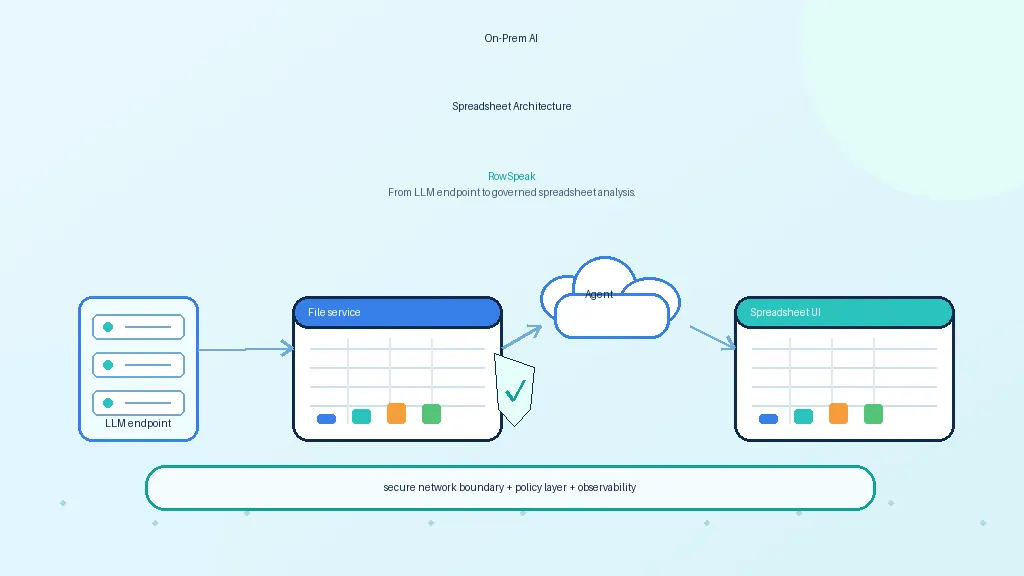

Native Architektur für Tabellenkalkulationen

Ein On-Premise Qwen-Analyst für Tabellenkalkulationen sollte die folgenden Komponenten enthalten.

Ingestion von Arbeitsmappen

Das System muss echte Arbeitsmappen verstehen, nicht nur saubere CSV-Dateien.

Das bedeutet den Umgang mit:

- Mehreren Tabellenblättern

- Formeln

- Verbundenen Zellen

- Ausgeblendeten Blättern

- Benannten Bereichen

- Kommentaren

- Pivot-ähnlichen Strukturen

- Inkonsistenten Datums- und Zahlenformaten

- Exportierten Tabellen aus ERP-, CRM-, BI- oder Buchhaltungstools

Ist diese Ebene schwach, wird das Modell auf Basis einer verzerrten Version der Tabelle arbeiten.

Deterministische Ausführung

Qwen sollte nicht der Taschenrechner sein. Nutzen Sie eine zuverlässige Engine für Berechnungen.

Je nach Datenlage kann das sein:

- SQL

- DuckDB

- pandas

- Polars

- Eine Excel-kompatible Calculation-Engine

- Warehouse-Pushdown in Snowflake, BigQuery, Postgres oder ein anderes kontrolliertes System

Das Modell generiert oder wählt die Operation aus; die Engine führt sie aus.

Zitate und Rückverfolgbarkeit

Ein Geschäftsanwender muss fragen können: „Woher kommt diese Antwort?“

Eine gute Antwort sollte verweisen auf:

- Name der Arbeitsmappe

- Name des Tabellenblatts

- Verwendete Spalten

- Angewendete Filter

- Zeilenbereiche oder Zeilen-IDs

- Generierte Abfrage oder Formel

- Ausgabetabelle oder Diagramm

Dies ist besonders im Finanzwesen und im operativen Bereich wichtig, wo eine zwar überzeugend klingende, aber falsche Antwort echte Geschäftsrisiken birgt.

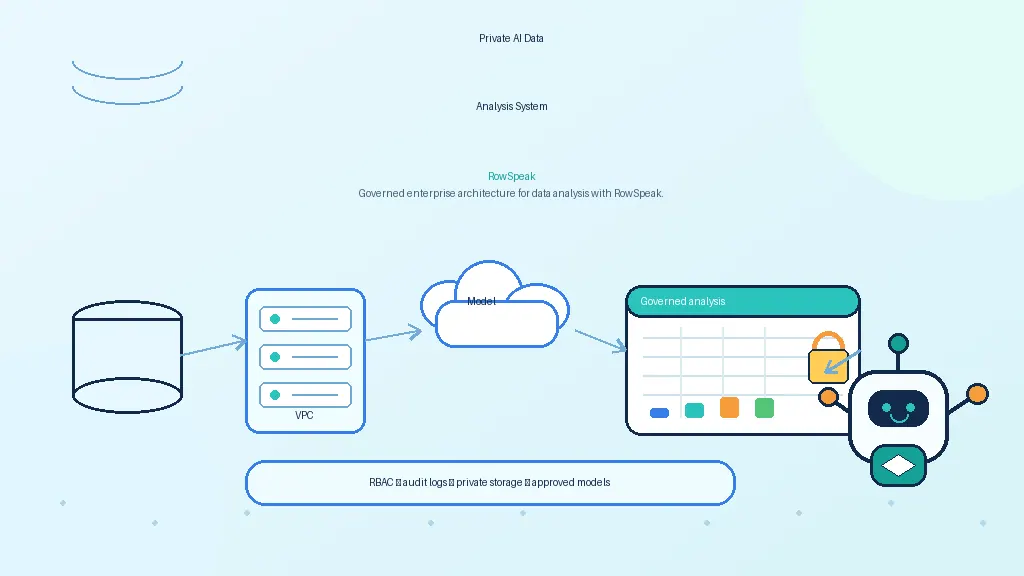

Checkliste für Sicherheit und Governance

Ein privates Qwen-Deployment ist nur dann privat, wenn der gesamte Workflow privat ist.

Prüfen Sie diese Punkte:

- Ruft das Modell externe APIs auf?

- Werden hochgeladene Dateien in einer genehmigten Infrastruktur gespeichert?

- Werden Prompts und Ausgaben protokolliert?

- Können Administratoren die Aufbewahrungsfristen steuern?

- Erzwingt das System Datei- und Datensatzberechtigungen vor dem Abruf?

- Ist der ausgehende Netzwerkzugriff eingeschränkt?

- Können Benutzer nur auf die Dateien zugreifen, für die sie eine Berechtigung haben?

- Wird generierter Code in einer Sandbox ausgeführt?

- Werden sensible Spalten bei Bedarf maskiert?

Ein On-Premise-Deployment ist kein Allheilmittel. Es eliminiert zwar das Risiko durch Drittanbieter, erhöht aber die operative Verantwortung.

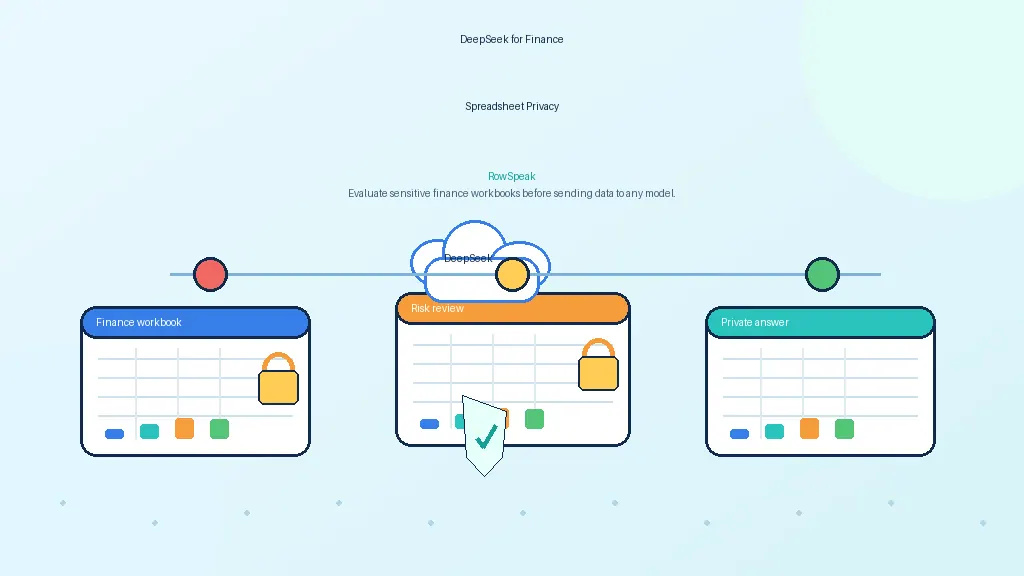

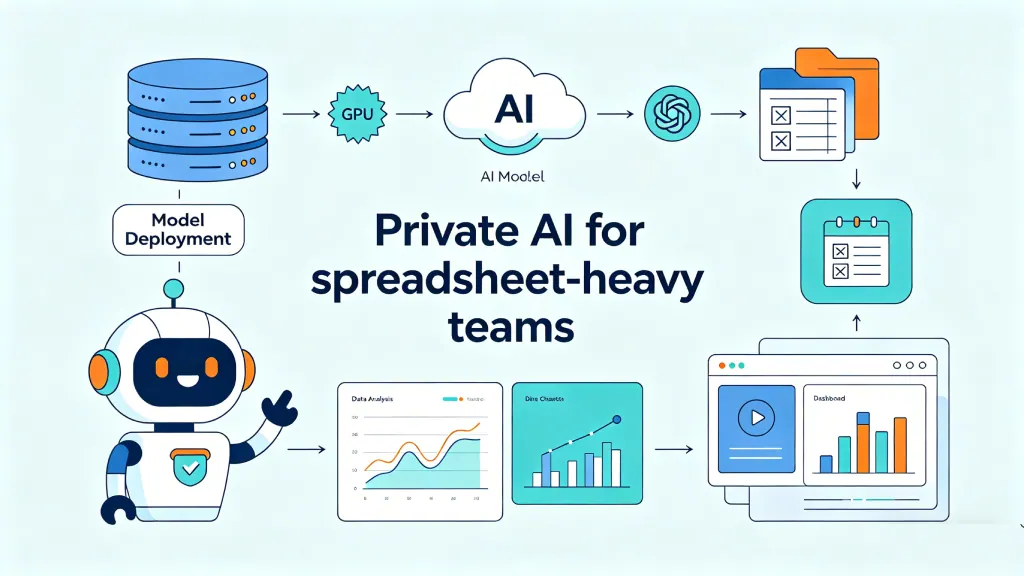

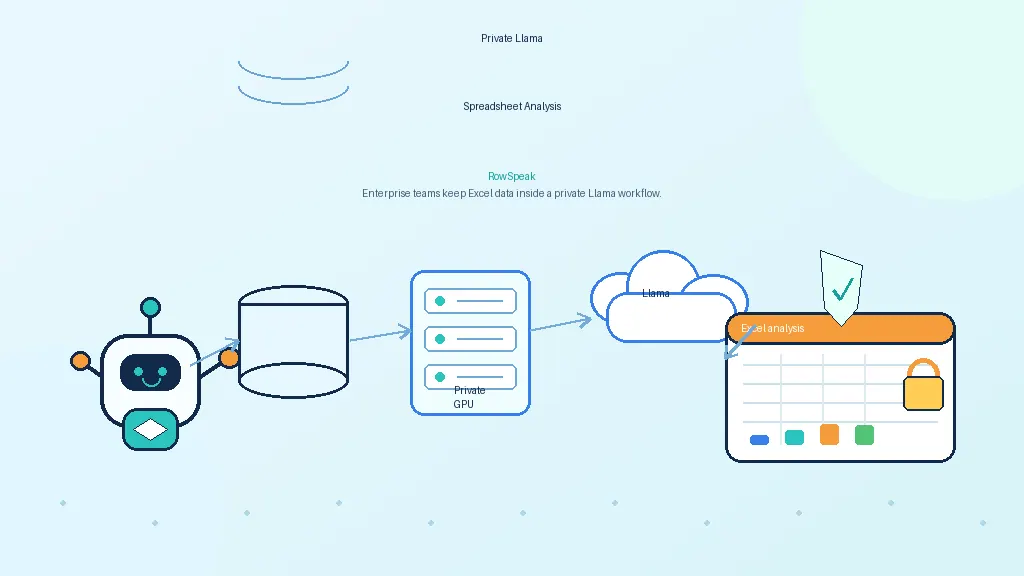

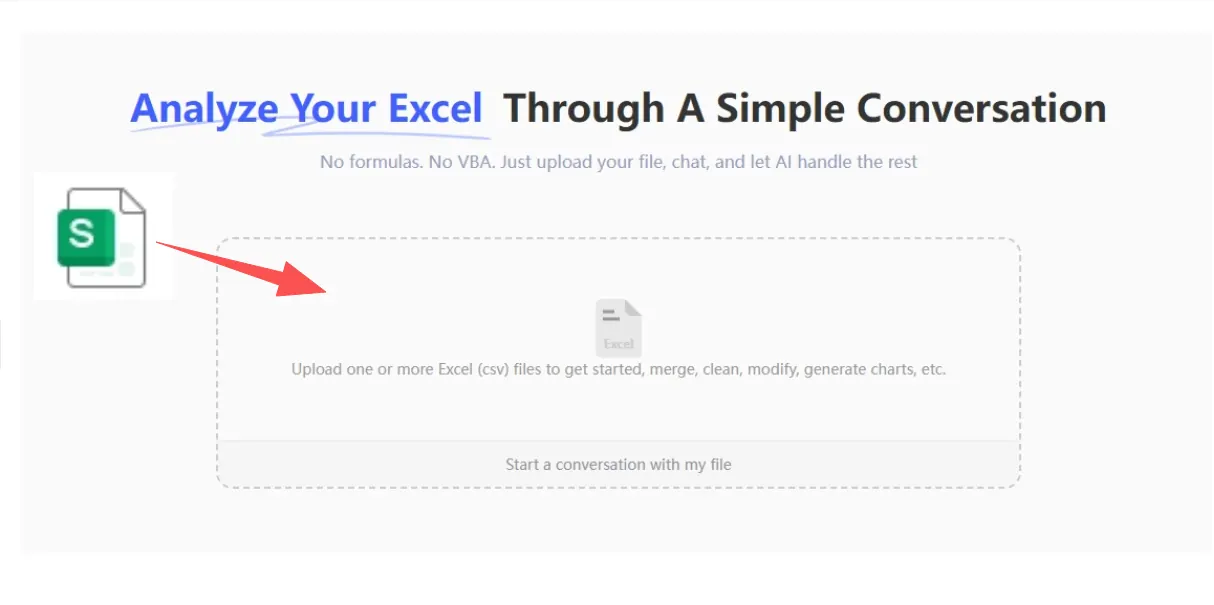

Die Rolle von RowSpeak

RowSpeak fungiert als Workflow-Ebene für Tabellenkalkulationen oberhalb von Qwen.

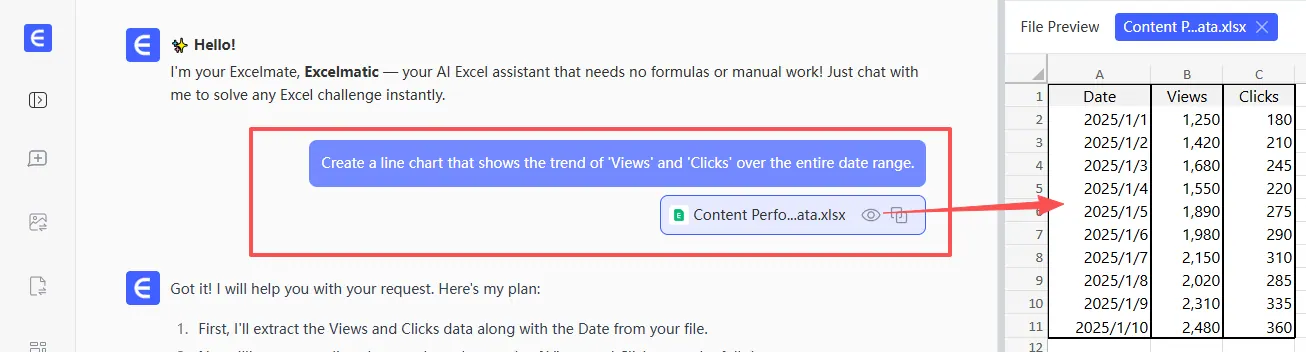

Das bedeutet, dass Qwen das logische Denken (Reasoning) übernimmt, während RowSpeak den benutzerorientierten Analyse-Workflow verwaltet: Hochladen von Tabellen, Beantworten von Fragen, Erstellen von Diagrammen mit KI-Diagramm-Tools, Erstellen von Zusammenfassungen und die Verknüpfung der Ausgaben mit der zugrunde liegenden Arbeitsmappe.

Für Unternehmen ist dieser modellagnostische Ansatz wertvoll. Ein Unternehmen kann mit Qwen beginnen, es mit Llama oder DeepSeek vergleichen und später das Modell wechseln. Der Workflow für die Tabellenkalkulation muss dabei nicht jedes Mal neu aufgebaut werden; dieselbe Logik gilt auch, wenn Teams ChatGPT-ähnliche Tabellenkalkulations-Tools evaluieren.

Wann Qwen die richtige Wahl ist

Qwen ist besonders dann eine Evaluierung wert, wenn der Workflow Folgendes umfasst:

- Generierung von pandas oder SQL

- Erklärung von Formeln

- Schritte zur Datenbereinigung

- Multilinguale Teams

- Interne Coding- oder Datenanalyse-Agenten

- Anforderungen an ein privates Deployment

- Automatisierung von der Tabelle zum Bericht

Qwen ist weniger geeignet, wenn das Team erwartet, dass das Modell komplexe Arbeitsmappen direkt ohne Parsing liest, oder wenn garantierte Arithmetik ohne eine externe Compute-Engine benötigt wird.

Fazit

Qwen kann ein starkes Fundament für die private Analyse von Tabellenkalkulationen sein. Der eigentliche Wert entsteht jedoch erst durch die Kombination mit der richtigen Architektur.

Das Erfolgssystem ist nicht „Qwen statt Excel“, sondern Qwen plus privates Deployment, Verständnis für Tabellenstrukturen, deterministische Berechnungen, Zitate, Governance und ein Workflow, dem Geschäftsanwender vertrauen können – insbesondere bei wiederkehrenden Aufgaben wie dem monatlichen Management-Reporting.

Quellen und weiterführende Informationen

- Offizielle Qwen-Seite: https://qwenlm.github.io/

- Qwen3 GitHub: https://github.com/QwenLM/Qwen3

- Qwen Hugging Face Organisation: https://huggingface.co/Qwen

- vLLM OpenAI-kompatibler Server: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama Library: https://ollama.com/library