現在、多くのチームがシンプルな疑問を抱いています。「機密ファイルを公開AIサービスに送信せずに、Llamaを使ってスプレッドシートを分析できるだろうか?」

結論から言えば「可能」ですが、重要な注意点があります。Llamaはプライベートなスプレッドシート分析システムにおける「推論レイヤー」として機能させるべきであり、システム全体をLlamaだけに頼るべきではありません。

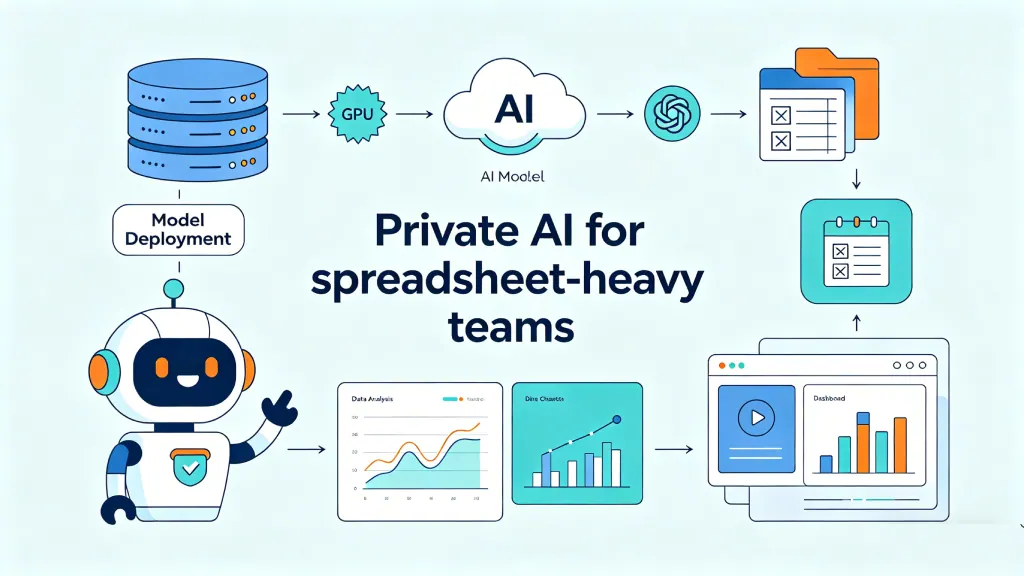

モデルはトレンドの解説、数式の生成、SQLの記述、チャートの提案、そして曖昧なビジネス上の問いを計画に落とし込むことができます。しかし、エンタープライズレベルのスプレッドシート業務には、ワークブックのパース(解析)、決定論的な計算、権限チェック、監査ログ、そして財務や運用チームが実際に活用できるユーザーワークフローが必要です。

この区別は非常に重要です。AIスプレッドシート導入の試みが失敗する原因の多くは、モデルに対してデータベース、計算機、セキュリティレイヤー、そしてアナリストの役割をすべて同時に求めてしまうことにあります。

なぜ企業はスプレッドシート分析にLlamaを求めるのか

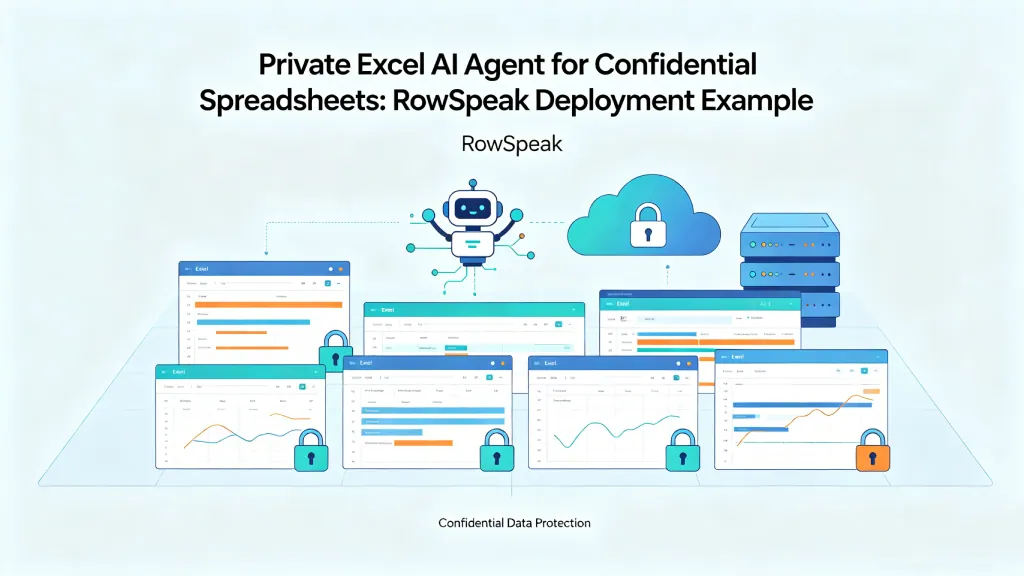

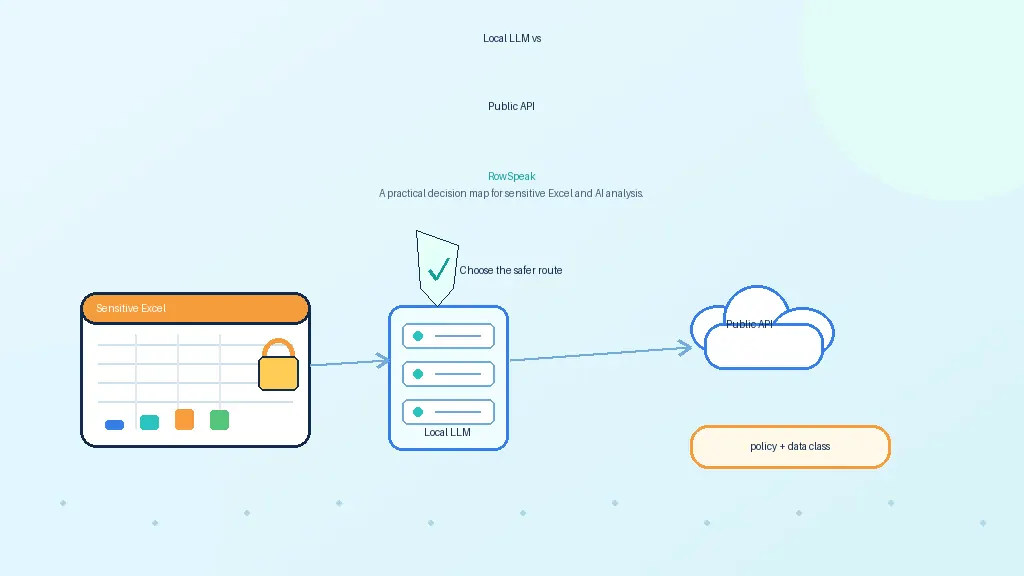

Llamaが魅力的なのは、企業が管理する環境内で実行できるからです。MetaはGitHubで公式のLlamaリポジトリを維持しており、Llamaモデルはセルフホスト型の推論スタックで広くサポートされています。

機密性の高いスプレッドシートデータを扱う企業にとって、これは有用な道を開きます:

- モデルをプライベートなVPCやオンプレミス環境で実行する

- 内部APIを通じてモデルを公開する

- ワークブックを承認済みのストレージ内に保持する

- 公開チャットボットへの無計画なコピー&ペーストを避ける

- 社内ルールに従う「社内AIアナリスト」を構築する

ユースケースは通常、実験的なものではなく実用的なものです。

財務チームは、地域ごとに売上総利益率が変化した理由を知りたいと考えています。セールスオペレーションチームは、週次のエクスポートデータからパイプラインの変化を要約したいと考えています。レポート作成チームは、経営会議の前にワークブックから解説文のドラフトを作成したいと考えています。これらはまさにAIが時間を短縮できるワークフローですが、同時にデータの露出が問題となるワークフローでもあります。

Llamaが得意とすること

スプレッドシート分析において、Llamaは言語、推論、またはワークフローの計画が関わるタスクで威力を発揮します。

具体的には以下の支援が可能です:

- ユーザーの自然言語による質問の解釈

- 関連する可能性の高い列や指標の特定

- Excelの数式やSQLの生成

- 差異やトレンドの解説

- レポート用チャートの提案

- 計算結果の要約

- 経営向け解説文のドラフト作成

- 曖昧な質問を構造化された分析計画に変換

例えば、ユーザーが次のように質問したとします:

「前四半期の利益率低下の要因となった製品カテゴリーはどれですか?また、エグゼクティブレポートにはどのチャートを使用すべきですか?」

優れたAIシステムは、Llamaを使用してこのリクエストを解釈し、どのフィールドが重要かを判断し、計算ツールを呼び出し、その結果を平易な言葉で説明することができます。

ここで重要なフレーズは「計算ツールを呼び出す」という点です。

Llamaだけに任せてはいけないこと

スプレッドシートモデルを構築する際、プロンプト内の数千行を読み取らせて合計を計算させるようなことをLlamaに求めてはいけません。それは低速でコストがかかり、信頼性に欠けます。

LLMは数値をハルシネーション(捏造)することがあります。非表示の行を見落としたり、似た名前の列を混同したりすることもあります。また、不完全なコンテキストから、もっともらしい説明を作り出してしまうこともあります。

これはLlamaが不適切であることを意味しません。モデルが得意なことに対して、アーキテクチャが誠実である必要があるということです。

意図の理解、推論、コードやクエリの生成、および解説にはLlamaを使用してください。算術演算やデータ操作には、決定論的なシステムを使用してください。

これらの決定論的システムには以下が含まれます:

- SQL

- DuckDB

- pandas または Polars

- Excel互換の数式エンジン

- BIセマンティックレイヤー

- 統制されたウェアハウス・クエリ

モデルが計画と解説を行い、計算レイヤーが計算を実行します。

実用的なプライベート・アーキテクチャ

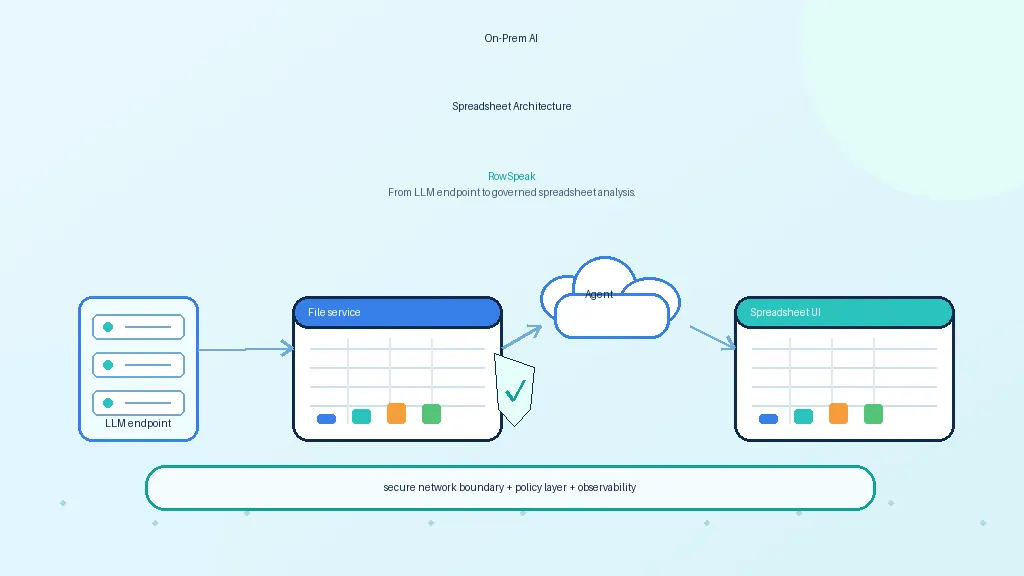

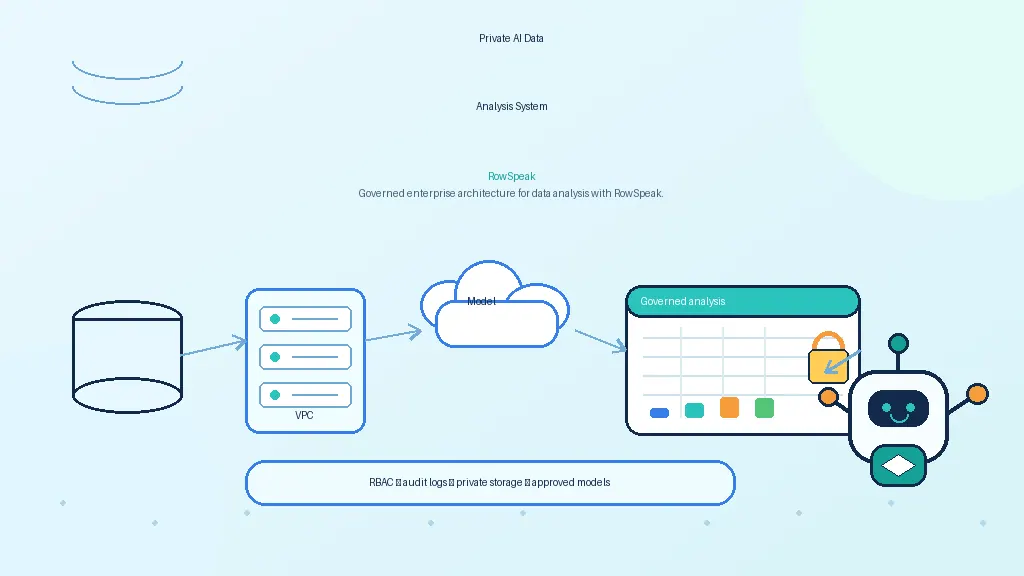

プライベートなLlamaスプレッドシートシステムには、通常以下のレイヤーが必要です:

プライベートなファイルの取り込み

ワークブック、CSV、エクスポートデータが企業の環境内にアップロードされます。ワークブックの理解

システムがシート、列、数式、名前付き範囲、データ型、およびテーブル構造を抽出します。計算レイヤー

SQL、Python、スプレッドシートの数式、またはその他の決定論的エンジンを通じて計算が実行されます。モデルエンドポイント

Llamaがプライベートな推論サーバーを通じて実行されます。ワークフローレイヤー

ユーザーはモデルAPIを直接呼び出すことなく、質問をし、出力を確認し、チャートを作成し、レポートを生成します。ガバナンスレイヤー

システムが権限を強制し、データアクセスをログに記録し、保持期間を制御し、どのデータからどの回答が生成されたかを記録します。

これが、モデルだけでは不十分な理由です。Llamaは強力かもしれませんが、ビジネスユーザーが求めているのは生の /v1/chat/completions エンドポイントではありません。彼らが求めているのは「アナリストとしての体験」です。

vLLM、Ollama、それとも llama.cpp?

適切なランタイムは、プロジェクトの段階によって異なります。

Ollama は、ローカルでのテストや迅速なプロトタイプ作成に役立ちます。実行が容易で、プロンプトやワークフローのアイデアを検証するのに適しています。

vLLM は、本番環境でのGPUサービング、バッチ処理、およびOpenAI互換APIが必要な場合に適しています。vLLMプロジェクトはOpenAI互換サーバーをドキュメント化しており、モデル提供インフラをアプリケーション層に接続しやすくしています。

llama.cpp は、量子化されたローカル推論、CPUやApple Siliconでの実験、およびリソース制約のある環境で有用です。

エンタープライズ向けのスプレッドシート分析における一般的なパスはシンプルです。まずOllamaでプロトタイプを作成してワークフローを検証し、その後、本格的な社内展開のためにvLLMなどの本番用サービングスタックに移行します。

精度向上のための設計

スプレッドシートAIにおける精度は、モデルに「もっと注意深く」と頼むことで得られるものではありません。モデルをツールや証拠に「グラウンディング(根拠付け)」させることで得られます。

プライベートなスプレッドシートアナリストは以下の動作をすべきです:

- 回答前にスキーマを確認する

- 列が曖昧な場合は確認の質問をする

- モデルの外で計算を実行する

- 参照した行、シート、またはクエリを返す

- 有用な場合は中間テーブルを表示する

- 事実と解釈を分離する

- 生成された数式、SQL、またはコードのログを保持する

これにより、回答の検証が可能になります。財務アナリストは数値がどこから来たのかを確認でき、ITチームはどのデータにアクセスしたかを把握でき、マネージャーはブラックボックス化された要約よりもプロセスを信頼できるようになります。

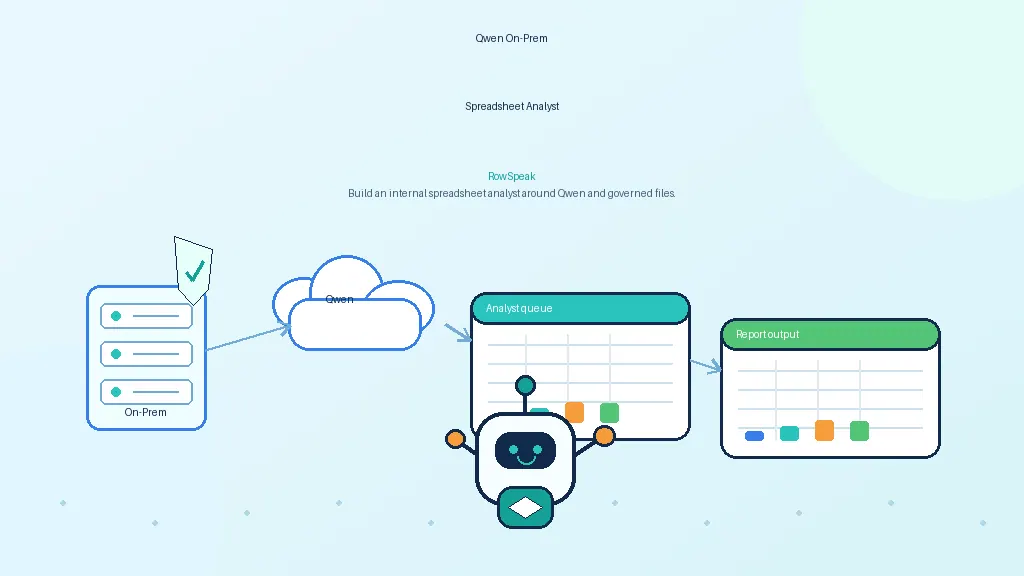

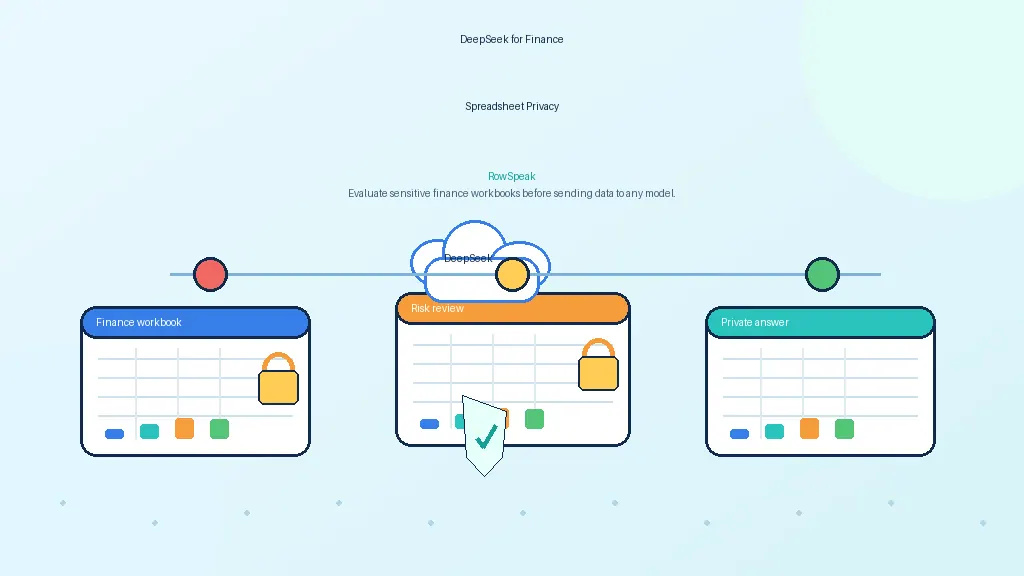

RowSpeakの役割

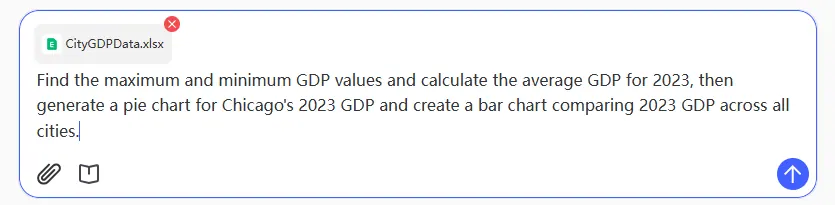

RowSpeakはLlamaを置き換えるものではありません。Llamaのようなモデルの上位に位置するスプレッドシート・アシスタント・ワークフロー層として機能します。

プライベートな展開において、モデルは推論を提供します。RowSpeakはその推論を包み込む体験を提供します。スプレッドシートをアップロードし、自然言語で質問し、AIスプレッドシートデータ分析を実行し、チャートを作成し、レポートにそのまま使える解説文を生成します。

このレイヤーこそが、エンタープライズにおける価値の多くが宿る場所です。生のモデルエンドポイントでは解決できない、ワークブックの構造化、ユーザーワークフロー、計算の根拠付け、ビジネス向けの出力といった煩雑な部分を処理します。

Llamaを検討している企業にとって、戦略的な問いは「モデルを実行できるか?」だけではありません。「モデルを、チームが実際に活用できる、統制されたスプレッドシートアナリストに変えられるか?」という点にあります。

Llamaによるプライベート分析導入前のチェックリスト

開始する前に、以下の質問に答えてみてください:

- ユーザーはどのような種類のスプレッドシートを分析するか?

- 非表示のシート、数式、ピボット、または複数の関連ファイルがあるか?

- どのデータが機密または規制対象か?

- ファイルはどこに保存されるか?

- どのランタイムでモデルを提供するか?

- どのエンジンで計算を実行するか?

- 出力結果において、ソースとなった行、セル、クエリをどのように引用するか?

- アクセスログをどのように記録するか?

- アップロードされたファイルや生成されたレポートを誰が閲覧できるか?

- モデルの確信度が低い場合のフォールバック(代替策)は何か?

これらの問いが明確であれば、Llamaはプライベートなスプレッドシート分析や、定期的なスプレッドシートレポートのような反復業務のための強力な基盤となります。これらを無視すれば、プロジェクトは単なるチャットボットのデモに終わってしまうでしょう。

出典および参考文献

- Meta Llama GitHub: https://github.com/meta-llama

- vLLM OpenAI-compatible server: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama model library: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp