DeepSeek-V4-Flashが正式にリリースされ、オープンウェイトとして一般公開されました。

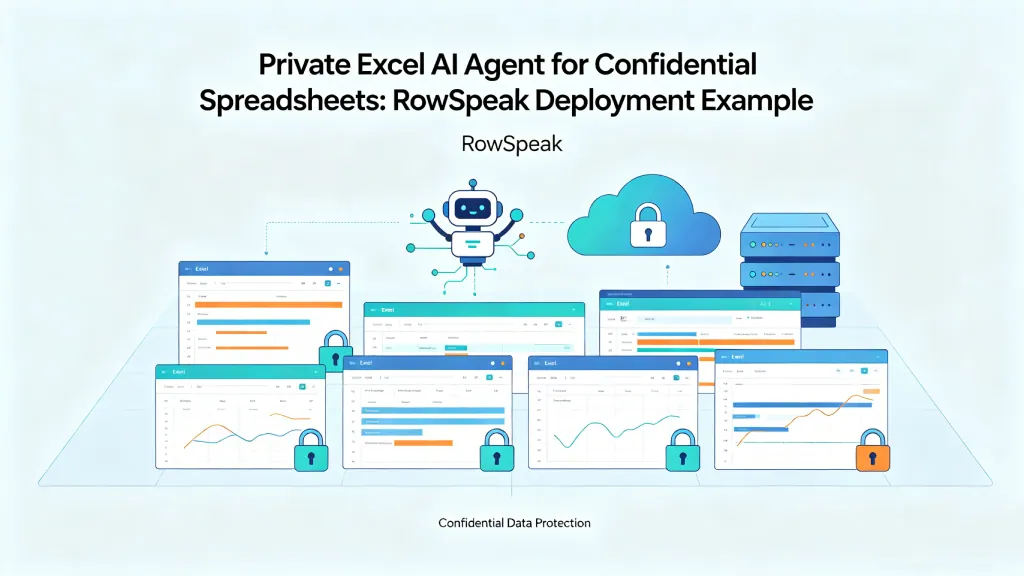

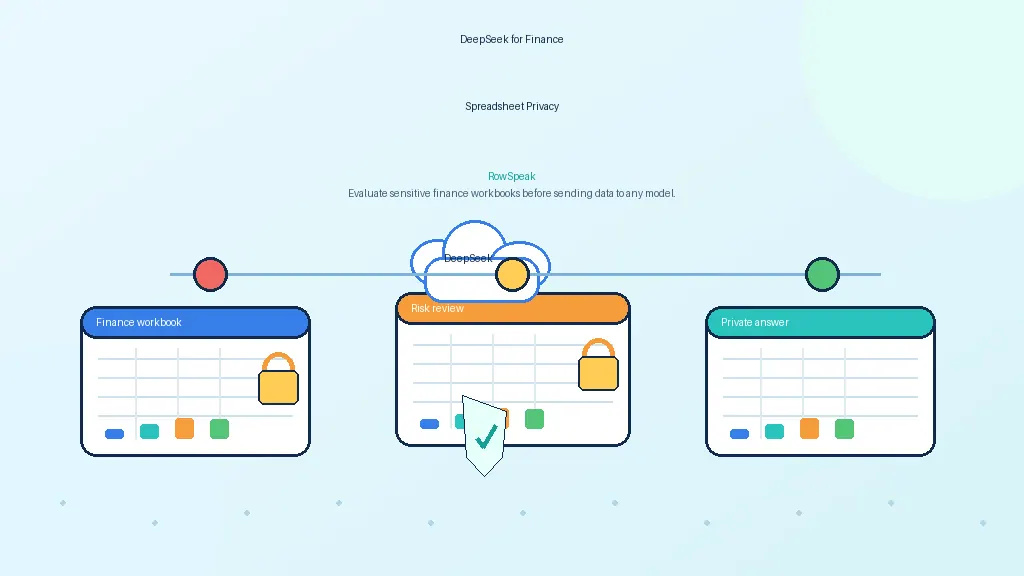

これは、機密性の高いスプレッドシートのデータを外部APIに送信することなく、より強力なAI機能を活用したいと考えているチームにとって、極めて重要な意味を持ちます。

財務レポートのプライベートAI活用、業務ワークブック、社内データのエクスポート、あるいは定期的なスプレッドシート分析を検討している場合、もはや「このようなモデルを自社インフラで動かせるか」という段階ではありません。真の課題は、「それを従業員が実際に活用できる安全な社内サービスへと転換できるか」にあります。

この記事は、その課題を解決するために作成されました。

具体的には、社内スプレッドシート分析のための実践的なプライベートAI環境の構築手順を解説します:

- 自社のGPUサーバーでDeepSeek-V4-Flashを実行する

- プライベートな推論APIとして公開する

- ビジネス実務に即したプロンプトでエンドポイントの動作を検証する

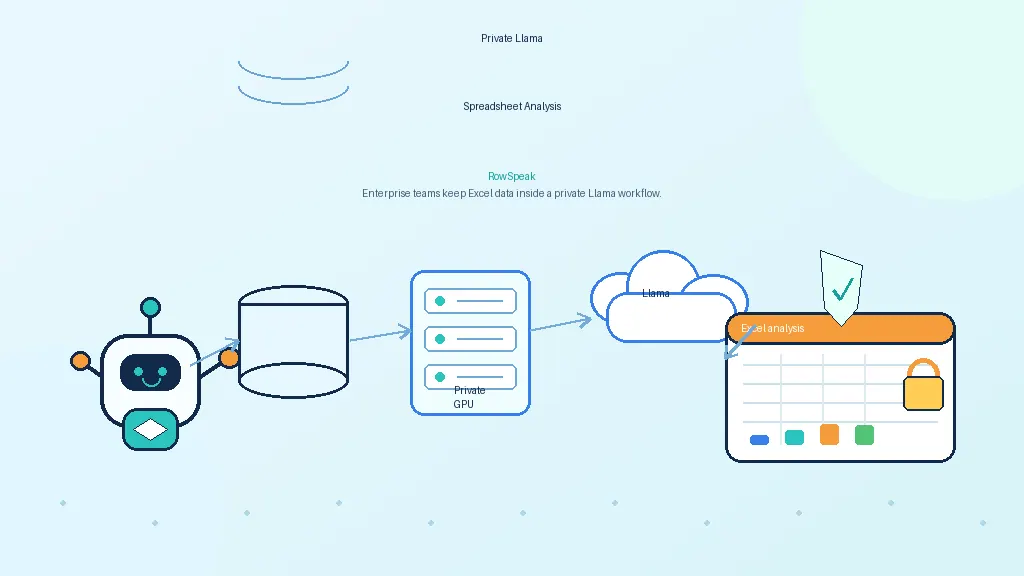

- RowSpeakのようなワークフロー層に接続し、非エンジニアでも生のモデル呼び出しを意識せずにスプレッドシートのデータを分析できるようにする

これは単なる「AIとのチャット」についての記事ではありません。実務レベルのスプレッドシート・ワークフローを支える、プライベートAIサーバーの構築ガイドです。

なぜチームはスプレッドシート分析にプライベートAIサーバーを求めるのか

セルフホスティングについて語られる際、それはしばしば思想的な選択のように聞こえることがあります。しかし実際には、その動機は運用面および商業面での合理性にあります。

財務チームは、経営レポートのワークフローを支える取締役会向けの報告資料を、可能な限りパブリックAPIに流したくないと考えています。運用チームは、社内のトラッカーや売上データ、複雑な部門横断のワークブックを、分析のためだけに社外環境に出したくはありません。そしてITやセキュリティチームは、他の社内システムと同様に、制御、監視、監査、制限が可能なモデルエンドポイントを求めています。

そこで、DeepSeek-V4-Flashが魅力的な選択肢となります。

DeepSeekは、社内AI導入の現実的な基盤として認識されるようになり、プライベートAIに関する議論において急速に存在感を高めています。

このモデルは導入する価値があるほど強力であり、かつプライベートな展開を現実にするほどオープンです。

カジュアルなチャット利用であれば、ホスト型のAPIの方が依然として手軽かもしれません。

しかし、実際の業務が以下のようなものであるなら、プライベートサーバーの構築は非常に説得力のある選択肢となります。

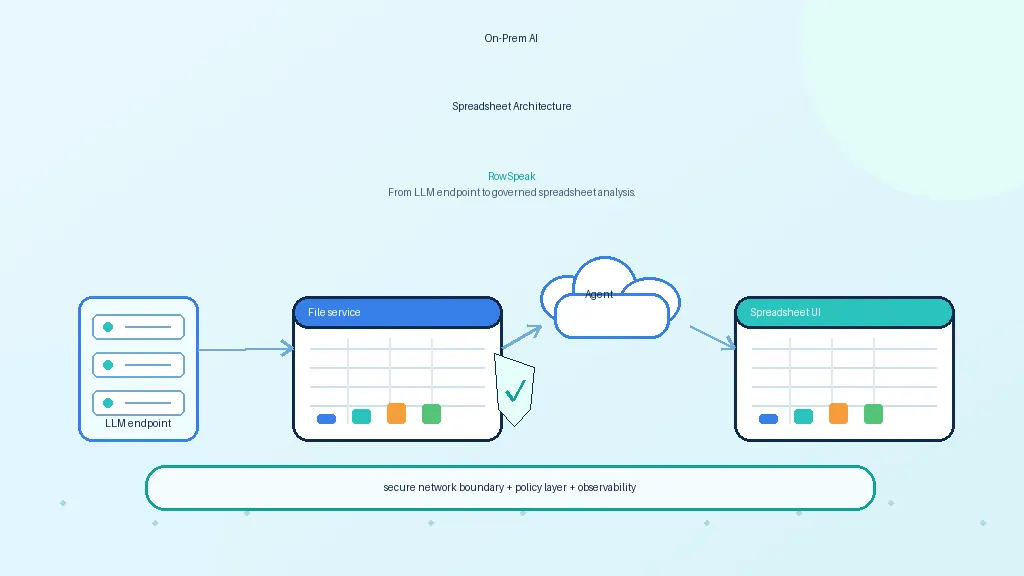

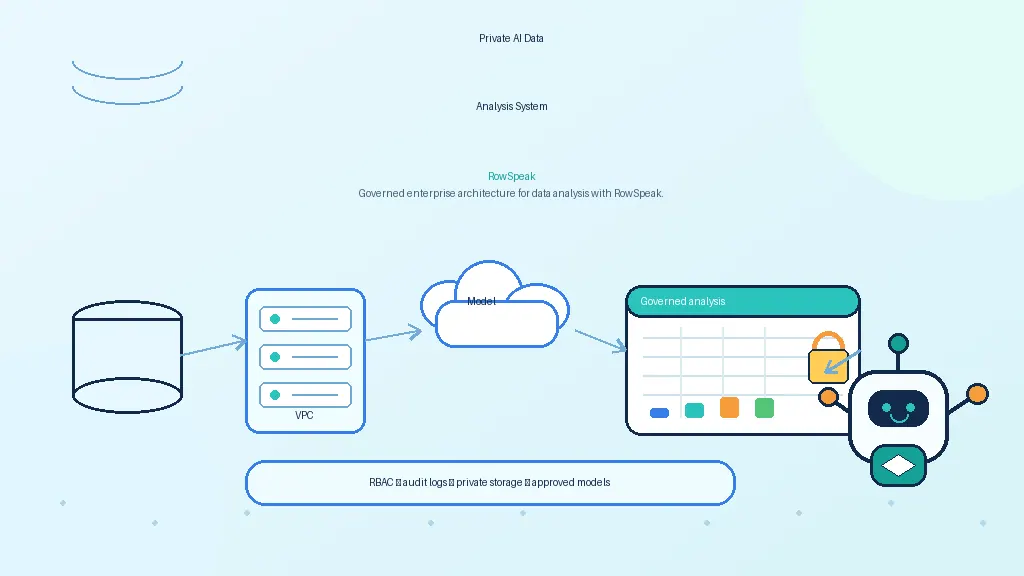

構築するシステムの全体像

幸いなことに、アーキテクチャ自体はシンプルです。

価値を生み出すために巨大なAIプラットフォームは必要ありません。必要なのは以下の4つです。

- 管理下のGPUサーバー

- モデルのランタイム

- プライベートAPIエンドポイント

- 実際のユーザーのためのワークフロー層

このセットアップにおいて:

- DeepSeek-V4-Flash がモデル本体となります。

- vLLM または Ollama がサービング層(実行環境)となります。

- RowSpeak が、モデルへのアクセスをスプレッドシート分析タスクへと変換するワークフロー層となります。

この分離は重要です。各レイヤーがそれぞれの役割に集中できるからです。

モデルサーバーは推論を処理します。ワークフロー層は、ファイルのアップロード、スプレッドシートの文脈を汲み取った自然言語での質問、要約、グラフ作成用の出力といった、ビジネス利用における煩雑な実務を処理します。

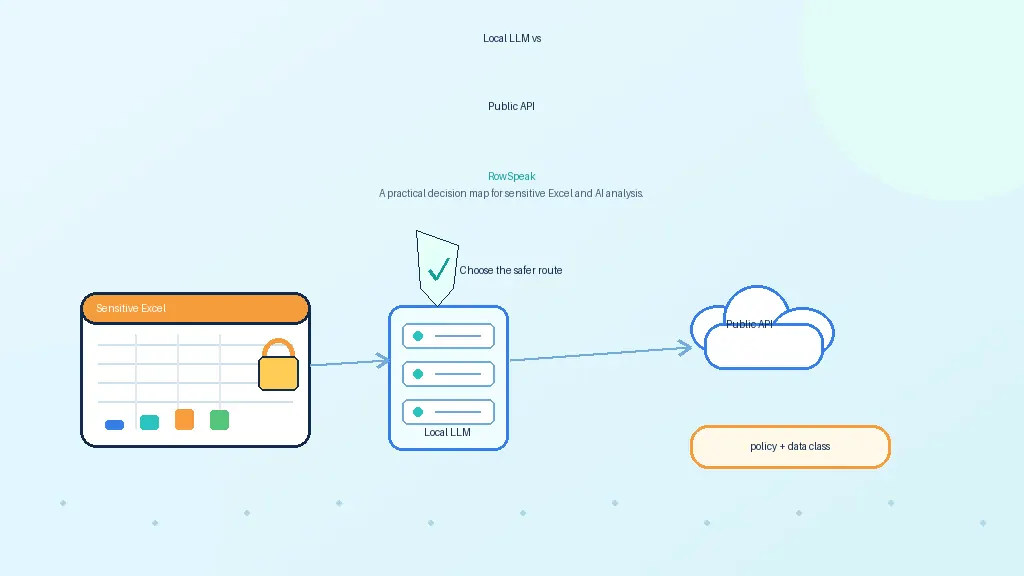

どのデプロイ方法を選択すべきか?

現実的な選択肢は2つあります。どちらを選ぶかは、どのような社内サービスを運用したいかによって決まります。

選択肢 1: vLLM

継続的なビジネス利用を目的とした本格的な社内AIエンドポイントを構築する場合、まずこちらをお勧めします。

理由は明確です。vLLMは本番環境向けのサービングスタックであり、OpenAI互換のAPIを備えているため統合がスムーズです。DeepSeek-V4-Flashを社内のスプレッドシート分析ワークフローの背後に配置することが目的であれば、APIの互換性とデプロイの制御性が非常に重要になります。

選択肢 2: Ollama

モデルのパッケージングとランタイムのサポートが要件に合致している場合、Ollamaはより便利な選択肢となります。

セットアップが容易で、小規模な社内シナリオや迅速な概念実証(PoC)には賢明な選択です。

判断基準を一行でまとめるなら、以下のようになります:

本番レベルのプライベートAIサーバーを構築したい場合はvLLMを、インフラの制御よりもスピードと簡便さを優先する場合はOllamaを選択してください。

開始前に:アイデアだけでなくサーバーを確認する

必要なハードウェアは、選択するDeepSeek-V4-Flashのモデルデータ、必要な精度、コンテキスト長、および想定される同時実行数によって異なります。

そのため、「GPUがX枚必要」といった一般的なアドバイスは誤解を招くことがよくあります。

より良いアプローチは、公式のモデルデータから逆算し、実際に提供しようとしているサービス規模に合わせてマシンのスペックを決定することです。

最低限、サーバーには以下が必要です:

- 管理権限のあるLinux

- NVIDIA GPU

- 適切にインストールされたドライバー

- 動作するCUDA環境

- Python

- 選択したモデルをロードするのに十分なVRAM

何よりも先に、以下のコマンドで正常性を確認してください:

nvidia-smi

python3 --version

基本的なことのように思えますが、実行する価値はあります。デプロイにおけるトラブルの驚くほど多くは、モデルの問題ではなく、ドライバーや環境設定、あるいは単純なマシンの準備不足に起因しています。

vLLMによるデプロイ

「本格的なデプロイ」を目指すなら、ここから始めてください。

ステップ 1: クリーンな環境にvLLMをインストールする

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

役立つドキュメント:

ステップ 2: 公式のDeepSeekモデルデータを使用する

ここで安易な近道を選ぶと、後で大きな苦労をすることになります。

可能な限り、出所の不明なミラーサイトは避けてください。DeepSeekの公式リリースページから、リンクされている公式のHugging Faceコレクションを辿ってください。

これにより、データの出所が明確になり、誤ったモデルをデプロイするリスクを最小限に抑えることができます。

DeepSeek V4 Previewローンチの一環としてV4-Flashを発表した公式リリースページ。

ステップ 3: APIサーバーを起動する

典型的なvLLMの起動コマンドは以下のようになります:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

モデルやマシンの構成に応じて、以下の調整が必要になる場合があります:

- テンソル並列化 (tensor parallelism)

- データ型 (dtype)

- 最大モデル長 (max model length)

- GPUメモリ使用率 (GPU memory utilization)

しかし、基本的な考え方は同じです。モデルを起動し、エンドポイントを公開し、アプリケーション側に触れる前にサービング層が安定していることを確認します。

ステップ 4: デモではなくAPIとしてエンドポイントをテストする

RowSpeakなどを接続する前に、モデルサーバーが単体で正しく応答するかを検証します。

例:

curl http://YOUR_SERVER_IP:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "スプレッドシート分析のためにLLMをセルフホストするメリットを要約してください。"}

]

}'

サーバーが有効なレスポンスを返せば、コアとなるサービングパスは機能しています。

この段階でテストを複雑にしすぎないでください。まだシステム全体のベンチマークを行っているわけではありません。エンドポイントが生きており、モデルが正しくロードされ、APIがアプリケーションの期待通りに動作することを確認するのが目的です。

Ollamaによるデプロイ

Ollamaはより軽量な方法であり、パッケージが要件に合致すれば、使用可能な環境を構築する最短の道となります。

重要なのは、これを万能な解決策として扱わないことです。使いたいDeepSeekのビルドが、Ollamaでスムーズに提供できる形式で利用可能な場合に最適な選択肢となります。

公式ドキュメント:

まずインストールします:

curl -fsSL https://ollama.com/install.sh | sh

次に、Ollamaがサポートする形式でモデルをプルまたは登録し、他のシステムと統合する前に直接テストします。

最小限のローカルテストは以下の通りです:

ollama run YOUR_DEEPSEEK_MODEL

Ollama API経由で公開する場合は、まずそのAPIを直接テストしてください。

「おもちゃ」ではなく「ビジネス」のプロンプトでテストする

この部分は軽視されがちです。

多くのプライベートAI導入において、挨拶や段落の要約、ジョークの作成ができただけで「成功」と見なされてしまいます。しかし、それでは実際に重視している社内業務に役立つかどうかはほとんど分かりません。

スプレッドシート分析が目的であれば、財務、運用、あるいはAIレポート作成チームが実際に必要とするようなプロンプトでテストするのが賢明です。

例:

地域、担当者、売上、数量、利益率の列がある週次売上スプレッドシートがあります。

最もパフォーマンスの低い地域を特定し、利益率が低下している担当者を抽出した上で、エグゼクティブサマリー用に3つの推奨グラフを提案してください。

このようなテストは、単にモデルが動作しているかどうかだけでなく、ビジネスにとって真に有用な形で社内スプレッドシート分析をサポートできるかどうかを明らかにします。

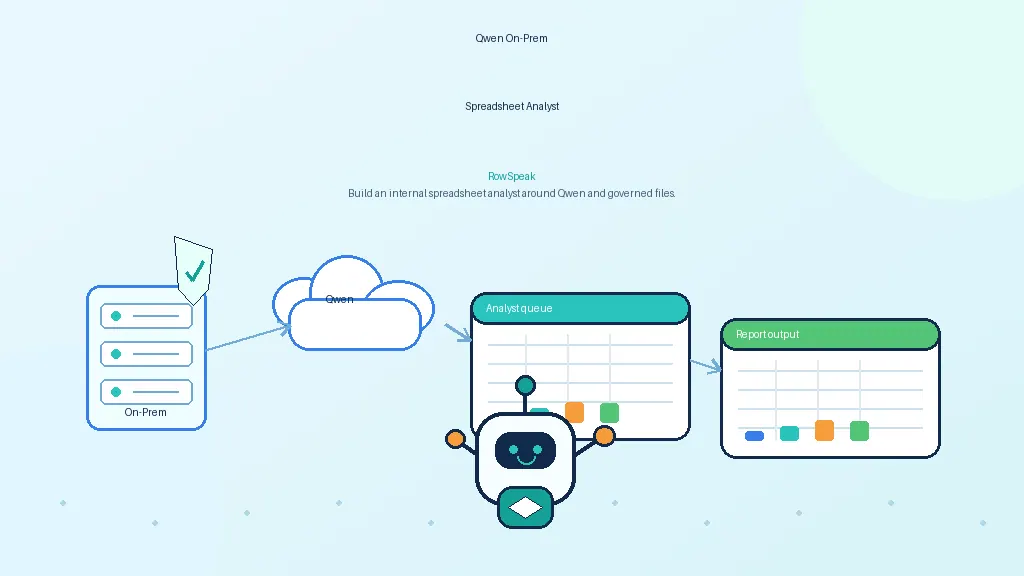

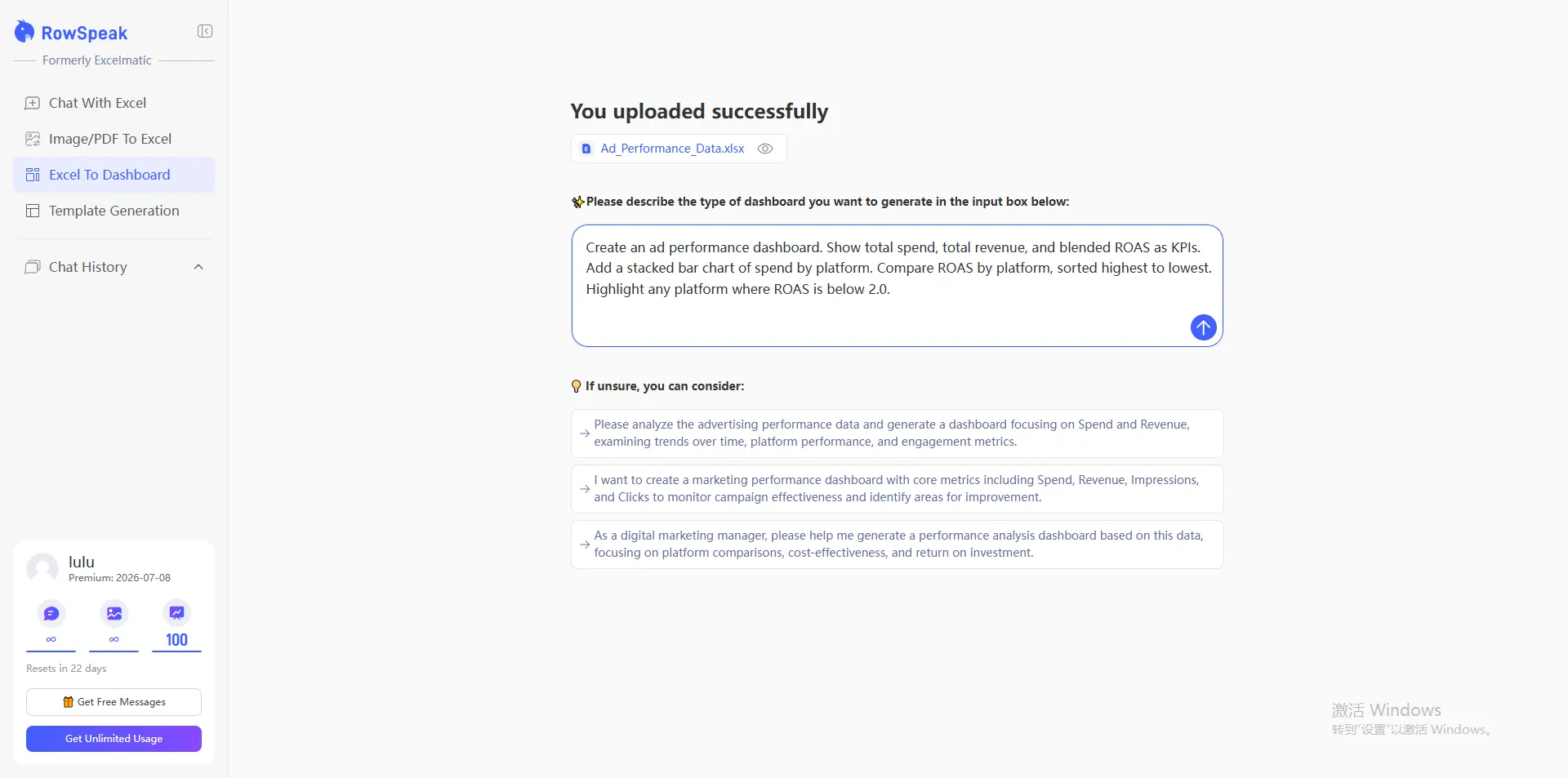

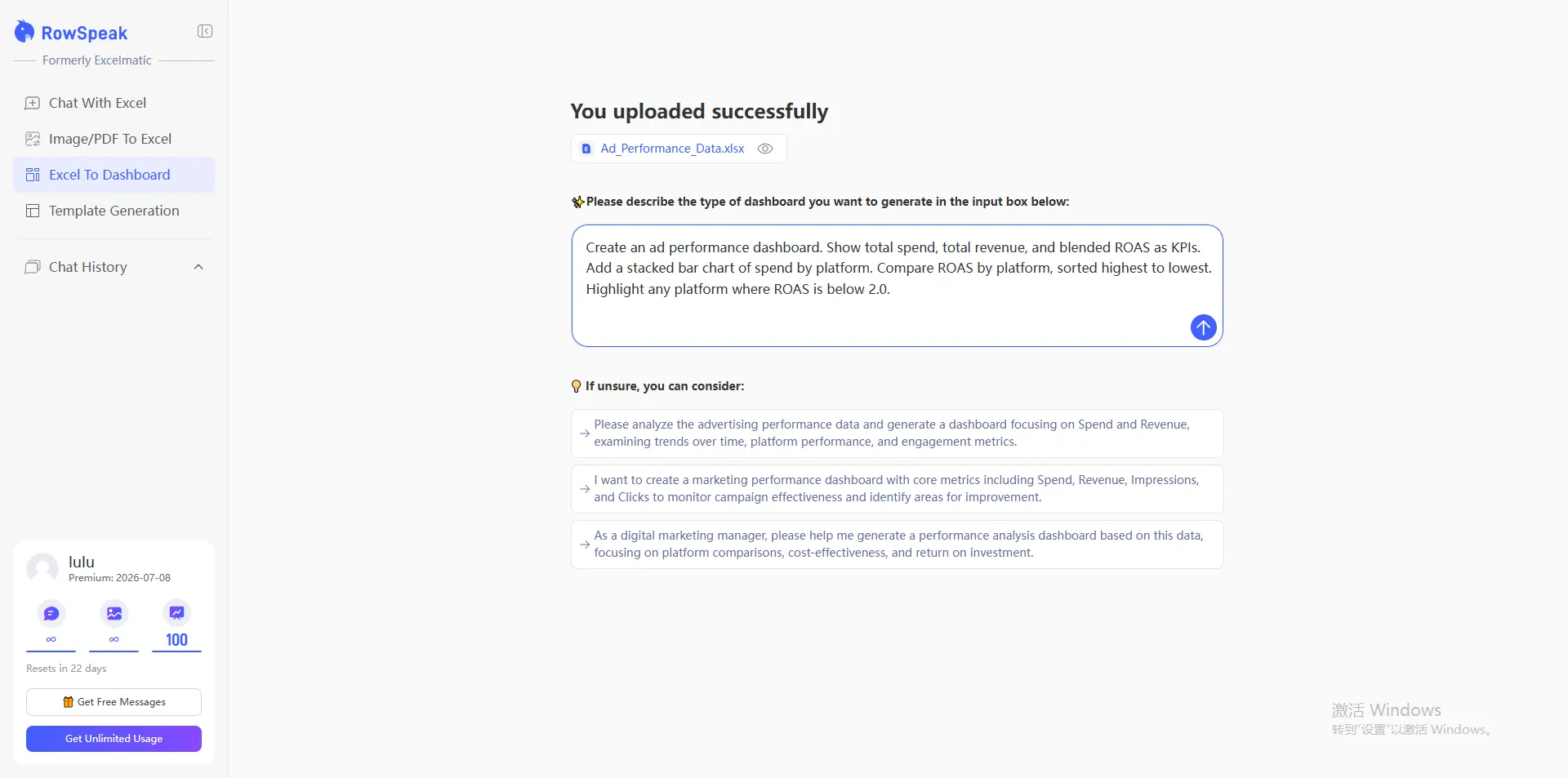

RowSpeakの役割

プライベートモデルのエンドポイントが機能するようになれば、RowSpeakはシステム全体を実際のチームが利用できるようにするためのレイヤーとなります。

ユーザーに生の推論リクエストを意識させる代わりに、RowSpeakはファイルやスプレッドシート分析タスクを中心としたワークフローを提供します。

これにより、ユーザーは以下のことが可能になります:

- スプレッドシートのアップロード

- 自然言語による分析の質問

- 要約の生成

- グラフ作成用データの出力

- 複雑なビジネスデータの直感的な処理

この記事で最も重要な視点はこれです:

価値は「CSVとチャットすること」ではありません。

価値は、社内の煩雑なスプレッドシートデータを取り込み、管理下のプライベートAIサーバーを経由させ、その結果をAI生成レポート、意思決定支援、社内ワークフローに活用できる形に変換することにあります。

![]()

最終検証:何が本当に重要か

デプロイを完了とする前に、実際の社内展開において重要な項目を確認してください:

- 繰り返しのリクエストに対してエンドポイントは安定しているか?

- 社内利用において許容できるレイテンシ(遅延)か?

- アプリケーション内でモデル名が正しく設定されているか?

- ネットワークルールとアクセス制御は適切か?

- 分析結果やグラフ出力は、実際のスプレッドシートタスクにおいて有用か?

最後のポイントは見落とされがちです。

プライベートAIの導入は、サーバーが動いているだけで成功とは言えません。社内ユーザーが機密データを外部に送ることなく、実務のスプレッドシート作業でそのシステムを信頼して使えるようになった時こそが成功です。

![]()

まとめ:最短の実行ステップ

DeepSeek-V4-Flashは正式に公開されたオープンウェイトモデルです。社内スプレッドシート分析のためにプライベートAIを運用したい場合、最もスムーズな道は、まず自社のGPUサーバーにvLLM(または状況に応じてOllama)でデプロイし、ビジネス実務に即したプロンプトでAPIを検証し、その上にRowSpeakのようなワークフロー層を接続することです。

その後、環境変数で orchestrator_model=deepseek-v4-flash を設定すれば、パブリックなモデルAPIにデータを流すことなく、RowSpeakを使用して社内データの分析やグラフ生成を行うことができます。

FAQ

DeepSeek-V4-FlashはプライベートAIの導入に適していますか?

はい。スプレッドシート分析、レポート支援、業務ワークフローなどの社内ユースケースにおいて、自社環境内で高性能なモデルを動かしたい場合に最適です。機密性の高い社内データをパブリックAPIに送信することなく、強力なモデルを活用できる点が最大のメリットです。

社内デプロイにはvLLMとOllamaのどちらを使うべきですか?

本番運用を見据えた社内AIサーバーを構築する場合は vLLM から始めてください。迅速なプロトタイプ作成やシンプルなローカル環境が必要な場合は Ollama が適しています。実際には、多くのチームがOllamaで検証し、vLLMで実運用化しています。

デプロイ成功と判断する前に何をテストすべきですか?

「サーバーから返答があった」だけで満足しないでください。エンドポイントの安定性、レイテンシ、アクセス制御の適切さ、そして財務や運用チームが実際に行うスプレッドシート分析タスクにおいて、出力結果が真に有用かどうかをテストしてください。

これはスプレッドシート分析専用ですか、それとも一般的なチャット用ですか?

多くのビジネスユーザーにとって、価値は汎用的なチャットではなく、社内環境からデータを出すことなく、スプレッドシート、CSV、レポートなどの構造化されたビジネスデータの処理を支援することにあります。

このアーキテクチャにおいてRowSpeakはどこに位置しますか?

RowSpeakは、プライベートモデルエンドポイントの上位にあるワークフロー層です。ユーザーが生のモデルAPIを操作する代わりに、アップロード、質問、要約、グラフ出力といったスプレッドシート特化型のインターフェースを提供します。

チームへのプライベートデプロイが必要ですか?

機密データをパブリックAPIに送ることなく、社内スプレッドシート分析にAIを活用したい場合、RowSpeakはセルフホストされたモデルを実用的な社内ワークフローへと変えるお手伝いをします。

一般的なエンタープライズ構成には以下が含まれます:

- プライベートまたはオンプレミスのデプロイオプション

- 自社モデルエンドポイントへの接続

- スプレッドシートに特化した分析ワークフロー

- 財務、運用、レポート作成チームへのサポート

- 社内のデータセキュリティ要件に準拠した制御

単なるモデルのデモではなく、実稼働するプライベートAIの導入を検討されている場合は、RowSpeakにお問い合わせの上、ユースケースをご相談ください。