DeepSeek-V4-Flash 现已正式发布,公开且开源权重。

这对于一类特定的用户群体至关重要:那些希望在不将敏感电子表格数据发送到外部 API 的情况下,获得更强 AI 能力的团队。

如果你正在评估用于财务报告私有化 AI、运营工作簿、内部数据导出或定期电子表格分析的方案,那么问题不再仅仅是这类模型是否可以在你自己的基础设施上运行。真正的问题在于,你是否能将其转化为一个人们真正可以使用的安全内部服务。

本文旨在为此提供帮助。

更具体地说,它介绍了一个用于内部电子表格分析的实用私有 AI 搭建流程:

- 在你自己的 GPU 服务器上运行 DeepSeek-V4-Flash

- 将其公开为私有推理 API

- 验证该端点在业务场景提示词下的工作情况

- 将其连接到像 匡优数言 这样的工作流层,以便非技术用户可以分析电子表格数据,而无需处理原始模型调用

这并不是一篇关于“与模型聊天”的文章。它是关于构建一个能够支持真实内部电子表格工作流的私有 AI 服务器。

为什么团队需要用于电子表格分析的私有 AI 服务器

当人们谈论私有化部署时,往往听起来像是出于意识形态。实际上,其动力通常是运营和商业层面的。

财务团队不希望董事会报告的电子表格通过公共 API(如果可以避免的话),特别是当这些文件支持管理报告工作流时。运营团队不希望内部跟踪表、收入导出数据和复杂的跨部门工作簿离开其环境。而 IT 或安全团队通常想要更简单的东西:一个他们可以像控制其他内部系统一样进行控制、监控、审计和限制的模型端点。

这就是 DeepSeek-V4-Flash 的吸引力所在。

DeepSeek 已迅速成为私有 AI 讨论的一部分,因为团队现在将其视为内部 AI 部署的现实基础。

它的性能足够强大,值得部署;它的开放性也足够高,使得私有 AI 的落地变得现实。

如果你的用例只是日常的消费者聊天,托管 API 可能仍然是更简单的选择。

但如果你的实际工作负载更接近以下情况:

那么私有服务器路径就开始显得更具吸引力。

你实际在构建什么

好消息是,架构本身很简单。

你不需要一个庞大的 AI 平台来获取价值。你需要四样东西:

- 一个你控制的 GPU 服务器

- 一个模型运行时

- 一个私有 API 端点

- 位于该端点之上、面向真实用户的工作流层

在这个设置中:

- DeepSeek-V4-Flash 是模型

- vLLM 或 Ollama 是服务层

- 匡优数言 是将模型访问转化为电子表格分析任务的工作流层

这种分离很重要,因为它让每一层都保持专注。

模型服务器处理推理。工作流层处理复杂的业务使用现实:文件上传、电子表格上下文和自然语言问题、摘要以及图表化输出。

哪种部署路径最合理?

这里有两条现实的路径,正确的选择取决于你试图运行什么样的内部服务。

选项 1:vLLM

如果你正在构建一个用于重复业务使用的严肃内部 AI 端点,这是我首选的路径。

原因很简单:vLLM 是一个面向生产的服务栈,其 OpenAI 兼容的 API 使集成更简洁。如果你的目标是将 DeepSeek-V4-Flash 置于内部电子表格分析工作流之后,API 兼容性和部署控制就非常重要。

选项 2:Ollama

当模型打包和运行时支持符合你的部署需求时,Ollama 是更方便的选择。

它更容易上手,对于较轻的内部场景或快速概念验证(PoC),它是一个明智的选择。

但如果我必须用一句话总结这个决定,那就是:

当你想要一个更具生产力的私有 AI 服务器时,使用 vLLM;当速度和简单性比基础设施控制更重要时,使用 Ollama。

在开始之前:检查服务器,而不仅仅是想法

你需要的确切硬件取决于你选择的 DeepSeek-V4-Flash 具体版本、你想要的精度、上下文长度以及预期的并发量。

这就是为什么通用的“你需要 X 个 GPU”的建议往往具有误导性。

更好的方法是从官方模型版本开始,根据你实际计划提供的服务来确定机器规格。

你的服务器至少应具备:

- 你控制的 Linux 系统

- NVIDIA GPU

- 完整的驱动程序安装

- 正常运行的 CUDA 环境

- 已安装 Python

- 足够的显存(VRAM)来运行你选择的模型版本

在进行任何其他操作之前,运行一次环境检查:

nvidia-smi

python3 --version

这听起来很基础,但非常值得一做。令人惊讶的是,大量的部署问题根本不是模型问题,而是驱动问题、环境问题或简单的机器准备错误。

使用 vLLM 部署

如果你想要最清晰的“真实部署”路径,请从这里开始。

第 1 步:在干净的环境中安装 vLLM

python3 -m venv .venv

source .venv/bin/activate

pip install --upgrade pip

pip install vllm

有用文档:

第 2 步:使用官方 DeepSeek 版本

这是一个小捷径可能会在以后带来巨大痛苦的地方。

如果可以避免,不要从随机镜像开始。从 DeepSeek 官方发布页面开始,然后关注那里链接的官方 Hugging Face 集合。

这为你提供了更清晰的来源追踪,并降低了部署错误版本的几率。

DeepSeek 官方发布页面宣布 V4-Flash 作为 DeepSeek V4 预览版发布的一部分。

第 3 步:启动 API 服务器

典型的 vLLM 启动命令如下:

python -m vllm.entrypoints.openai.api_server --model deepseek-ai/DeepSeek-V4-Flash --host 0.0.0.0 --port 8000

根据模型版本和机器情况,你可能还需要调整:

- 张量并行(tensor parallelism)

- 数据类型(dtype)

- 最大模型长度

- GPU 显存利用率

但基本思路是一样的。启动模型,暴露端点,并在接触应用端之前确保服务层稳定。

第 4 步:像测试 API 一样测试端点,而不是像测试演示

在连接 匡优数言 或其他任何工具之前,验证模型服务器本身是否能正确响应。

例如:

curl http://YOUR_SERVER_IP:8000/v1/chat/completions -H "Content-Type: application/json" -d '{

"model": "deepseek-ai/DeepSeek-V4-Flash",

"messages": [

{"role": "user", "content": "总结为电子表格分析自托管 LLM 的好处。"}

]

}'

如果服务器返回了有效的响应,说明核心服务路径已经跑通。

此时,请抵制过度复杂化测试的冲动。你现在还不是在对整个系统进行基准测试,而是在检查端点是否存活、模型是否正确加载以及 API 的行为是否符合应用的预期。

使用 Ollama 部署

Ollama 是更轻量级的路径,当打包文件匹配时,它可以是运行可用部署的最快方式。

重要的是不要将其视为万能答案。当你想使用的确切 DeepSeek 版本以 Ollama 可以干净提供服务的形式存在时,它是正确的选择。

官方文档:

先安装:

curl -fsSL https://ollama.com/install.sh | sh

然后以你的 Ollama 设置支持的格式拉取或注册模型,并在尝试集成到任何地方之前直接对其进行测试。

一个最小化的本地测试如下:

ollama run YOUR_DEEPSEEK_MODEL

如果你是通过 Ollama API 暴露服务,请先直接测试该 API。

使用业务提示词测试,而非玩具提示词

这部分很容易被低估。

许多私有 AI 部署被宣布为“成功”,仅仅是因为有人让端点打了个招呼、总结了一段话或写了个笑话。这几乎无法告诉你系统对于你真正关心的内部工作是否有用。

如果你的目标是电子表格分析,更聪明的测试是使用你的财务、运营或 AI 报告团队真正关心的那种提示词。

例如:

我有一份每周销售电子表格,包含地区、销售代表、收入、销量和利润率列。

找出表现最差的地区,识别利润率下降的销售代表,并为高管摘要推荐三个图表。

这种测试更具揭示性。它能告诉你模型是仅仅“活着”,还是能够以对业务真正有用的方式支持内部电子表格分析。

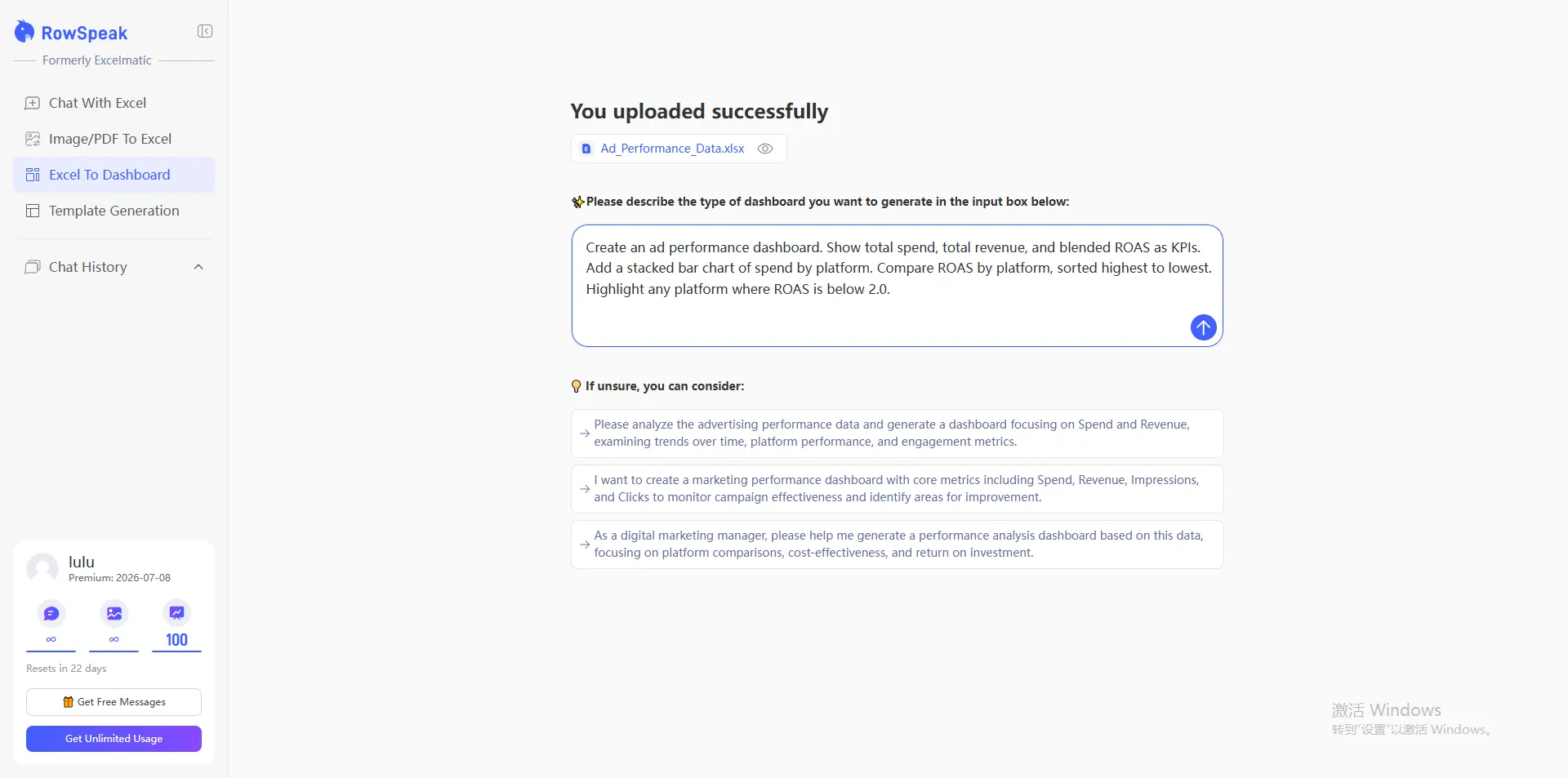

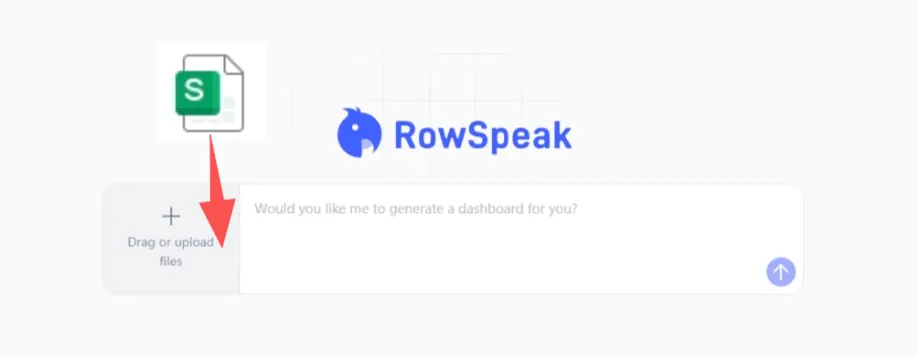

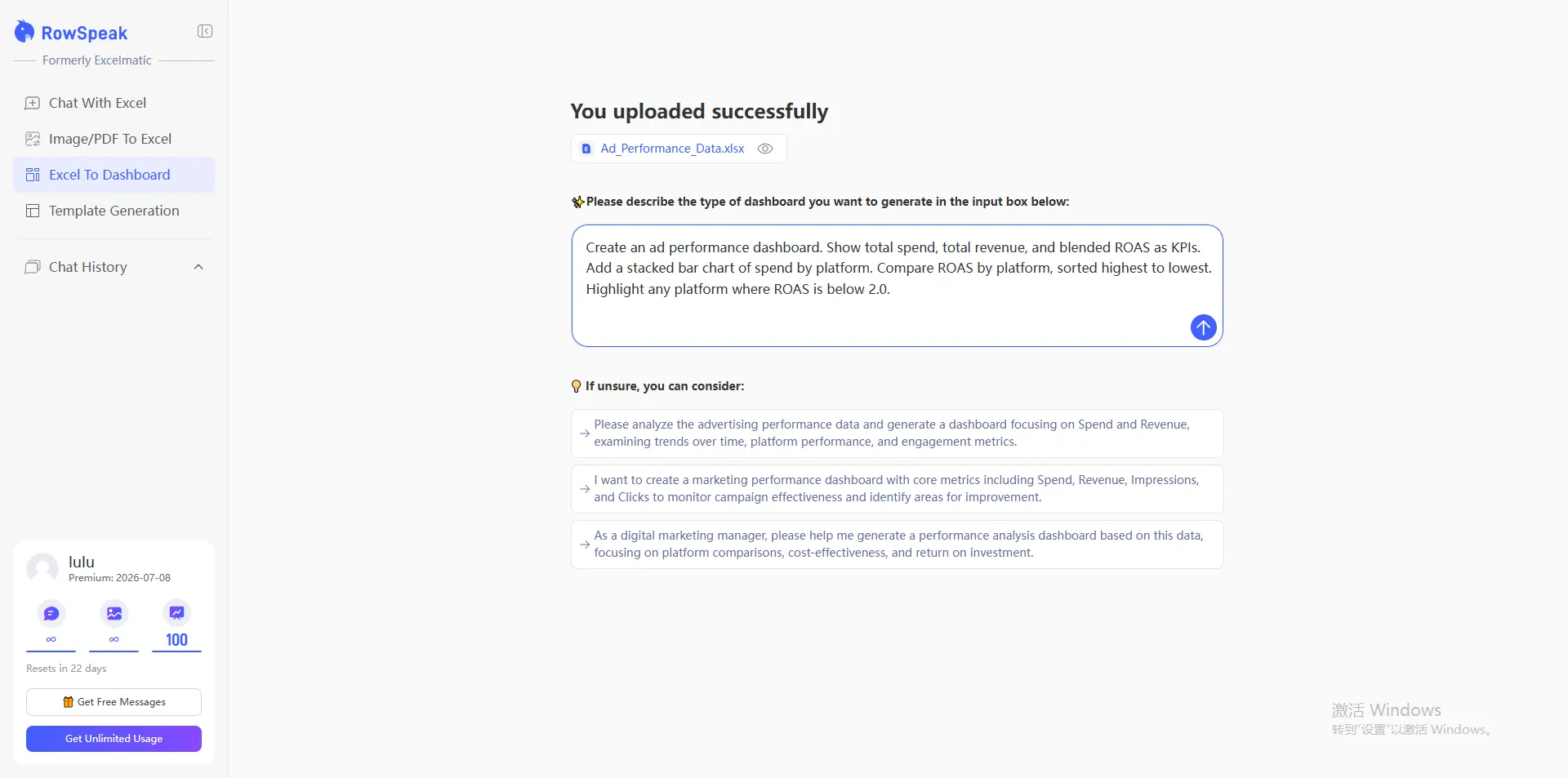

匡优数言 的位置

一旦私有模型端点正常工作,匡优数言 就成为了使整个系统可供实际团队使用的层。

匡优数言 不再强迫用户思考原始的推理请求,而是围绕文件和电子表格分析任务为他们提供工作流。

这意味着他们可以:

- 上传电子表格

- 用自然语言提问分析问题

- 生成摘要

- 创建面向图表的输出

- 更自然地处理杂乱的业务数据

这是整篇文章中最重要的框架:

其价值不在于“与 CSV 聊天”。

其价值在于获取杂乱的内部电子表格数据,通过你控制的私有 AI 服务器进行路由,并将结果转化为人们可以实际用于 AI 生成报告、决策支持和内部工作流的输出。

![]()

最终验证:真正重要的是什么

在宣布部署完成之前,请检查实际内部推广中重要的事情:

- 端点在重复请求下是否保持稳定?

- 延迟对于实际内部使用是否可以接受?

- 应用中的模型名称配置是否正确?

- 网络规则和访问控制是否正确?

- 分析和图表输出在真实的电子表格任务中是否真正有用?

最后一点是人们经常忽略的。

私有 AI 部署的成功不仅仅是因为服务器在运行。只有当内部用户可以依靠它进行真实的电子表格工作,而无需将敏感数据发送到环境之外时,它才是成功的。

![]()

最简短的实用总结

DeepSeek-V4-Flash 现已正式发布、公开且开源权重。如果你想运行私有 AI 进行内部电子表格分析,最清晰的路径是先将其部署在你自己的 GPU 服务器上(使用 vLLM,或者在合适的情况下使用 Ollama),使用业务风格的提示词验证 API,然后在顶部连接像 匡优数言 这样的工作流层。

然后,在你的环境变量中设置 orchestrator_model=deepseek-v4-flash,你就可以使用 匡优数言 进行内部数据分析和图表生成,而无需通过公共模型 API 路由工作。

常见问题解答

DeepSeek-V4-Flash 适合私有 AI 部署吗?

是的——如果你的目标是在自己的环境中运行一个能力强大的模型,用于电子表格分析、报告支持或运营工作流等内部用例。团队关注 DeepSeek-V4-Flash 的主要原因是,它提供了一个更强大的模型选项,而无需强制敏感的内部数据通过公共模型 API。

我应该使用 vLLM 还是 Ollama 进行内部部署?

如果你想要一个更具生产力的内部 AI 服务器,请从 vLLM 开始。如果你想要更快的概念验证或更简单的本地部署路径,Ollama 可能是一个不错的选择。在实践中,许多团队使用 Ollama 进行探索,使用 vLLM 进行工程化落地。

在宣布部署成功之前,我应该测试什么?

不要止步于“服务器有响应”。测试端点是否保持稳定、延迟是否可以接受、访问控制是否正确,以及输出对于财务、运营或报告团队的真实电子表格分析任务是否真正有用。

这真的是关于电子表格分析,还是只是通用聊天?

对于大多数企业买家来说,价值不在于通用聊天。价值在于使用私有 AI 服务器帮助内部团队处理电子表格、CSV 导出、报告和其他结构化业务数据,而不会将这些工作暴露在公司环境之外。

匡优数言 在这个架构中处于什么位置?

匡优数言 是私有模型端点之上的工作流层。它不是让用户与原始模型 API 交互,而是为他们提供一个专注于电子表格的界面,用于上传、提问、摘要和图表输出。

需要为你的团队进行私有部署吗?

如果你想在不将敏感数据发送到公共模型 API 的情况下运行 AI 进行内部电子表格分析,匡优数言 可以帮助你将自托管模型转化为可用的内部工作流。

典型的企业设置可以包括:

- 私有化或本地部署选项

- 连接到你自己的模型端点

- 专注于电子表格的分析工作流

- 支持财务、运营和报告团队

- 符合内部数据安全要求的控制措施

如果你正在评估私有 AI 落地并希望获得一条可行的路径(而不仅仅是模型演示),请联系 匡优数言讨论你的用例。