在本地运行大语言模型(LLM)仅仅是第一步。

如果目标是实现 AI 电子表格分析,仅有模型端点是不够的。业务用户并不想向内部推理服务器发送原始 JSON 数据。他们希望上传工作簿、提出问题、获得可靠的答案、生成图表,并清楚地知道数据的来源。

这需要在模型周围构建一套完整的架构。

本指南将解释私有化 AI 电子表格系统的主要组成部分。

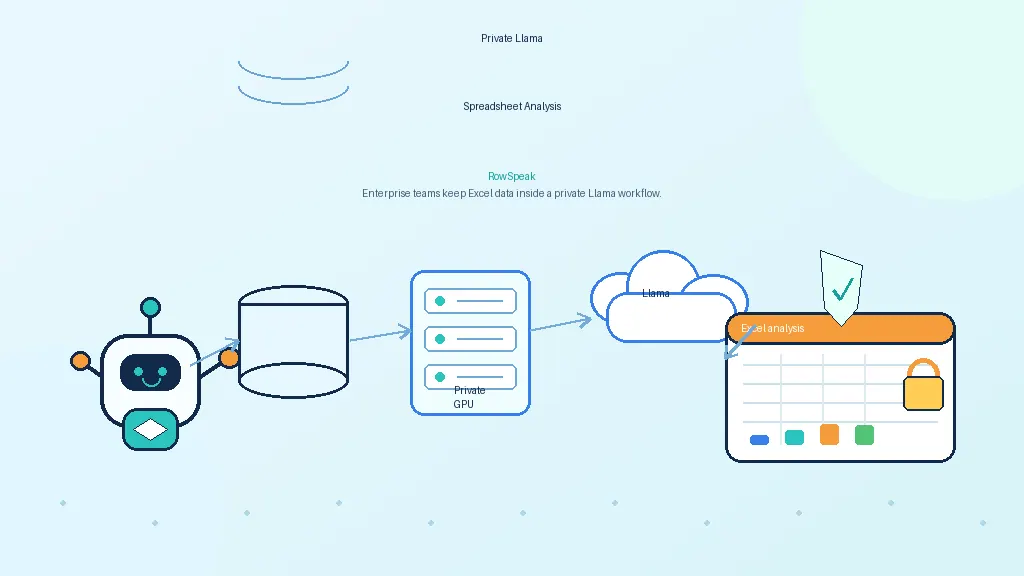

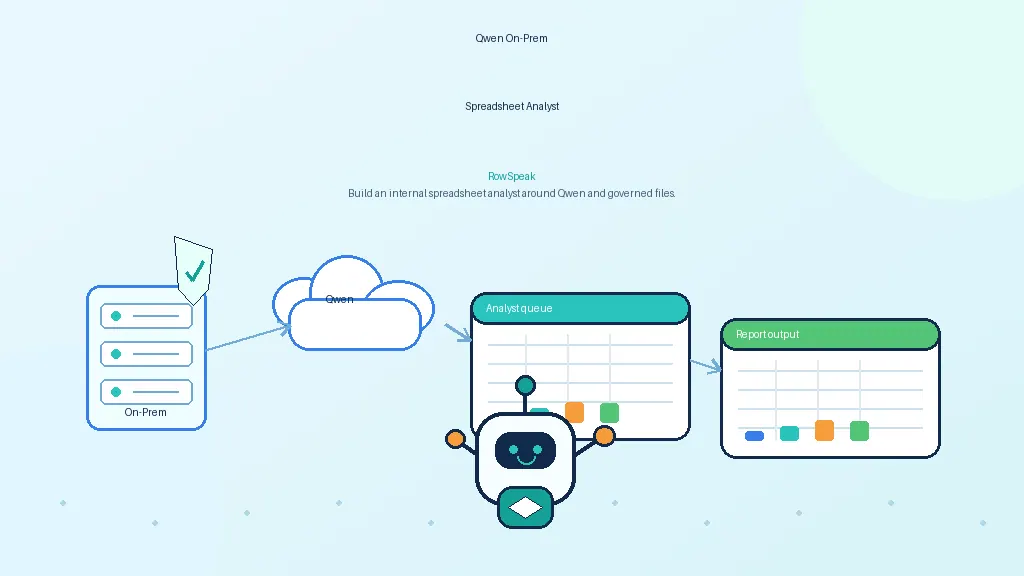

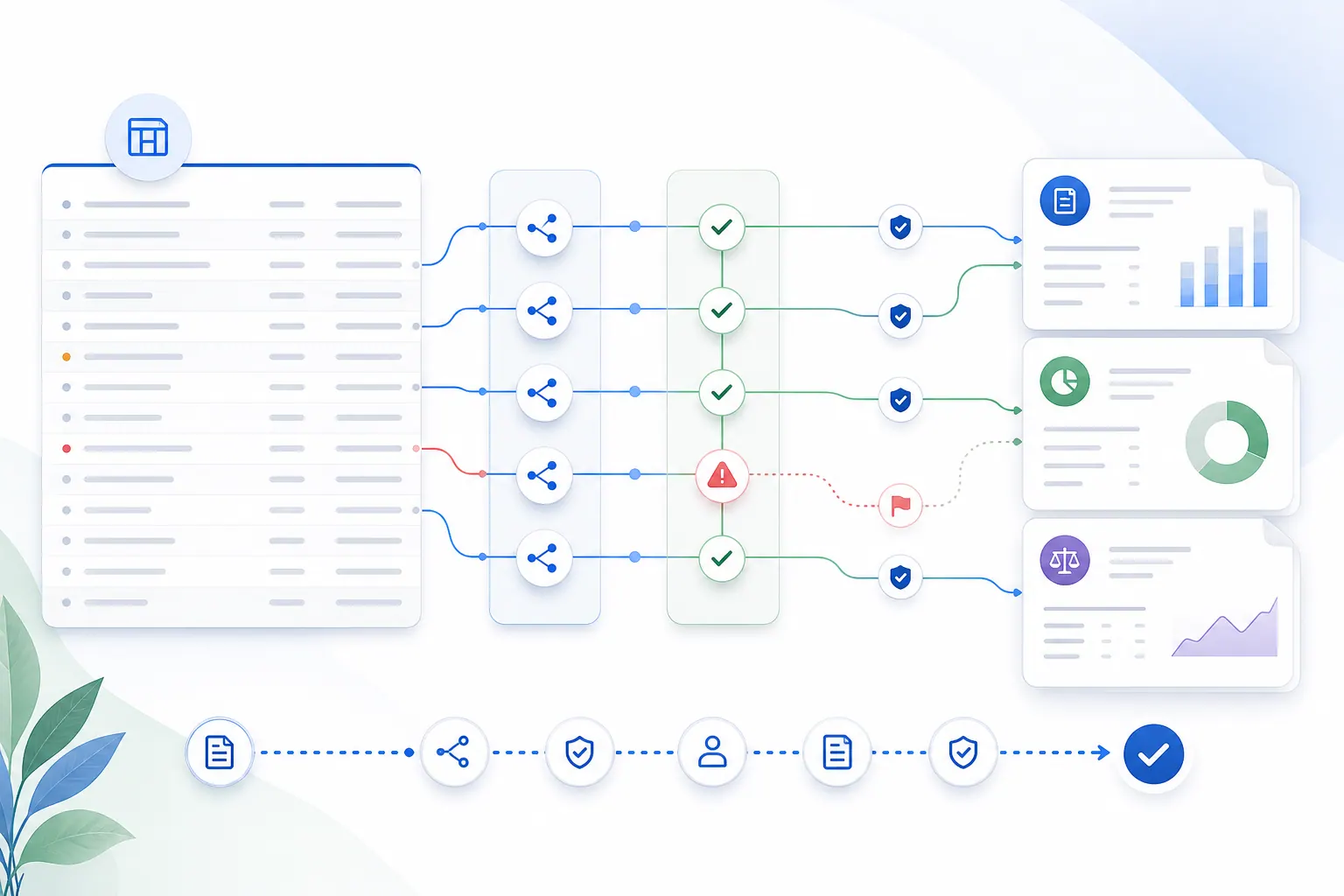

参考架构

一个实用的私有化 AI 电子表格架构如下所示:

虽然顺序可能有所不同,但原则是一致的:LLM 负责推理和解释,而受控系统负责处理数据访问、计算、安全和审计。

身份与访问控制

从身份验证开始。

每一个 AI 生成的答案都应与用户、工作空间、文件以及权限决策挂钩。

企业级部署通常需要:

- 通过 SAML 或 OIDC 实现单点登录(SSO)

- 基于角色的访问控制(RBAC)

- 来自身份提供商(IdP)的分组映射

- 工作空间级权限

- 文件级权限

- 数据集白名单

- 管理员控制

如果系统连接到数据库或对象存储,它不应绕过现有的权限体系。AI 不应成为绕过治理的捷径。

工作簿摄取

电子表格的摄取比看起来要难得多。

一个真实的工作簿可能包含:

- 多个工作表(Sheets)

- 隐藏的工作表

- 公式

- 合并单元格

- 不一致的表头

- 命名区域

- 批注

- 具有特定含义的格式

- 受保护的工作表

- 图表和透视表

- 外部链接

- 宏

生产系统应解析足够的结构信息,以避免给模型提供扭曲的数据视图。

出于安全考虑,应谨慎处理启用宏的文件。如果系统执行任何操作,都应在沙箱中进行。在许多部署场景中,宏应被扫描、阻止或视为元数据,而不是直接执行。

表格理解

摄取之后,系统应构建一个有效的工作簿表示。

这可能包括:

- 工作表摘要

- 表格边界

- 列名及推断的类型

- 样本行

- 公式依赖图

- 检测到的指标

- 日期范围

- 缺失值

- 异常值

- 跨表或跨文件的关系

这种表示是模型首先应该看到的。将整个工作簿直接塞进 Prompt 通常是浪费且有风险的。

目标是给模型提供足够的上下文来规划下一步,而不是让模型记住整个文件。

确定性计算层

对于电子表格 AI 来说,这是最重要的组件之一。

模型不应在内部计算关键数字,而应调用工具。

计算层可能包括:

- 电子表格公式

- SQL

- DuckDB

- pandas

- Polars

- 仓库下推(Warehouse pushdown)

- 图表生成

- 验证检查

例如,如果用户询问按收入排名的前几名客户,模型可以识别正确的字段并生成查询。计算层运行该查询,然后模型再解释结果。

这种分离提高了准确性、速度和可审计性。

私有化模型推理

模型层可以通过多种方式提供服务。

vLLM 常用于高吞吐量的自托管推理,并提供兼容 OpenAI 的服务器接口。

KServe 适用于组织需要 Kubernetes 原生模型服务和标准推理服务的情况。

NVIDIA NIM 为 NVIDIA 加速的基础设施提供优化的推理微服务。

Ollama 适用于试点和本地测试,但生产部署通常需要更强的扩展性、访问控制和可观测性。

模型层应被视为内部基础设施:

- 经过身份验证

- 具备版本控制

- 受到监控

- 通过网络控制进行隔离

- 配置明确的数据保留策略

- 在模型升级前进行评估

AI 编排

编排层决定系统如何使用模型和工具。

它负责处理:

- Prompt 模板

- 模型选择

- 工具选择

- 上下文构建

- 澄清问题

- 查询验证

- 代码沙箱

- 重试逻辑

- 响应格式化

这一层是许多安全控制所属的地方。

例如,如果模型生成了 SQL,系统应验证该 SQL 是只读的、限定在允许的表内,且执行成本不会太高。如果模型生成了 Python,系统应在禁用网络访问(除非明确允许)的沙箱中运行它。

可审计性

在严肃的部署中,审计日志是必不可少的。

一份有用的日志应包括:

- 用户

- 时间戳

- 访问的工作簿或数据集

- Prompt

- 模型名称和版本

- 生成的查询、公式或代码

- 工具输出

- 最终答案

- 权限决策

- 错误和降级处理

这并不意味着每个敏感值都必须永久存储。保留策略应该是可配置的。但系统需要足够的追溯能力来进行审查、调试和合规检查。

可观测性

技术团队需要同时监控基础设施和回答质量。

基础设施指标:

- 延迟

- GPU 利用率

- 队列深度

- Token 使用量

- 模型错误

- 工具执行时间

- 存储使用量

质量指标:

- 回答正确性

- 引用质量

- 公式有效性

- 查询成功率

- 用户纠错

- 幻觉报告

- 失败的澄清请求

如果没有可观测性,团队就无法知道 AI 分析师是在进步,还是在悄无声息地产生不可靠的工作成果。

常见误区

将模型视为电子表格引擎

这会导致计算结果幻觉和脆弱的答案。请使用工具进行计算。

先检索后过滤

权限强制执行应在上下文到达模型之前完成。

忽视工作簿的复杂性

CSV 演示并不能证明系统可以处理真实的 Excel 文件。

记录过多的敏感数据

可审计性很重要,但日志也必须遵循保留和隐私规则。

围绕单一模型构建

模型更迭很快。构建工作流时应确保模型可以被替换。

阶段性部署计划

一个现实的部署可以分阶段进行:

- 使用样本或脱敏的电子表格进行原型设计。

- 验证常见的分析任务和失败案例。

- 为所有数值工作添加确定性计算。

- 在使用真实文件之前接入身份和权限系统。

- 通过 vLLM、KServe、NIM 或其他经批准的栈部署私有模型端点。

- 添加审计日志和监控。

- 在某个团队进行试点,通常是财务、运营或销售报告团队。

- 在扩大规模前,根据已知答案评估输出结果。

这避免了在治理层建立之前就将模型 Demo 转化为生产系统的常见错误。

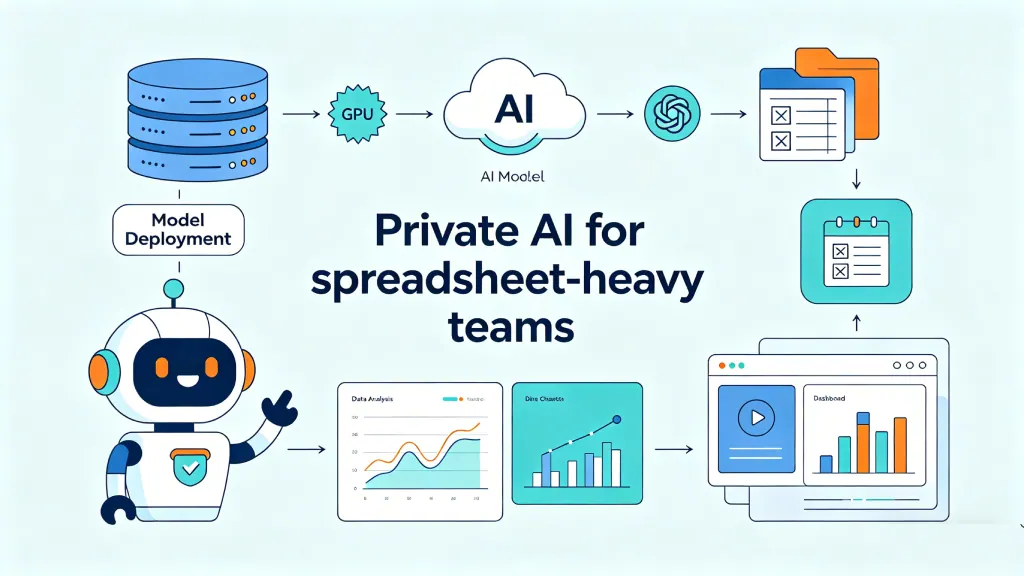

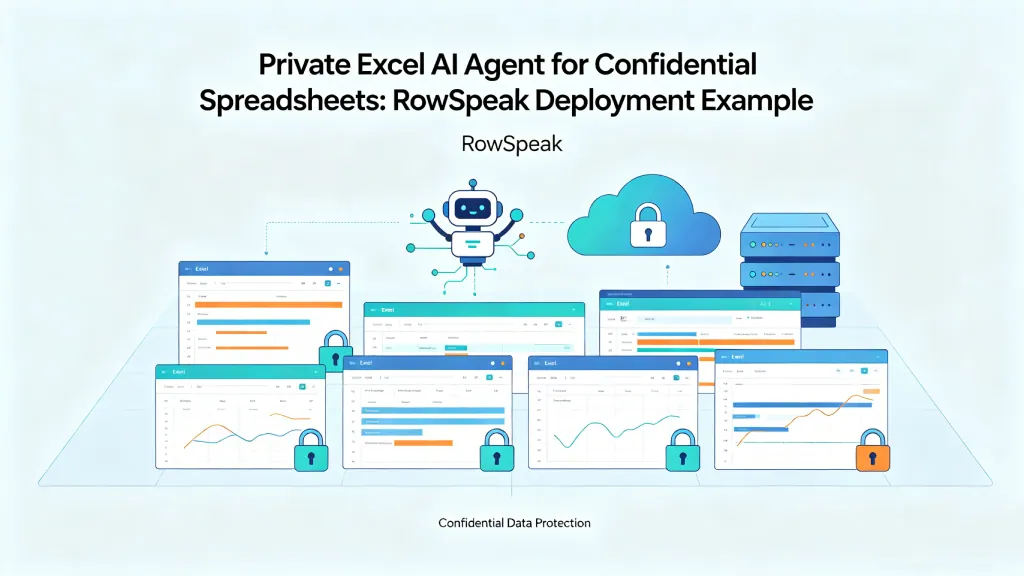

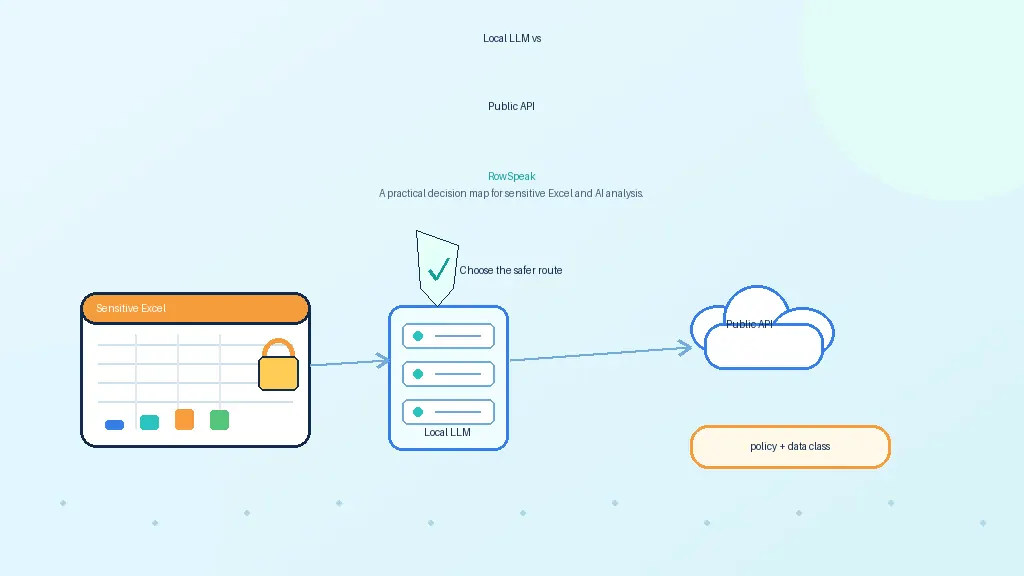

匡优数言 的定位

匡优数言 可以作为私有模型端点和受控数据执行之上的工作流层。

模型服务器提供推理能力。匡优数言 提供电子表格体验:工作簿上传、自然语言提问、图表、摘要、报告以及面向用户的分析流,例如 每周销售报告。

对于私有化部署,这种分离非常有价值。IT 部门可以控制模型和基础设施。业务用户仍然可以通过专为电子表格分析设计的界面进行工作,而不是直接调用原始 API,无论最终结果是 AI 仪表盘 还是财务报告。

总结

私有化 LLM 端点是基础设施。私有化 AI 电子表格分析师则是产品体验加治理。

模型固然重要,但其周围的架构决定了系统是否值得信赖。有关特定模型的示例,请参阅 为 匡优数言 私有化部署 DeepSeek 的相关指南。

来源与延伸阅读

- vLLM OpenAI 兼容服务器: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- KServe: https://kserve.github.io/website/

- NVIDIA NIM: https://www.nvidia.com/en-us/ai-data-science/products/nim-microservices/

- Ollama 库: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp