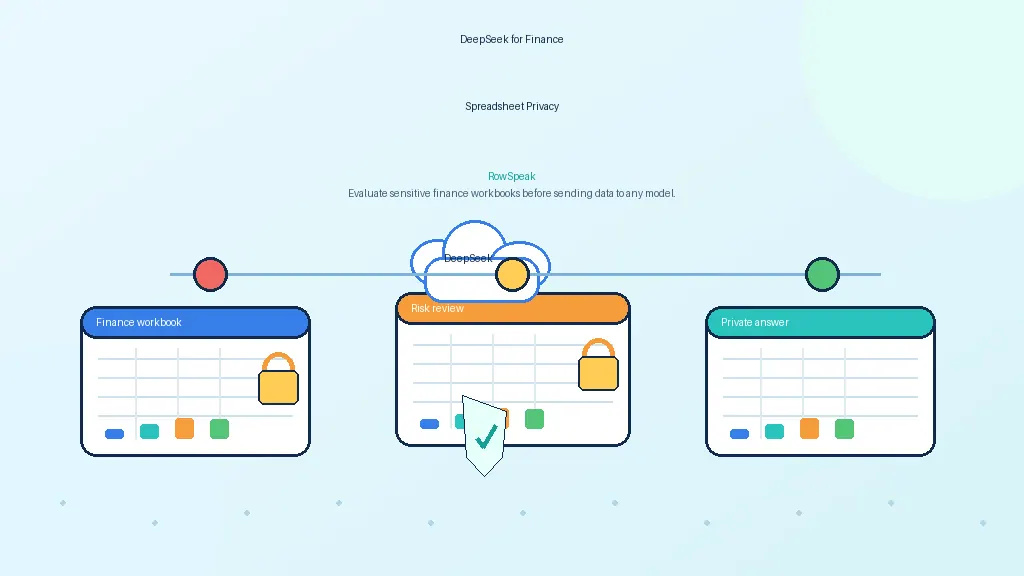

目前,许多团队都在思考一个简单的问题:我们能否在不将机密文件发送给公共 AI 服务的情况下,利用 Llama 来分析电子表格?

简短的回答是:可以,但有一个重要的前提。Llama 可以作为私有电子表格分析系统内部的推理层,但不应将其视为整个系统。

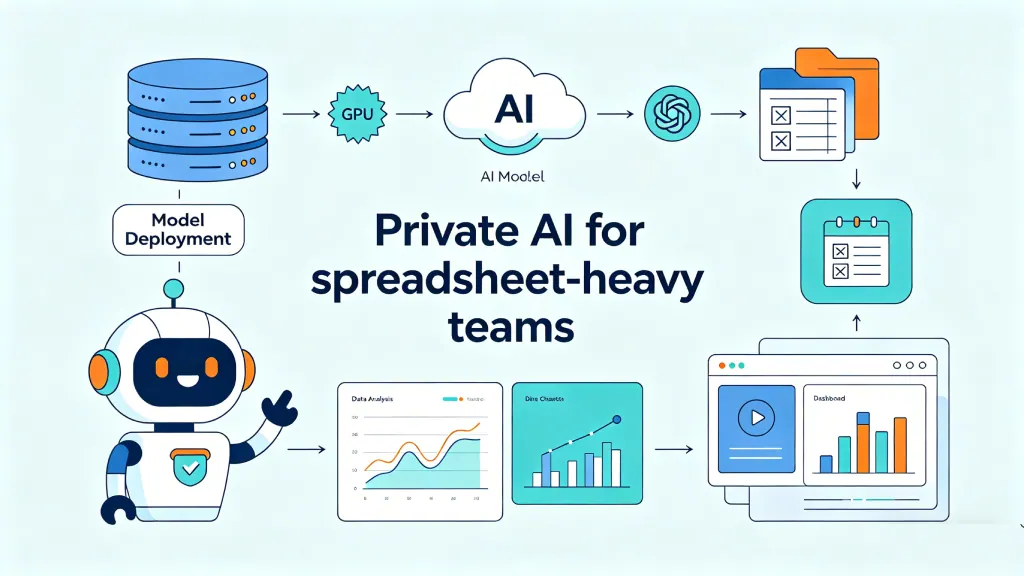

模型可以解释趋势、生成公式、编写 SQL、建议图表,并将复杂的业务问题转化为执行计划。但企业的电子表格工作还需要工作簿解析、确定性计算、权限检查、审计日志,以及一套财务或运营团队能够真正上手的用户工作流。

这种区分至关重要。大多数 AI 电子表格试点项目的失败,都是因为团队要求模型同时充当数据库、计算器、安全层和分析师。

为什么企业对使用 Llama 进行电子表格分析感兴趣

Llama 的吸引力在于它可以在公司控制的环境中运行。Meta 在 GitHub 上维护着官方的 Llama 仓库,且 Llama 模型在各类自托管推理栈中得到了广泛支持。

对于拥有敏感电子表格数据的公司来说,这开启了一条实用的路径:

- 在私有 VPC 或本地环境中运行模型

- 通过内部 API 暴露模型能力

- 将工作簿保留在经过批准的存储中

- 避免将数据随意复制粘贴到公共聊天机器人中

- 构建一个遵循公司规则的内部 AI 分析师

这些应用场景通常是务实的,而非实验性的。

财务团队想知道毛利按地区变化的原因;销售运营团队想从每周导出的数据中总结流水变化;报告团队希望在管理层会议前从工作簿中获取评论草案。这些正是 AI 可以节省时间的工作流,同时也正是数据泄露风险极高的场景。

Llama 擅长什么

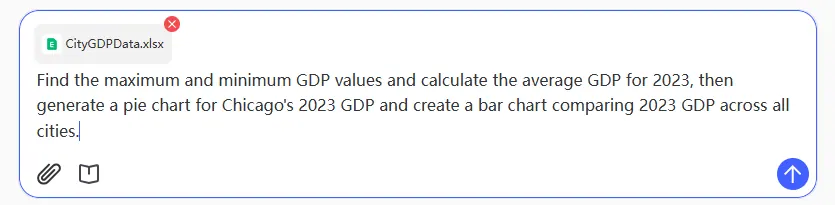

在电子表格分析中,当任务涉及语言理解、推理或工作流规划时,Llama 非常有用。

它可以帮助:

- 理解用户的自然语言问题

- 识别可能的列和指标

- 生成 Excel 公式或 SQL

- 解释差异或趋势

- 为报告建议图表

- 总结计算输出

- 起草管理层评论

- 将模糊的问题转化为结构化的分析计划

例如,用户可能会问:

上季度哪个产品类别导致了利润率下降?在执行报告中我应该使用什么图表?

一个优秀的 AI 系统可以利用 Llama 来理解请求,决定哪些字段重要,调用计算工具,并用通俗易懂的语言解释结果。

这里的关键词是“调用计算工具”。

Llama 不应独立完成的工作

电子表格模型不应要求 Llama 通过在 Prompt 中读取数千行数据来计算总和。这样做既慢又贵,而且不可靠。

大语言模型(LLM)可能会产生数字幻觉。它们可能会遗漏隐藏行,可能会混淆名称相似的列,还可能根据不完整的上下文给出看似合理的解释。

这并不意味着 Llama 不适用。这意味着架构必须诚实地对待模型所擅长的领域。

使用 Llama 进行意图理解、推理、代码或查询生成以及解释。使用确定性系统进行算术和数据运算。

这些确定性系统可能包括:

- SQL

- DuckDB

- pandas 或 Polars

- 兼容 Excel 的公式引擎

- BI 语义层

- 受控的仓库查询

模型负责规划和解释,计算层负责计算。

实用的私有架构

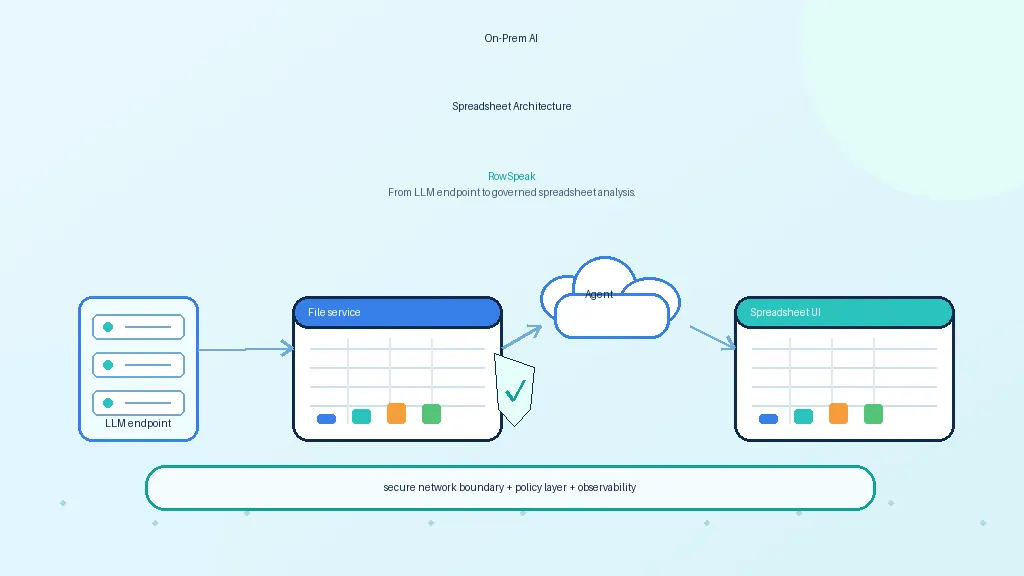

一个私有的 Llama 电子表格系统通常需要以下层级:

私有文件摄取

工作簿、CSV 和导出文件在公司环境内部上传。工作簿理解

系统提取工作表、列、公式、命名区域、数据类型和表格结构。计算层

通过 SQL、Python、电子表格公式或其他确定性引擎运行计算。模型端点

Llama 通过私有推理服务器运行。工作流层

用户提问、查看输出、创建图表并生成报告,而无需直接调用模型 API。治理层

系统强制执行权限、记录数据访问、控制保留期,并记录哪个答案是由哪些数据产生的。

这就是为什么仅有模型是不够的。Llama 可能很强大,但业务用户不需要一个原始的 /v1/chat/completions 端点,他们需要的是分析师级别的体验。

vLLM, Ollama, 还是 llama.cpp?

选择哪种运行时取决于项目的阶段。

Ollama 适用于本地测试和快速原型开发。它易于运行,非常适合验证 Prompt 和工作流构思。

vLLM 当团队需要生产级的 GPU 服务、批处理和兼容 OpenAI 的 API 时,它是更好的选择。vLLM 项目提供了兼容 OpenAI 的服务器文档,这使得将模型服务基础设施连接到应用层变得更加容易。

llama.cpp 适用于量化本地推理、CPU 或 Apple Silicon 实验以及受限环境。

对于企业电子表格分析,一条常见的路径很简单:先用 Ollama 制作原型,验证工作流,然后将正式的内部部署迁移到 vLLM 或其他生产级服务栈。

准确性问题是可以解决的,前提是你要为此设计

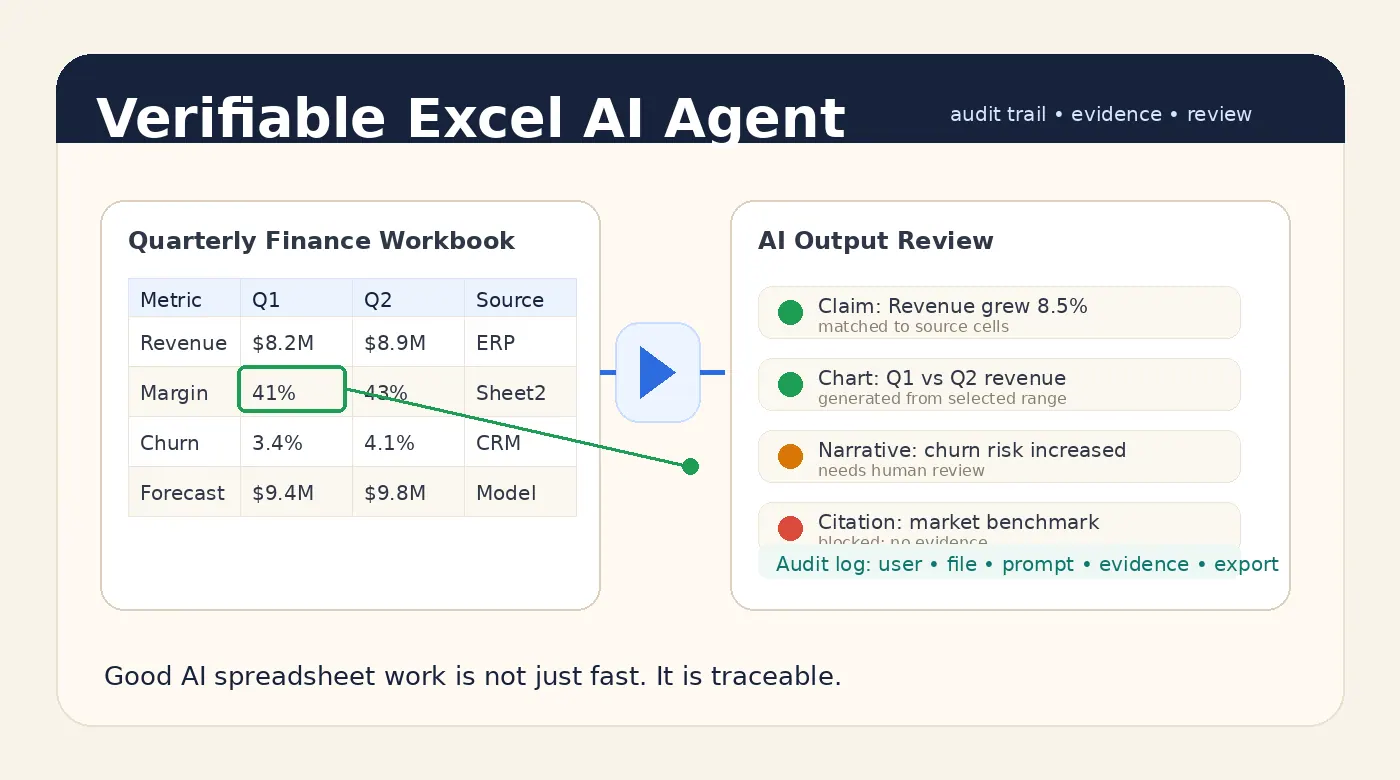

电子表格 AI 的准确性并非源于要求模型“更仔细一点”,而是源于将模型锚定在工具和证据中。

一个私有的电子表格分析师应当:

- 在回答前检查 Schema(架构)

- 当列名模糊时提出澄清问题

- 在模型外部运行计算

- 返回行、表或查询引用

- 在有用时显示中间表

- 将事实与解释分开

- 保留生成的公式、SQL 或代码日志

这使得答案是可审计的。财务分析师可以看到数字的来源,IT 团队可以看到访问了哪些数据,管理者可以比信任“黑盒总结”更信任这个过程。

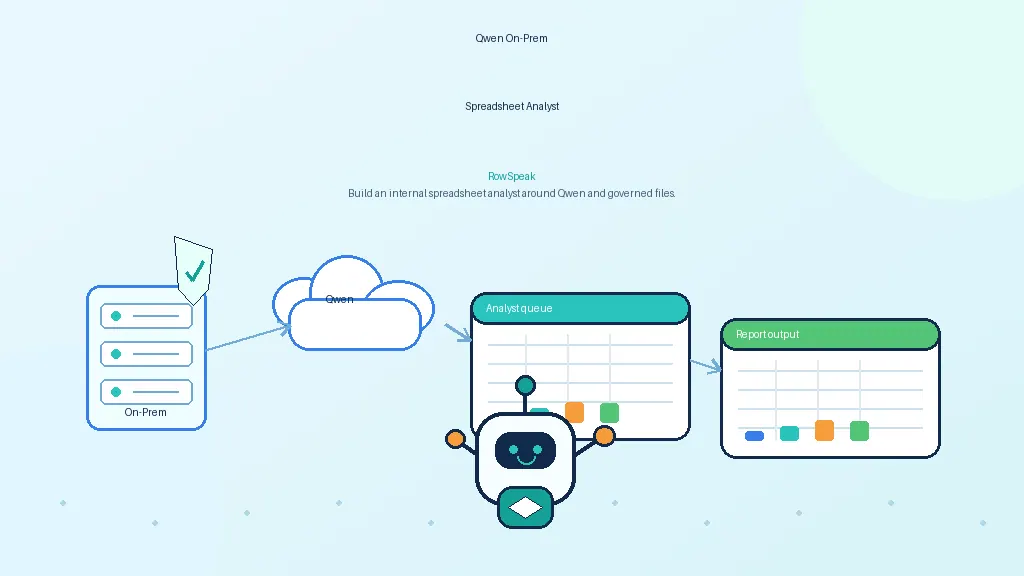

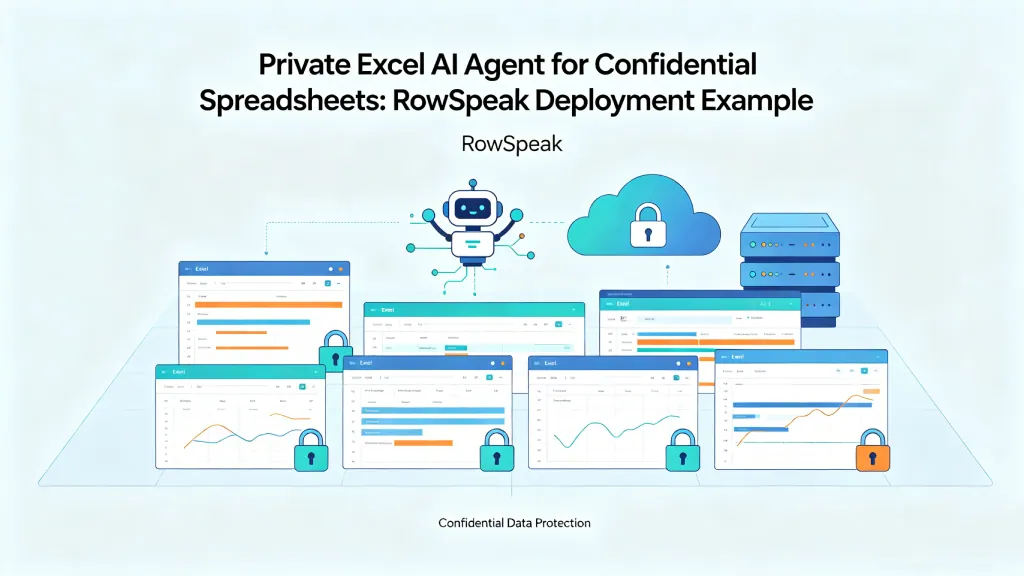

匡优数言 的定位

匡优数言 并不是为了取代 Llama。它位于 Llama 等模型之上,作为电子表格助手工作流层。

在私有部署中,模型提供推理能力。匡优数言 则围绕这种推理提供完整的体验:上传电子表格、使用自然语言提问、运行 AI 电子表格数据分析、创建图表并生成可用于报告的解释。

这一层正是企业价值所在。它处理了原始模型端点无法解决的繁琐部分:工作簿结构、用户工作流、计算锚定以及面向业务的输出。

对于评估 Llama 的公司来说,战略问题不仅是“我们能运行模型吗?”,而是“我们能否将模型转化为团队真正会使用的受控电子表格分析师?”

试点私有 Llama 电子表格分析前的清单

在开始之前,请回答以下问题:

- 用户将分析哪种类型的电子表格?

- 是否存在隐藏的工作表、公式、透视表或多个关联文件?

- 哪些数据是机密或受监管的?

- 文件将存储在哪里?

- 将使用哪种运行时来提供模型服务?

- 将使用哪种引擎执行计算?

- 输出将如何引用源行、单元格或查询?

- 访问权限将如何记录?

- 谁可以查看上传的文件和生成的报告?

- 当模型不确定时,备选方案是什么?

如果这些问题得到了明确解决,Llama 就能成为私有电子表格分析和可重复工作(如定期电子表格报告)的坚实基础。如果忽视这些问题,项目就会变成另一个聊天机器人演示。

来源与延伸阅读

- Meta Llama GitHub: https://github.com/meta-llama

- vLLM OpenAI 兼容服务器: https://docs.vllm.ai/en/latest/serving/openai_compatible_server/

- Ollama 模型库: https://ollama.com/library

- llama.cpp: https://github.com/ggml-org/llama.cpp